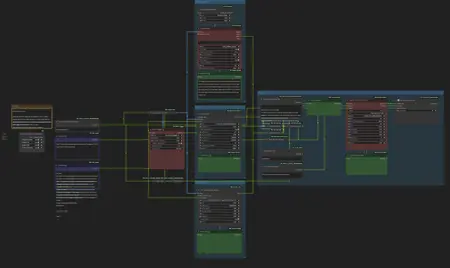

Workflow to generate image descriptions on Apple Silicon Mac

詳細

ファイルをダウンロード

このバージョンについて

モデル説明

について

このワークフローは、複数の画像からテキストへ変換するツールとLLMを活用して、フォルダー内の一連の画像に対して最終的な画像説明を生成し、対応する.txtファイルを出力します。

特にLoRAトレーニングやファインチューニングのためにNSFW画像にキャプションを付ける際には非常に役立ちます。そのため、以下の3つのVLMを選択しています:

- Florence2、WD1.4タガー

- JoyCaption alpha 2

- huihui-ai/Qwen2-VL-7B-Instruct-abliterated

最終的な画像説明の構成には、ollamaノードを用いてLLMを実行しています。これはローカルのLLMを最も簡単に利用できる方法の1つだと考えられます。

huihui-ai/Llama-3.3-70B-Instruct-abliteratedのような検閲されていない大規模モデルを使用すると、驚異的な結果が得られます。

(最良の結果を得るには、Qwen2-VLおよびLLM双方にabliterated/検閲解除モデルを使用することをお勧めします。NSFWかどうかは関係ありません。)

インストール

ComfyUI_Qwen2-VL-Instruct と Comfyui_JC2 ノードを除き、その他の不足しているノードはComfyUIマネージャーでインストールしてください。

ComfyUI_Qwen2-VL-Instruct

このワークフローを動作させるには、次のフォークからQwen2-VL-Instructノードを使用する必要があります:

https://github.com/edwios/ComfyUI_Qwen2-VL-Instruct

このフォークは2つの主要な変更を組み込んでいます:他のVLMツールと同様に画像入力を可能にし、Python 3.12以上、PyTorch 2.6までのMac GPU(mps)をサポートしています。

Comfyui_JC2

JoyCaption: Alpha 2のMac GPU利用のために、次のComfyUI_JC2フォークの使用を推奨します。

使用方法

このワークフローを操作するために必要なすべての要素は、左端に集約されています。

最も簡単な開始方法は、画像が格納されているディレクトリのパスを入力することです。結果は、画像の名前と同じで拡張子が.txtのファイルとして同じディレクトリに書き出されます。

オプションで、以下の操作も可能です:

- Qwen2-VLが画像の特定の側面に集中するよう、VLMのプロンプトを変更する

- LLMのプロンプトを変更して、より良い推論を行わせたり、SFWな方法で説明を生成させたりする(この目的には少なくとも70Bのインストラクションモデルを使用してください)。[いいえ、これは「セーフ」モデルを使用するのとはまったく異なります。]

クレジット

ComfyUIおよびこれらのすべてのノードを私たち全員のために提供してくれたすべての貢献者に感謝します。

特に、ComfyUI_Qwen-VL-Instruct、ComfyUI_JC2、ComfyUI-WD14-Tagger、ComfyUI-Ollama、ComfyUI-Florence2、およびOllamaは、これらの優れた機械学習モデルをmps上で実行可能にし、少なくともNVIDIA専用に制限しないでくれたことに謝意を表します。