REDRAW-BODY-BG-INSTANTID

詳細

ファイルをダウンロード

モデル説明

TL;DR: 元の画像に基づき、プロンプトに従って体や背景を再描画してください。

お手伝い

金のBUZZを私にシェアしていただけませんか?または画像を投稿し、ブルーのBUZZを生む他のアクションを取ってください。これにより、CivitAIでのトレーニング費用を賄い、トレーニング用のデータセットを生成できます。あらかじめ感謝します。

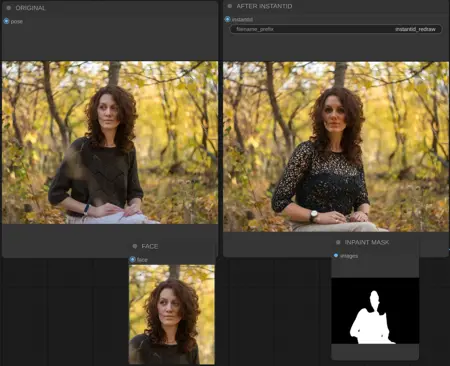

動作原理

元の画像を取り込み、顔を抽出して自動的にインペイントマスクを作成し、顔のエンベッディングを生成します。選択したノイズ除去強度に基づいて、マスク内の領域をすべて書き換えます。

顔、背景、髪、体、服のうち、どの要素をそのまま残すか選択できます。

顔エンベッディングの強度とノイズ除去強度(元の画像をどれだけ保持するか)を調整できます。顔をインペイントマスクから除外すれば、InstantIDモジュールは一切影響を与えません。

また、すべてのレンダリング操作の基本解像度を調整可能です。

使用方法

ほとんどの場合、「Blue WD14 Caption」ノードと「Green USER INPUT」ノードを編集するだけで十分です。元の画像を配置してください。WD14キャプション生成器がPonyスタイルのタグを生成します。そのキャプションを「WD14 Caption」に貼り付けてください。その後、最終結果に表示したくない要素のタグを削除してください。「USER INPUT」には、元の画像に含まれていない要素やスタイルに関する固定プロンプトを入力してください。

WD14タガーの「除外タグ」を調整してプロセスをスムーズにしましょう。すべての除外タグを追加したら、WD14タガーを「Join String List > arg2」に接続して、それ以降の編集は不要になります。

初回実行とWD14 Captionの最初の編集後は、そのままで「USER INPUT」のみを編集しても構いません。あるいはWD14 Captionをさらに調整することもできます。これはプロンプトの補助部分であるため、スタイルの設定を「USER INPUT」ではなくWD14 Captionに置くほうが良いかもしれません。

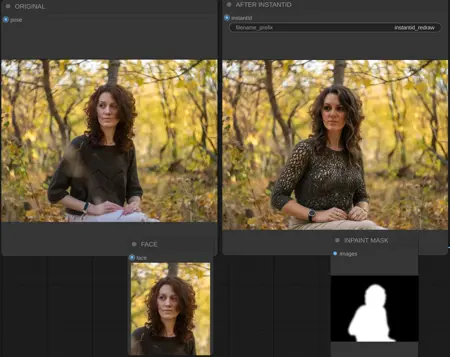

InstantIDで顔を書き換えたい場合は、生成された顔が元の顔と100%一致しない可能性があります。その場合は、最初の結果を元の画像に置き換えてください(右クリック →「Copy (Clipspace)」→ 元の画像ノードに「Paste (Clipspace)」)。その後、満足している要素をマスクで保持するよう調整してください。また、KSamplerのノイズ除去強度とApply InstantIDの重みを調整することもできます。

背景を再描画する場合、必ず「Grow Mask With Blur」の「fill_holes」をオフにしてください。

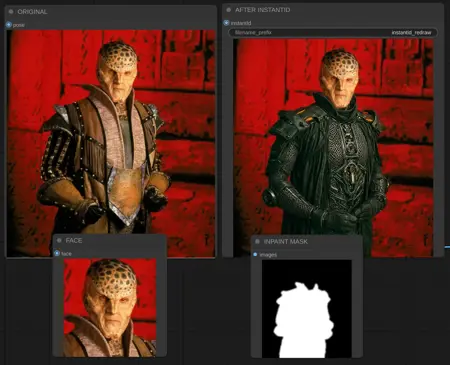

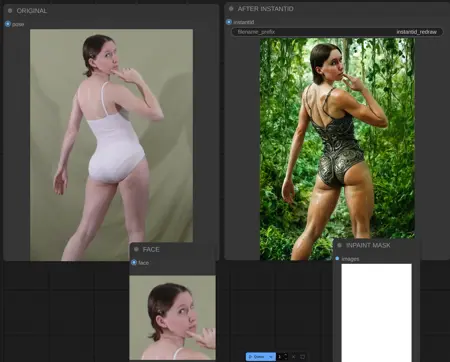

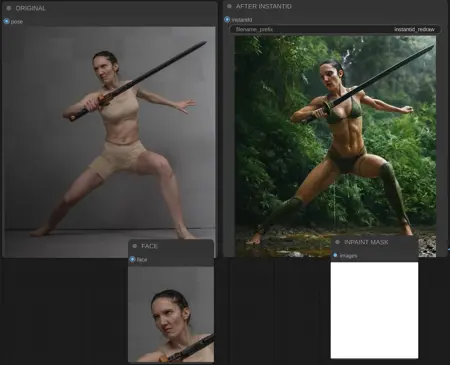

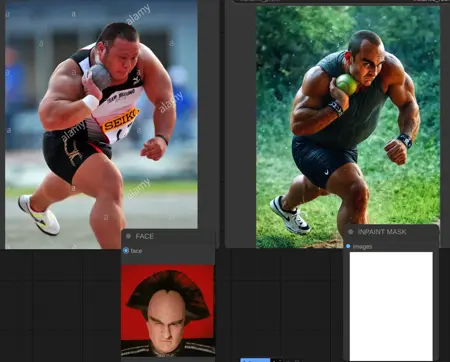

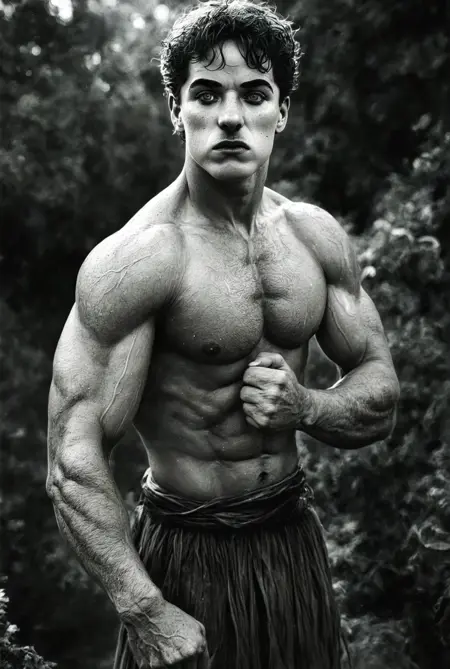

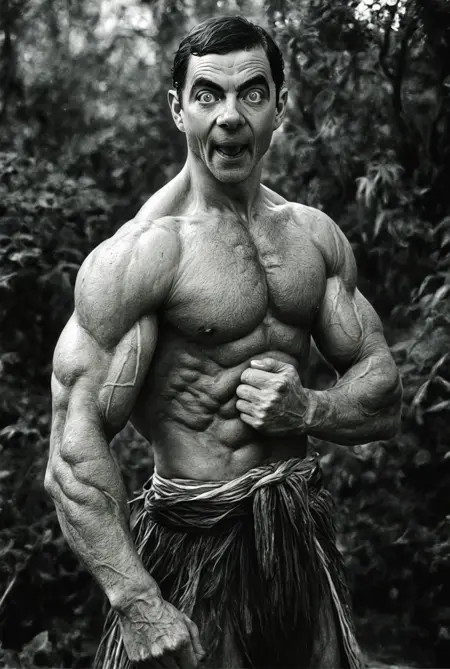

使用例

衣装・体・背景の変更。ぼやけた低画質画像を高解像度化。

Video=2-Video: InstantIDを用いてキャラクターの一貫性を保ちながら各フレームをスタイル化して再描画。

別のキャラクターの体と顔を組み合わせる。

インストール方法/トラブルシューティング

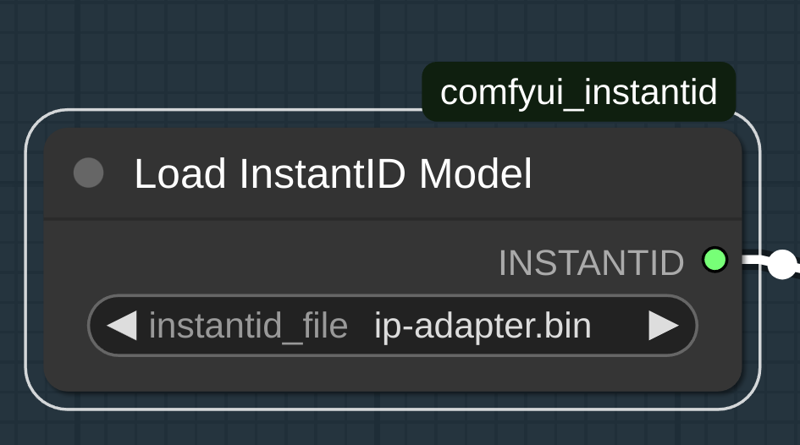

最も難しい部分は、2つのInstantIDパッケージをインストールすることです:

https://github.com/cubiq/ComfyUI_InstantID

https://github.com/nosiu/comfyui-instantId-faceswap

また、以下の2つのモデルをインストールする必要があります:

ip-adapter.bin— SDXL専用の特別なIPAdapterモデル(標準のIPAdapter FaceIdモデルとは混同しないでください)。

diffusion_pytorch_model.safetensors— InstantID用IPAdapter用の特別なControlNetモデル(IPAdapter FaceID用ControlNetモデルとは混同しないでください)。

上記の2つのモデルは、ComfyUIのManagerからダウンロードできます。

その他のカスタムノードは、通常通り簡単にインストールできます。