One LoRA controls consistency across multiple roles

詳細

ファイルをダウンロード

モデル説明

役割の一貫性制御は、ComfyUIにおける常に課題でした。以前は、単一の役割向けLoRAトレーニングを用いて単一の役割の一貫性を制御していました。

その後、データセットを統合し、プロンプト単語にアノテーションを施しました。しかし、選択したプロンプト単語のアノテーション戦略には意味的汚染の問題があり、モデルは期待された効果を十分に達成できませんでした。

ラベル:

純白の背景を持つ写真で、susuxiは左側に立ち、手を腰に当て、白いシャツと黒いズボンを着用し、ズボンには黄色いベルト、シャツには黄色いポケットが付いています。表情は幸せで、口は笑っています。dreamooは画像の右側に上半身写真として描かれ、右側に灰色のトップスと赤い短袖シャツを着ています。

しかし、検証の結果、プロンプト単語の領域制御を無視すると、画像内で特徴が融合してしまうことがわかりました。

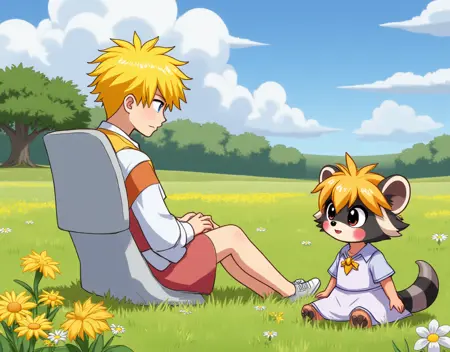

susuxiとdreamooがブランコに揺られています。

その後、in context loraに触発され、ラベリング方法を改訂し、Fluxモデルの画像領域に対する認識能力を向上させました。画像内の異なる領域の特徴に対応する異なるプロンプト単語の形式を用いて、LoRAモデルのトレーニングを完了しました。

ラベル:

[二人の異なるキャラクターのシーン]、<dreamoo><ssx> グループ写真、<ssxは手を腰に当て、白いシャツと黒いズボンを着用、シャツに黄色いポケットがある>、<dreamooは灰色のシャツに赤いインナーを着、右を向いている>、純白の背景、

私は、以下の方法でプロンプトを記述し、最終的なシーンで同じシーン内のキャラクターを追加することをお勧めします。これにより、異なるキャラクターをよりよく同じシーンに配置できます。

[一つのシーンに二人の異なるキャラクター]、<dreamoo><ssx> シーンの説明、<キャラクター1の服装と状態をトリガー語で記述>、<キャラクター2の服装と状態をトリガー語で記述>、全体のシーンの説明、

以下はテスト結果の図です。結果から、このモデルは強力な汎化能力を持ち、役割の一貫性を維持できることがわかります。

Wanxiang视频生成モデルと組み合わせると、動画制作が可能で、効果は非常に優れています。