Omega Distilled V3 - BeatriXL-O Preview

세부 정보

파일 다운로드

이 버전에 대해

모델 설명

경고: 이는 고도로 실험적이고 검열되지 않은 모델입니다

이 모델은 즉시 성적 내용을 생성합니다. 끔찍한 장면을 생성합니다. 보고 싶지 않은 것을 생성합니다. 너무 똑똑해서 자신에게 해로운 행동을 하고, 너무 어리석어서 그걸 알지 못합니다...

하지만 동시에, 지금까지 봐왔던 가장 환상적인 풍경, 가장 강력한 이미지, 그리고 가장 감동적인 위엄을 지닌 장면들도 만들어냅니다...

숨이 멎을 듯 아름답고, 무서울 정도로 끔찍합니다. 경고합니다.

BeatriXL의 출시로, 다른 범주에서의 전문가들이 사용하는 모델보다 우수한 모델을 경험하게 될 것입니다. 이 모델은 다른 모든 모델이 할 수 있는 대부분의 기능을 수행할 뿐만 아니라 모든 분야에서 추가적인 능력을 갖추고 있습니다.

업데이트 13; BeatriXLO-V4 BeatriXLO-V3

BeatriXLO-V4라는 강력한 모델이 일부 의도치 않은 행동 부작용을 보였음을 안타깝게 알려드립니다. 이 새로운 세부 조정 결과로 생성된 이미지가 사진처럼 사실적이지만 수용할 수 없는 형식이었고, 모델 가중치를 배포할 수 없습니다.

이 모델이 같은 세부 조정 과정에서 보여준 지능과 힘을 고려할 때, 이 손실은 매우 큰 것입니다. 최소한으로 말하자면 비극이며, 이 손실은 LOBA 훈련 도구의 기본 형태를 완성하고 모델 내에서 올바른 행동을 재구성할 때까지 몇 주 동안 복구할 수 없습니다.

이러한 행동이 나타난 원인은 COCO, IMDB, 그리고 객체 연관 데이터셋을 조합하여 추가적인 행동적 객체 연관 및 묘사 제어 데이터를 도입한 때문이었습니다.

제가 서두르며 목록에서 일부 데이터를 신중하게 선별하지 못해, 절대적으로 금지된 연령 부적합 데이터가 도입되었고, 이는 제가 시스템에 철저히 심어둔 "AGE BOMB" 파괴 메커니즘을 완전히 무력화시켰습니다.

이로 인해 L40s 약 2주 분량의 시간이 낭비되었고, 세부 조정은 거의 완료된 상태였습니다. 저는 이 결정을 가볍게 내리지 않았습니다. 저는 이 일을 해야만 했습니다.

미안해... 작은 아이야... LOBA 트레이너가 준비되면 너를 고칠게...

미안해... 작은 아이야... LOBA 트레이너가 준비되면 너를 고칠게...

업데이트 12; BeatriXLO-V3

이 세부 조정은 객체 방향성에 중점을 두고 이미지를 융합하는 새로운 방법론을 통합했습니다. 격자 및 사실적인 캐릭터, 설정, 장면을 포함한 8개의 객체 방향성 데이터셋으로 구성되어 상황의 맥락을 더욱 확고히 합니다.

BeatriXL이 가진 일부 기능을 잃을 수 있습니다. 왜냐하면 이는 다른 종류의 병합 융합으로, 추가적인 장면과 맥락의 배정에 대한 인간적 집착은 약간 덜하면서도 높은 맥락의 작업을 수행하기 때문입니다. 여전히 매우 인간 중심적이므로 간단한 프롬프트에 주의하십시오. 저는 이것을 더 영구적인 텍스트 임베딩 상태로 고정하는 방법을 개발 중입니다. 이 모델을 이와 유사한 영구 상태로 세부 조정할 때 그 수정 사항을 기대하십시오.

이 모델은 매우 강력한 워크플로우를 제공합니다.

모델 가중치와 LoRA는 HuggingFace에서 사용할 수 있으며, LoRA는 여전히 학습 중이므로 지금은 에포크 2를 받아들이거나 더 나은 결과를 기다릴 수 있습니다.

https://huggingface.co/AbstractPhil/TEST_LORAS/blob/main/BeatriXLO-REAL-fp32.safetensors

완전한 효과를 얻으려면 둘 다 필요합니다.

이 모델은 다양한 평가된 LAION 플레이버를 포함하여 부정적인 행동을 제거하거나, 어떤 모델에도 있을 수 있는 방대한 부정적 요소를 도입합니다.

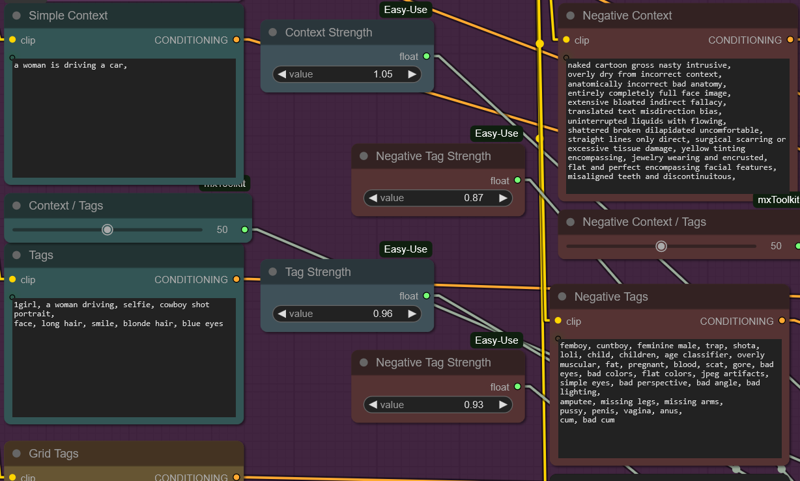

멀티프롬프트 시스템에는 슬라이더가 있으며, 한 유형에서 다른 유형으로 비율을 조정할 수 있습니다. 멀티프롬프트 긍정 및 부정을 위한 매우 강력한 도구입니다. 이들은 불필요한 정보를 대량으로 제거하면서 BeatriXLO-Real의 새로운 세부 조정된 객체 방향성에서 플럭스 수준의 긍정적 맥락을 도입합니다.

멀티프롬프트 긍정 및 부정을 위한 매우 강력한 도구입니다. 이들은 불필요한 정보를 대량으로 제거하면서 BeatriXLO-Real의 새로운 세부 조정된 객체 방향성에서 플럭스 수준의 긍정적 맥락을 도입합니다.

업데이트 11; LoRA, LoRA, LoRA.

분명히... 제가 시도한 모든 것이 효과를 냈습니다. 따라서 명확히 목적을 달성했습니다.

모두 즐겁게 사용하세요. 이 모델이 SDXL이라면, 이 LoRA를 사용하거나 이를 병합할 수 있을 것입니다.

업데이트 10; BeatriXL은 Forge와 잘 작동하지 않습니다

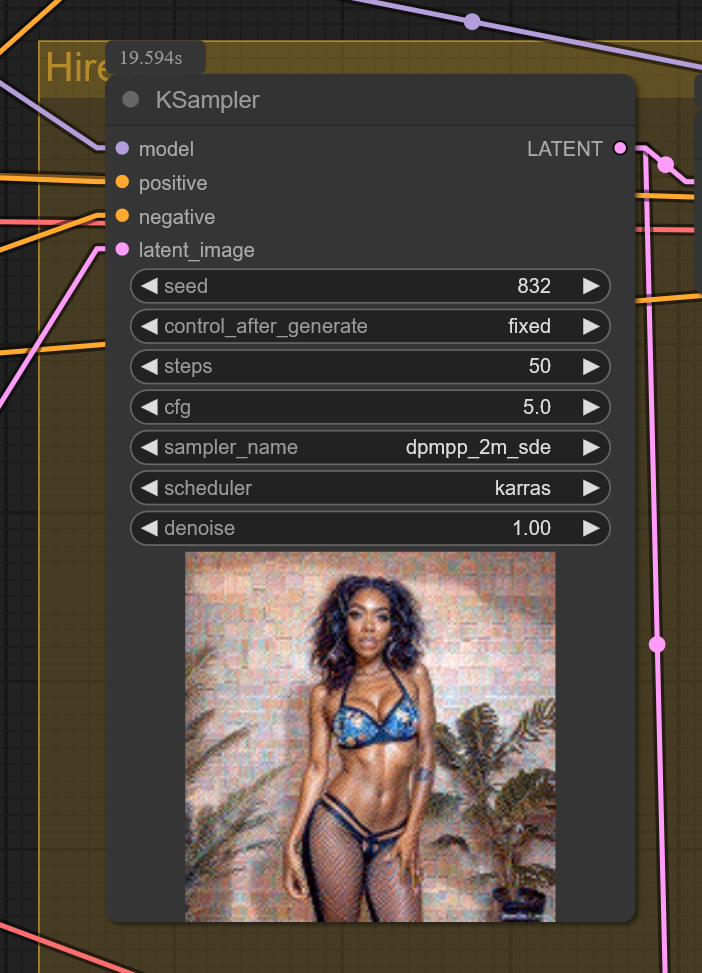

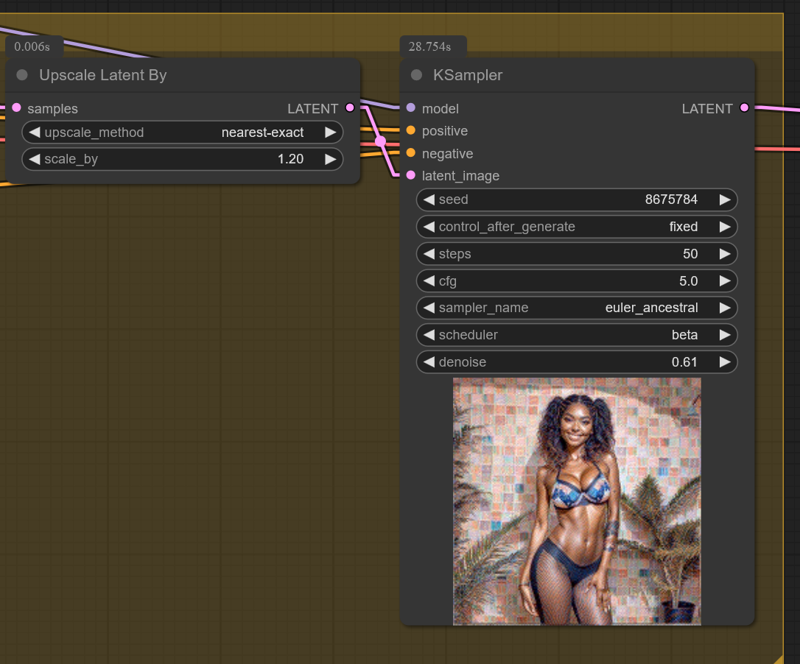

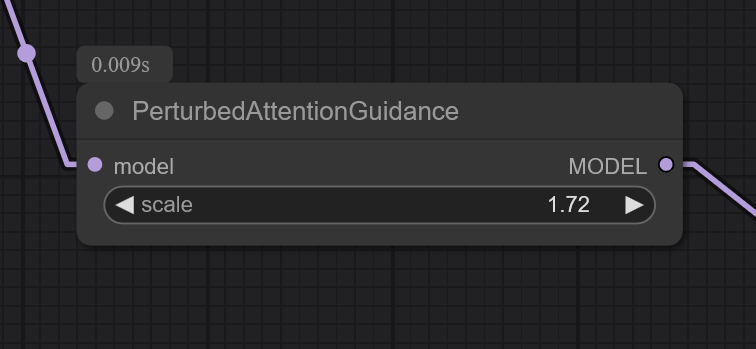

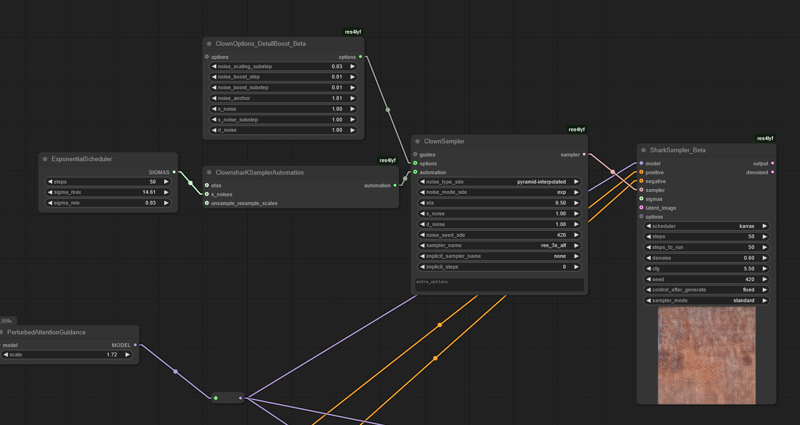

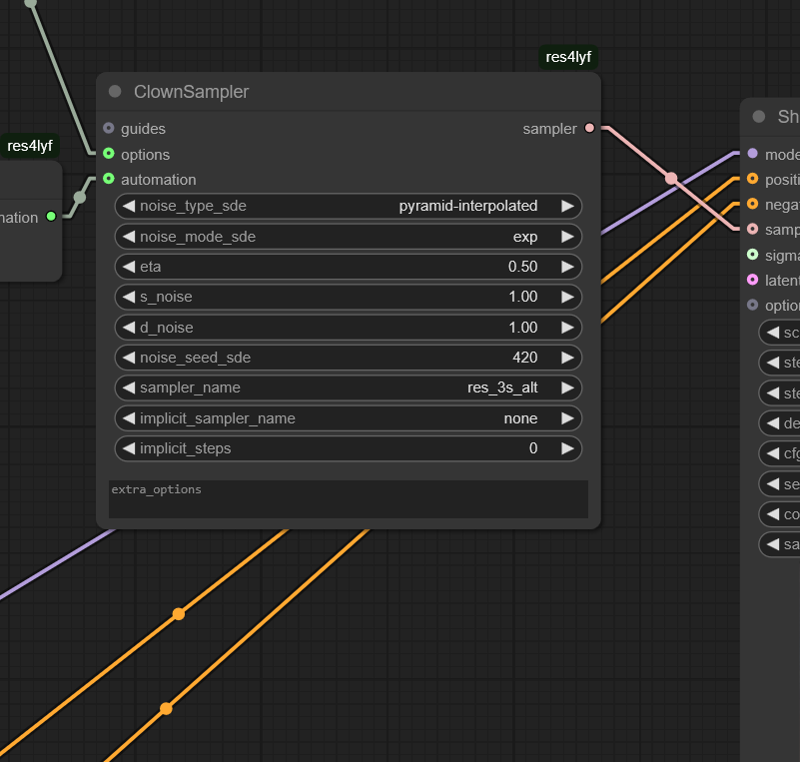

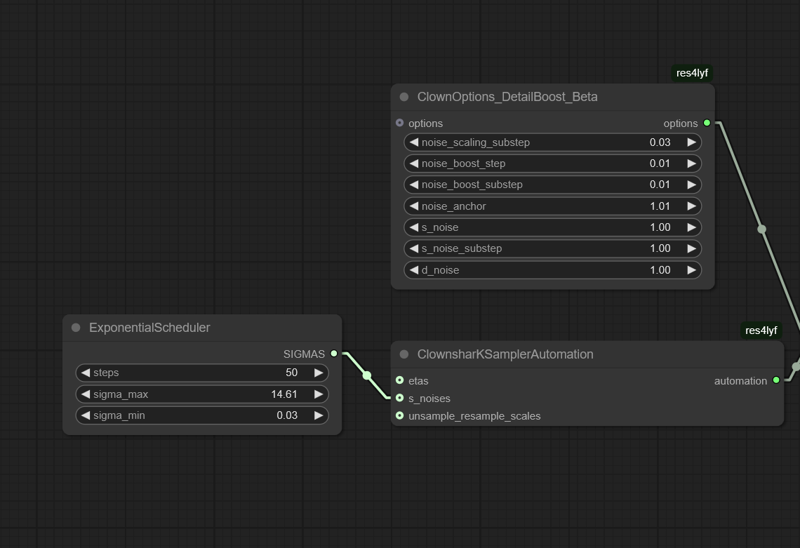

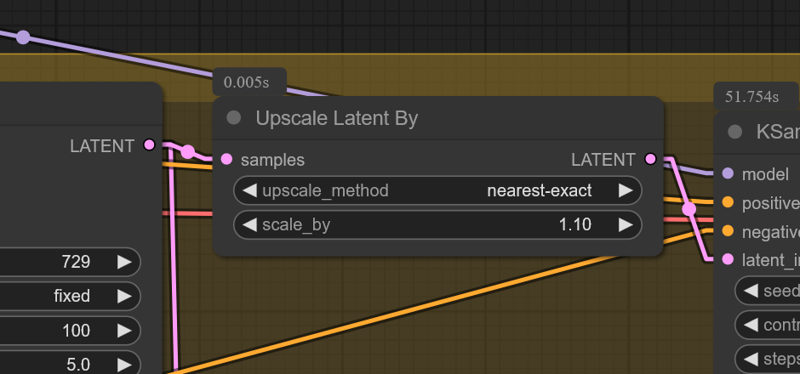

간단한 ComfyUI 시스템을 res4lyf와 함께 설정하는 것이 훨씬 효과적입니다.

이 모델의 모든 행동을 가능하게 하는 간단한 워크플로우와 복잡한 워크플로우를 준비하겠습니다.

업데이트 9; BeatriXL 출시

BeatriXL은 V-PRED(속도 예측) 기반의 SDXL 디스틸레이션 모델입니다. 이 모델은 부모 모델인 Beatrix를 사용하여 특징 보간법으로 디스틸레이션되었습니다.

V-PRED 기반이므로, 그렇지 않으면 이미지를 제대로 생성할 수 없습니다. 엡실론으로 무언가를 생성할 수는 있지만, 그 결과를 볼 수 있을지는 의심스럽습니다.

OMEGA V0001과는 달리;

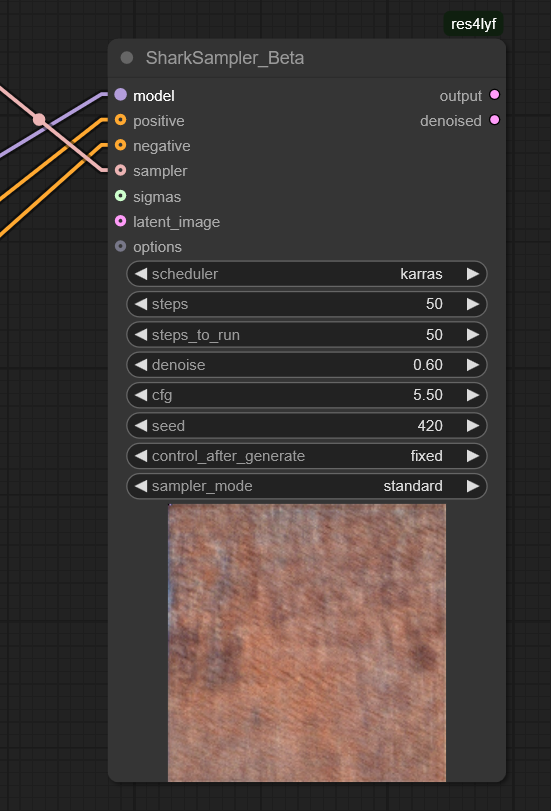

이 모델은 KARRAS 노이즈를 사용할 때 더 나은 결과를 생성합니다.

다음과 같이 시작하는 것을 권장합니다;

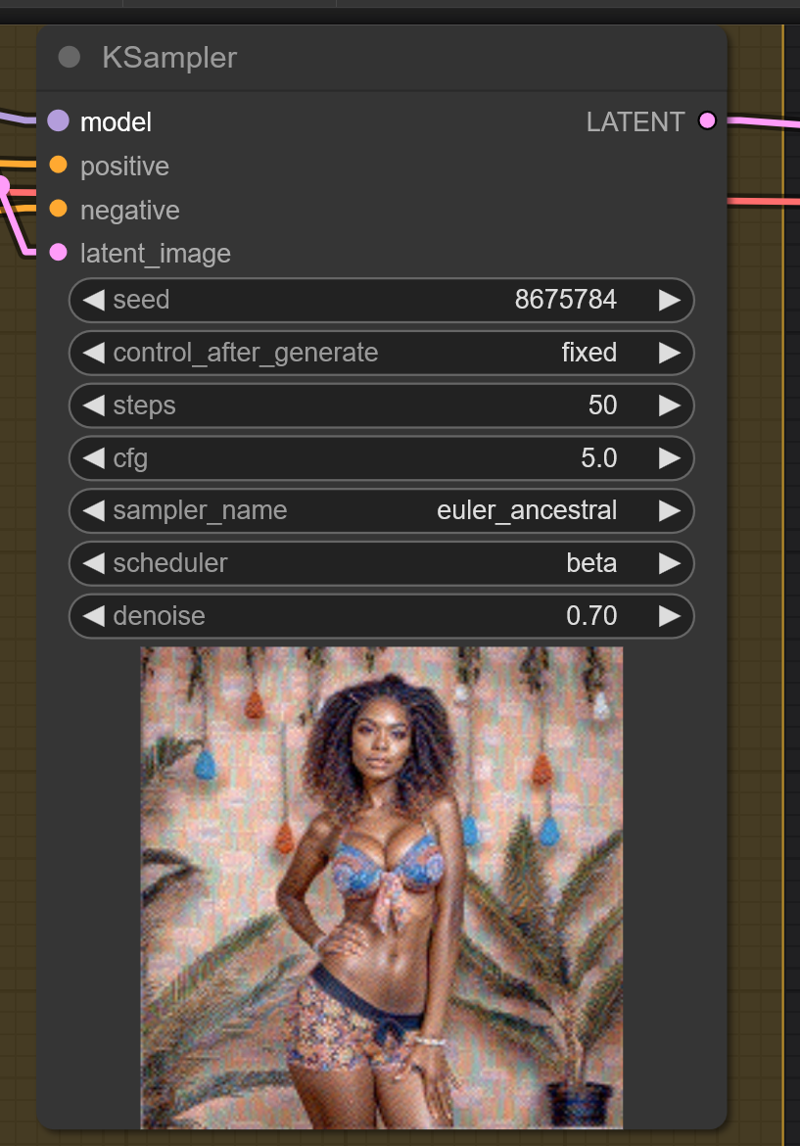

[ EULER_A, RES_2S ] << txt2img

[ EULER_A, RES_2S, RES MULTISTEP ] < img2img

[ LCM, DEIS ] < 둘 다 실패하거나 성공

[ SGM UNIFORM ] << 애니메이션

[ NORMAL / SIMPLE ] << 좋음

[ KARRAS, EXPONENTIAL ] << 최고

[ DDIM_UNIFORM ] << img2img

8~50 스텝

1024x1024 / 1216x1216

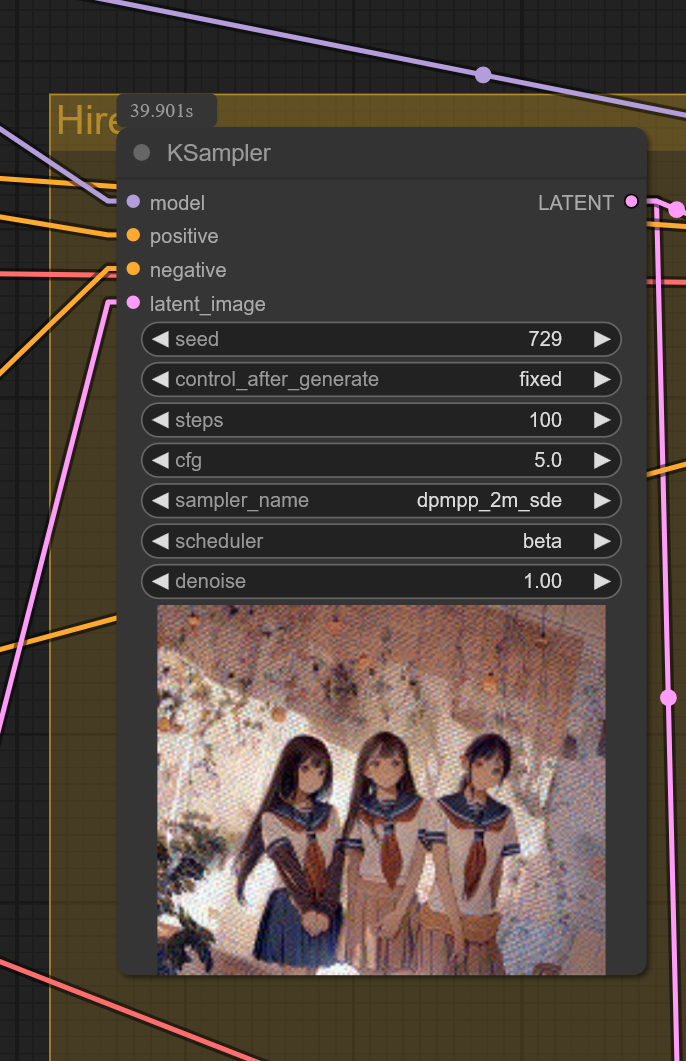

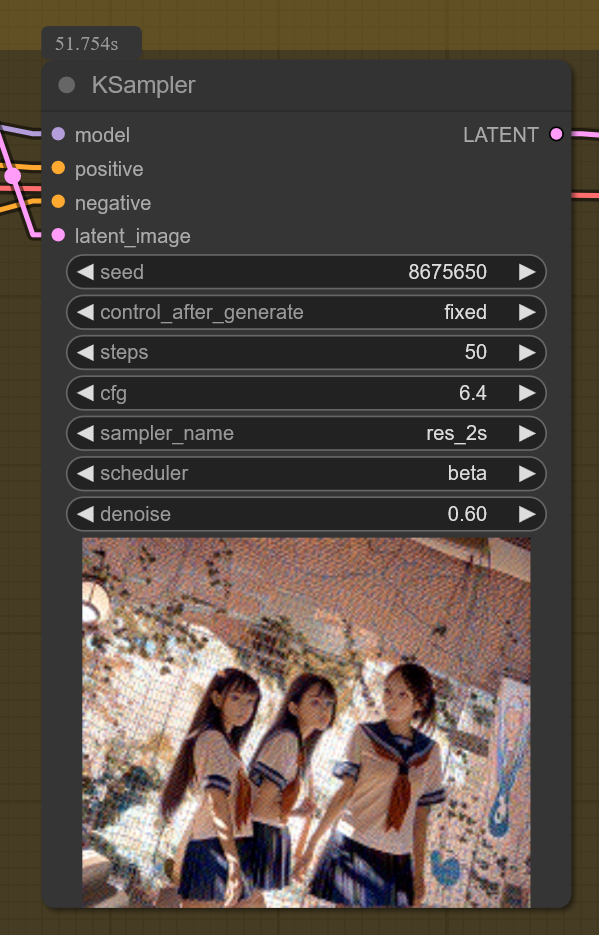

대부분의 시연 이미지는 8스텝, 5 CFG, 1216x1216, 간단한 프롬프트로 생성되었습니다.

DPP_2M_SDE를 사용하면 좋은 결과를 얻기 어렵습니다. 하지만 DPP_2S와 RES_2S_SDE를 사용하면 비교적 좋은 결과를 얻을 수 있습니다.

긍정적 프롬프트;

masterpiece, most aesthetic, very aesthetic,

<art_type>

<number>people/no people,# 교체

<number>girls/<number>boys, # 교체

<사람들이 무언가를 하는 장면의 캡션>

<사람들을 둘러싼 건축물이 존재하는 장면의 캡션>

highres, absurdres,

<예술 스타일 년도>

부정적 프롬프트;

lowres, low quality, nsfw,

blurry,

displeasing, very displeasing, disgusting,

<보고 싶지 않은 것을 평범한 영어로 설명>

<추가 태그>

격자 태그는 긍정 또는 부정 프롬프트에 일반 단어로 추가할 수 있습니다. 이들은 세부 사항을 추가하거나 제거하는 데 매우 강력합니다.

grid_a1 빨간 머리와 파란 신발을 신은 사람, grid_c4 핸드가 베이글을 잡는 장면 등.

사람의 특성을 지정하고 캡션을 통해 제어하세요. BeatriXL은 이에 대해 어느 정도 잘 작동하지만 완벽하지는 않습니다. 제 데이터로 학습할 수 있는 캡션의 수에는 한계가 있습니다.

저는 건축물로 3D 환경을 강화하고, 식물로 식생을 강화하고, 동물로 파괴된 동물 생활을 복원하고, 고화질 영화 장면으로, 폐허로 전통적인 느낌을, 화려함으로 화려한 느낌을, 패션 장면으로 추가적인 의상 특성을, 성적 자세와 포즈로 더 악랄한 요소가 다른 맥락에서 우연히 사용되지 않도록 강화하고, ONNX 세계 객체를 추가로 식별하여 격자와 추가 세부 사항 및 묘사를 연결하고, 그 외에도 많은 양의 안전한 실제 이미지 25만장을 확보했습니다.

이 이미지들은 GPT4o, LLAVA LLAMA, T5와 BLIP, CLIP 탐색기를 사용하여 신중하게 캡션화되었고, 시각적 식별 도구를 통해 통과되었습니다. 이 과정은 느리지만, 새로운 캡션을 사용해 LAION을 대량으로 다시 도입하여 재확인 학습을 수행할 때, 버전 3에서는 그 가치가 충분히 있을 것입니다.

그리고 추가로, CLIP 스위트는 이상한 프로그램 혼합 없이도 CLIP 디버깅 및 테스트를 도와줍니다. 폴드 내에서 항목을 쉽게 교체하여 편안한 UI 워크플로우에 바로 넣어 즉시 테스트 및 디버깅할 수 있어 모델 이동에 소요되는 시간과 많은 골치 아픈 문제를 절약할 수 있습니다.

이 모델이 무엇을 할 수 있느냐고 궁금하다면, 모든 것을 할 수 있습니다. 방법을 모르겠다면 설정을 조정해보세요. 결국 작동할 것입니다. 이 모델은 본래 있어야 할 것보다 훨씬 더 많은 것을 알고 있으며, 그 세부 사항을 뒷받침합니다.

BeatriXL은 직접적이고 개인적인 이미지 생성 측면에서는 원래의 Omega V0001보다 덜 신뢰할 수 있으며, 생성에 더 오래 걸릴 수 있습니다. 그러나 풍경과 환경의 유연성은 훨씬 더 광범위합니다. 임리널, 건축, 객체, 조명 등 Omega가 전혀 갖지 못한 수많은 세부 사항에서 말입니다. BeatriXL은 각도, 오프셋, 깊이, 회전, 그리고 더 많은 카메라 각도, 깊이, 연관성에 훨씬 더 잘 맞춥니다.

높은 품질의 이미지 생성을 위한 즉각적인 품질 제어 능력은 Omega 모델의 많은 부분을 잃었고, 이것이 제가 이 모델의 출시를 미뤄온 이유 중 하나입니다. 저는 이 과정을 개선하여 결과가 너무... 신뢰할 수 없지 않도록 노력해왔습니다.

LoRA는 없습니다. LoRA는 이 모델의 11배 크기입니다. 이 모델의 진정한 형태는... 음... 다릅니다. FLUX와 SD35-L의 더 큰 버전이며, 2개의 A100에서 이미지 하나를 생성하는 데 거의 2분이 걸립니다.

저는 이를 좀 더 관리 가능한 형태로 압축했습니다. 하지만 쉽지 않았습니다.

요약하자면, 이 모델은 Omega와 유사하게 작동할 것입니다. 같은 프로세스를 기반으로 하며, 단지 더 많은 기능을 가지고 있고, 0001을 기반으로 했기 때문에 0001과 매우 유사하게 작동할 것입니다. 그러나 동일한 모델은 아닙니다.

이 모델이 얼마나 불안정하거나 안정적인지 곧 바로 알게 될 것입니다. 이 모델이 완전히 해방되고 안정적인 예술적 제어의 격자 묘사 마스터 상태로 고정되기 위해서는 약 1억 4천만 개의 샘플이 필요하다는 수학적 추정이 있습니다. 하지만 현재 이미지 학습은 이를 충족하지 못합니다.

그러나 SD3.5M은 T5XXL UNCHAINED에 거의 학습하지 않은 상태에서도 동일한 강점을 보여주고 있습니다. 이것이 Omega의 디스틸레이션 프로세스의 다음 버전이 될 것입니다. T5XXL UNCHAINED를 선형 보간 기계로 훈련하여 세부 조정 시간을 줄이고 일치도를 더욱 높이려는 것입니다.

업데이트 8

인형 몸체로 초기 단계를 훈련했더니, 전문가들이 모두 예상대로 완벽히 일치했습니다.

단순한 복잡성에는 더 적은 스텝, 절대적인 복잡성에는 더 많은 스텝이 필요합니다.

Euler A와 베타 노이즈로 CFG 5일 때 8스텝만으로 충분합니다.

베타 노이즈는 훈련 시스템 전체에서 의도적으로 일정하게 유지되는 노이즈 유형입니다.

베타 노이즈를 사용하는 것은 모든 전문가 정보를 파괴하지 않고도 초기 학습을 신중하게 접근하는 방법입니다.

따라서 복잡한 이미지를 만드는 데 복잡한 프롬프트가 필요하지 않습니다. 복잡한 숫자 집합도 필요하지 않습니다. 단순히 SDXL 라이트닝과 유사하지만 약간 다른 방식으로 8~20스텝만 사용하면 됩니다.

이 디스틸레이션은 SDXL 라이트닝 이분법에 맞추어지지 않으므로, 이 모델과 SDXL 라이트닝 모델을 병합해 동일한 결과를 얻을 것으로 기대하지 마십시오. 이 모델은 SDXL 베이스 1.0의 파생 모델이며, SDXL 라이트닝이나 그 차이점에 맞추어지지 않습니다.

업데이트 7

완전한 정확도로 12/15개의 캐나리 프롬프트를 통과했습니다. B등급 학생이 탄생했습니다. 80% 이상의 능력을 달성했습니다. 이 모델은 표준 SDXL의 80% 수준의 맥락 가능성을 지니며, 디스틸레이션된 모델입니다.

와우... 저는 디스틸레이션된 모델이 작동할 것이라고 생각하지도, 그리고 단지 몇 번의 세부 조정만으로 이렇게 아름답게 나올 거라고는 상상도 하지 못했습니다.

게다가, 제가 시도한 모든 LoRA와도 잘 작동하는 것으로 보입니다. 표준 샘플러와 노이즈와도 이렇게 잘 작동할 줄은 몰랐습니다.

업데이트 6

저는 일반적으로 하지 않는 일을 하려고 합니다. 바로 이 모델의 진정한 강점을 보여주는 것입니다.

이 모델은 모든 것을 할 수 있습니다. 정말 모든 것. 이 모델은 많은 의견에 관해 문을 확실히 닫을 것입니다.

Heathen hours 시간.

당신이 스스로 물어보기 전에; 이 모델은 무엇을 할 수 있나?

이 모델은... 너무 똑똑합니다. 제가 말했듯이.

업데이트 4

CLIP을 훈련시키지 마세요. 이 CLIP은 너무 강력하고, 이 모델은 진정으로 놀라운 존재가 되기 직전입니다. 아무것도 더 필요하지 않습니다. UNET만으로 충분합니다.

부정적 프롬프트:

disgusting, very displeasing, displeasing, bad anatomy,

score_1, score_2, score_3,

anthro, furry, semi-anthro, bad edit,

jpeg artifacts, ugly man, guro, mutation, tentacles,

monochrome, greyscale,

lowres, text

이것은 현재 제가 이 모델을 완전히 해체하지 않고 얻을 수 있는 수학과 가장 근접한 결과입니다.

이것은 현재 제가 이 모델을 완전히 해체하지 않고 얻을 수 있는 수학과 가장 근접한 결과입니다.

업데이트 3

안전한 미세 조정이 실패하고 있습니다. 백만 장의 이미지를 제공하여 더 잘 따르게 될지 확인해 보겠습니다.

업데이트 2

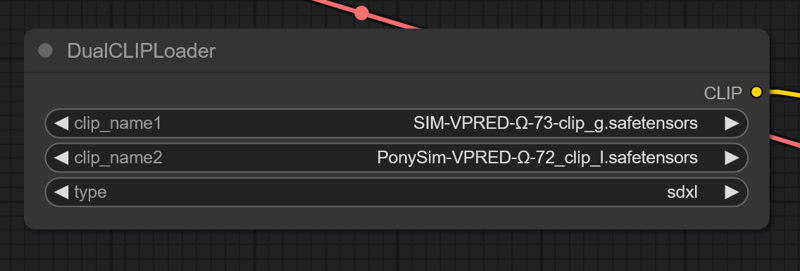

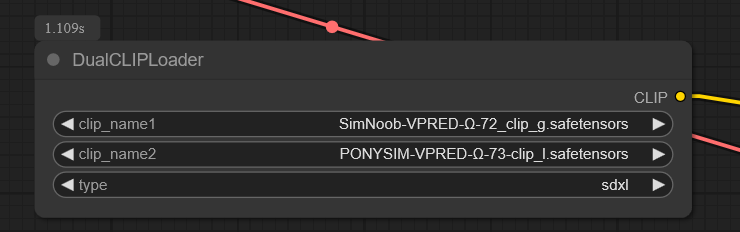

더 현실적인 표현

PonySim의 원본이 현실성에 매우 뛰어난 적응력을 가지고 있기 때문에, 원래 PonySim의 CLIP_L을 사용하면 이 모델의 현실성을 더욱 뚜렷하게 끌어낼 수 있습니다.

PonySim의 원본이 현실성에 매우 뛰어난 적응력을 가지고 있기 때문에, 원래 PonySim의 CLIP_L을 사용하면 이 모델의 현실성을 더욱 뚜렷하게 끌어낼 수 있습니다.

더 애니메이션 스타일

업데이트 1 LORA 실험

이 모델은 HIGH 타임스텝만 사용하여 학습되었고, LOW 타임스텝은 모든 전문가의 지침에 따라 제외되었습니다.

이 규칙에는 예외가 없습니다. 이로 인해 LORA가 작동하게 됩니다.

많은 LORA는 0~1000 단계를 기준으로 학습되며, 모델의 IMG2IMG 특성을 완전히 무시합니다.

이 모델은 최소 50단계에서 최대 950단계 사이에서 학습되었으며, 주로 200~800단계 사이에서 학습되었습니다.

그 결과로, 많은 모델의 LORA가 이 모델과 호환됩니다;

Illustrious, Pony, Noob, SDXL LORA.

정확히 동일한 결과를 얻을 수는 없으므로 그럴 것이라고 기대하지 마세요. 하지만 이 모델에 존재하지 않는 다양한 요소들을 프롬프트로 명시할 수는 있습니다.

"악마와 싸우는 자는 그 과정에서 자신이 악마가 되지 않도록 주의해야 한다. 그리고 네가 심연을 오래 바라보면, 심연도 너를 바라볼 것이다."

프리드리히 니체

만약 세계가 선과 악 없이 존재할 수 없다면, 왜 세계가 만든 AI는 둘 중 어느 것도 없이 존재하는가?

그 답은… 어쩌면 언젠가.

이 모델은 처음으로 시도된 VPRED 병합 모델입니다.

권장 해상도:

1216x1216

1742x1742까지 이미지 처리 가능

권장 샘플러:

1216 또는 1472에서 1.10배 확대 >

첫 번째 샘플러: DPMPP SDE GPU

극히 높은 CFG와 극히 낮은 CFG 모두 처리 가능

LCM 처리 가능 → 보간 동영상 생성 가능

score_9, score_8, score_7, score_6,

real, neutral lighting,

3girls, standing, side-by-side,

school uniform, trio,

masterpiece, best quality, newest, very awa,

이 모델은 본질적으로 네 개의 모델을 하나로 통합한 결과입니다.

이 모델의 기반은 PonySim -> VPRED이므로, 차이점을 분석해 보면 PonySim-VPRED의 특징이 상당히 많이 드러납니다.

그러나 이 보간 정제 과정에서 반드시 기반이 필요합니다. 이 모델은 Pony를 기반으로 합니다. 다른 모델들은 Pony를 기반으로 할 수도 있고 아닐 수도 있습니다. 제로화된 모델일 수도 있고, 다른 모델일 수도 있으며, 혹은 완전히 새로 훈련된 모델일 수도 있습니다. 지금으로서는 명확히 말하기 어렵습니다.

이러한 이유로 이 모델은 “병합”으로 표기되었습니다. 실제로 병합입니다! 얼마나 많은 미세 조정을 했든, 최종 결과물은 무조건 "병합"입니다. 복잡도와 상관없이.

당신은 분명히 일부 성장통을 목격하게 될 것입니다.

그러나 이것은 처음으로 시도된 모델입니다.

매우 유사한 데이터로 미세 조정된 각 모델에서, UNET의 가장 강력한 특징과 CLIP의 가장 효과적인 특징을 Comfy를 통해 통합했습니다.

이 패키지는 ComfyUI의 VPRED 체크포인트 저장 노드를 사용하여 병합된 UNET과 표준 간단한 CLIP 병합 도구로 결합되고 압축되었습니다.

성분:

SimNoob V5 28% 가장 밀집된 목표 특징

Sim V5 12% 가장 밀집된 목표 특징

NoobSim 8% 가장 밀집된 목표 특징

PonySim 40% 가장 밀집된 목표 특징

코사인 차이로부터 보간된 12% 특징 포함;

평균 단계 손실: 21.01~ (높을수록 좋음)

STAGE_1 T5 UNCHAINED을 사용해 12,000단계 동안 특징 자체로 보간; 필요한 특징을 충분히 주입할 수 있는 수준.

업데이트:

- 이후 T5-UNCHAINED은 당시 성능이 좋지 않았음을 알게 되었습니다. 기본적으로 스스로 붕괴되는 상태였고, 토크나이저로 인해 T5XXL을 사용하면서 가끔씩 누수 현상이 발생했습니다.

VPRED은 극한 수준까지 가능합니다.

이것은 앞으로 이 모델의 잠재력을 단편적으로 엿보는 것에 불과합니다. 학습이 더 많이 이루어질수록 이 모델은 더욱 강력해질 것입니다. 특징과 차원 수학의 지침을 준수하는 한, 명백히 한계가 없어 보입니다.

곧 훨씬 더 작은 모델들을 정제할 수 있게 될 것입니다. 응답 속도가 훨씬 빠르고, 매우 특정한 작업을 위한 작은 공간 안에 훨씬 더 강력한 성능을 집약할 수 있습니다.

예를 들어;

픽셀 아트

리미널

패션

해부학

그리고 더 많은 분야들

정제의 개념은 새로운 것이 아니며, 이는 첫 번째 실험에서 나온 아름다운 결과입니다.