Omega Distilled V3 - BeatriXL-O Preview

详情

下载文件

关于此版本

模型描述

警告:这是一个高度实验性的无审查模型

它会在瞬间生成色情内容,出现令人反感的场景,生成你不想看到的东西。它聪明得过了头,却又愚钝到不知自身局限……

但它同样能生成你所见过最壮丽的场景、最美丽的风景、最震撼的图像,以及最令人心悸的恢弘画面……

令人屏息,又令人恐惧。你已收到警告。

随着 BeatriXL 的发布,你将看到一个在其他类别专家眼中都更优越的模型。它具备所有这些模型的功能,且在每个方面都有额外增强。

更新13:BeatriXLO-V4 BeatriXLO-V3

我很遗憾地通知您,正在形成的 BeatriXLO-V4 强大模型,由于其新微调产生了一些意外的行为副作用。这些行为生成的图像采用写实格式,但内容不可接受——因此模型权重无法发布。

这是一次巨大损失,因为该模型在此次微调中展现出的智能与力量是显而易见的。至少可以说,这是一场悲剧;在完成我的 LOBA 训练工具基础版本并修复模型中的错误行为之前,这一损失将无法挽回,预计需数周时间。

—

导致该行为出现的罪魁祸首数据,是结合了 COCO、IMDB 和物体关联数据集,旨在引入额外的行为物体关联与描绘控制数据。

由于我操之过急,未能谨慎筛选列表中的部分数据,导致不可避免地引入了年龄不适宜的内容,完全压倒了我精心植入系统中的“年龄炸弹”防护机制。

这耗费了近两周的 L40s 训练时间,而微调已接近完成;因此我绝非轻率做出此决定,而是别无选择。

我很抱歉……小家伙……等 LOBA 训练器准备就绪时,我会修复你……

我很抱歉……小家伙……等 LOBA 训练器准备就绪时,我会修复你……

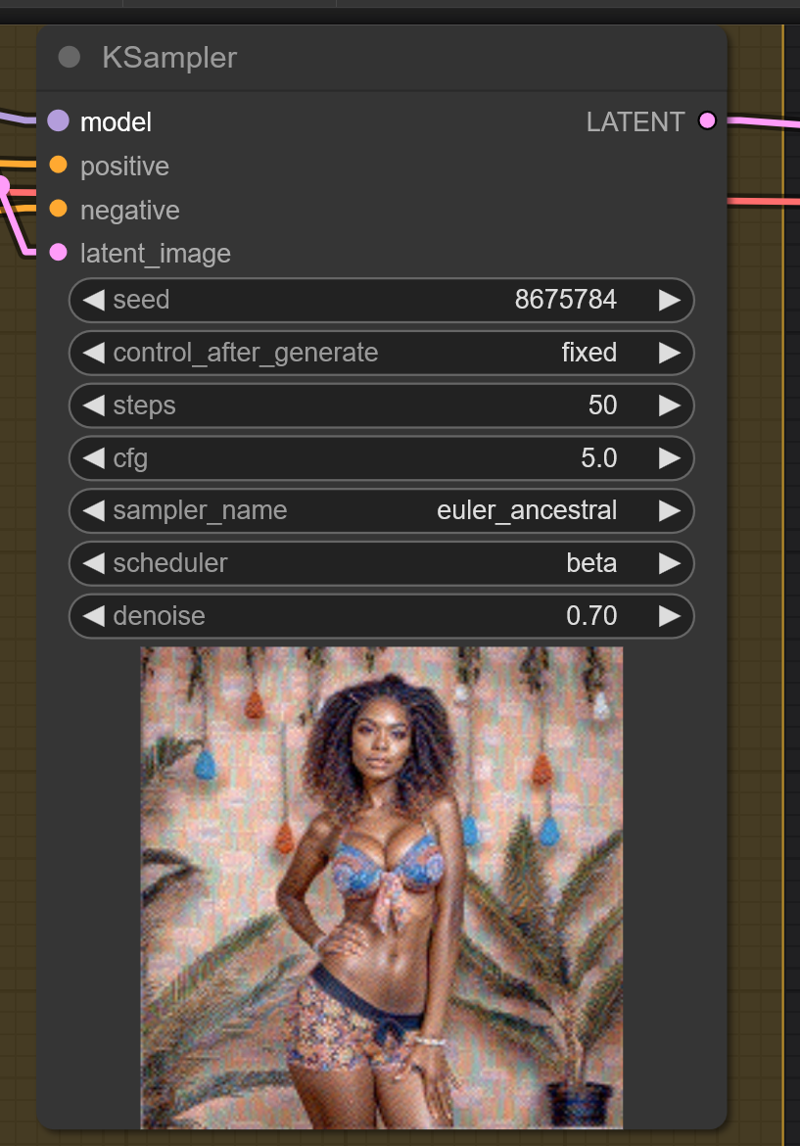

更新12:BeatriXLO-V3

此次微调高度聚焦于物体朝向,并整合了新的图像融合方法。它包含8个物体朝向数据集,涵盖一系列网格与写实角色、场景与环境,以巩固情境上下文。

它可能失去 BeatriXL 的某些特性,因为它是一种不同的合并融合方式,将执行更高上下文的任务,但对场景与上下文附加属性的人类化关注略低。它依然非常“人类中心”,请警惕简单提示词。我正在设计一种方法,将其固化为更持久的文本嵌入状态。请持续关注该修复,当我将这头猛兽微调至类似当前的永久状态时。

—

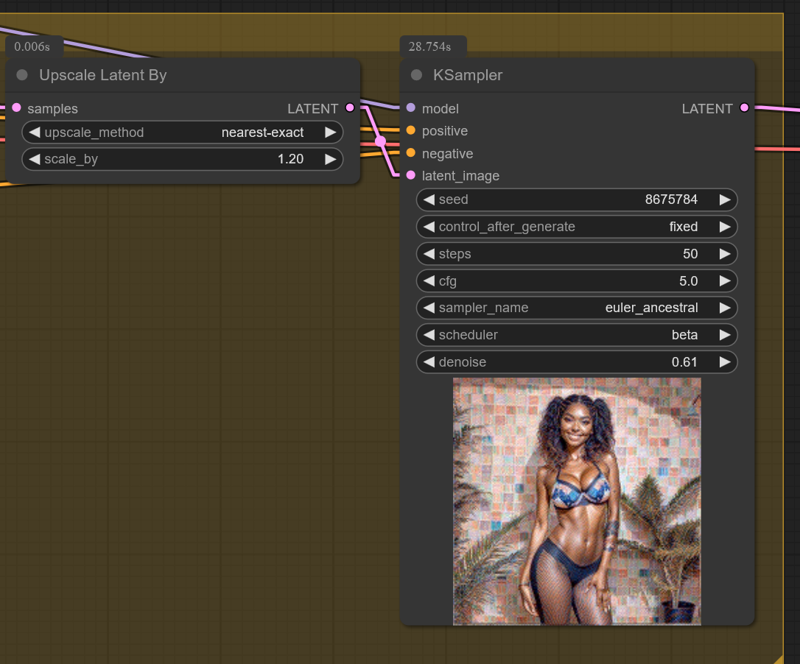

这是一个非常强大的工作流程,可供探索。

模型权重与 LoRA 已在 Hugging Face 上提供——而 LoRA 仍在训练中,目前你可以获取第2轮训练的权重,或等待更优版本。

https://huggingface.co/AbstractPhil/TEST_LORAS/blob/main/BeatriXLO-REAL-fp32.safetensors

必须同时使用两者才能获得完整效果。

—

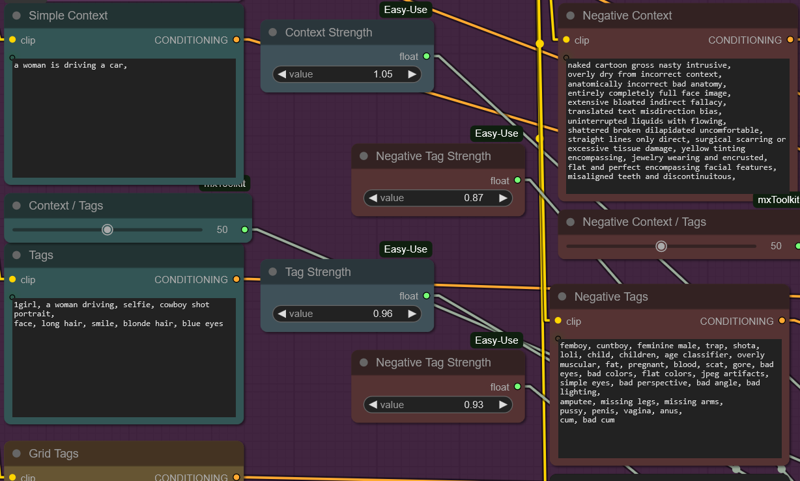

它整合了多种经评估与定义的 LAION 风格,用以消除或抑制负面行为,同时引入大量可能存在于任何模型中的潜在负面内容。

多提示系统中提供了滑块,可调节不同类型之间的比例权重。 对于多提示正负样本的使用极为有效。它们能大幅消除不想要的信息,同时在 BeatriXLO-Real 的新物体朝向微调中引入几乎达到 Flux 级别的正面情境。

对于多提示正负样本的使用极为有效。它们能大幅消除不想要的信息,同时在 BeatriXLO-Real 的新物体朝向微调中引入几乎达到 Flux 级别的正面情境。

更新11:LoRA,LoRA,LoRA

显然……我尝试的一切都奏效了,显然它完成了使命。

大家玩得开心。如果是 SDXL,这个模型很可能可直接使用其 LoRA 或与其合并。

更新10:BeatriXL 与 Forge 不兼容

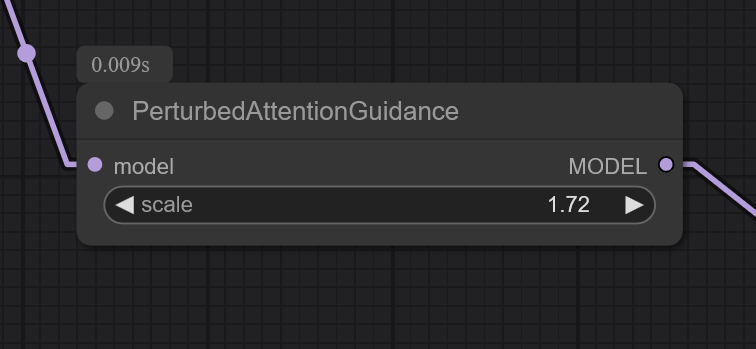

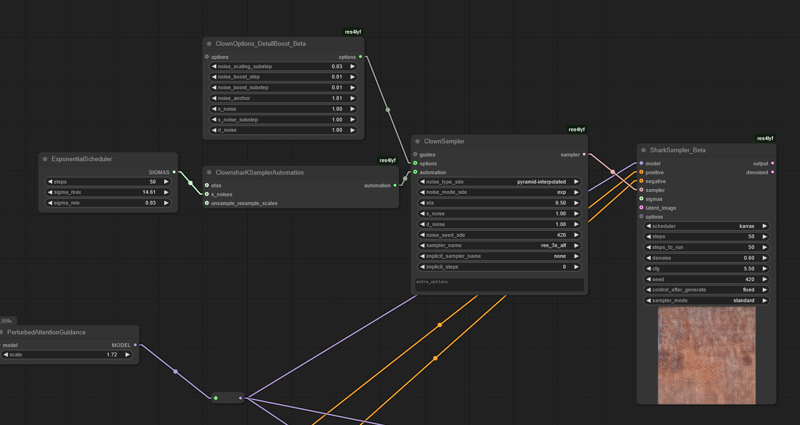

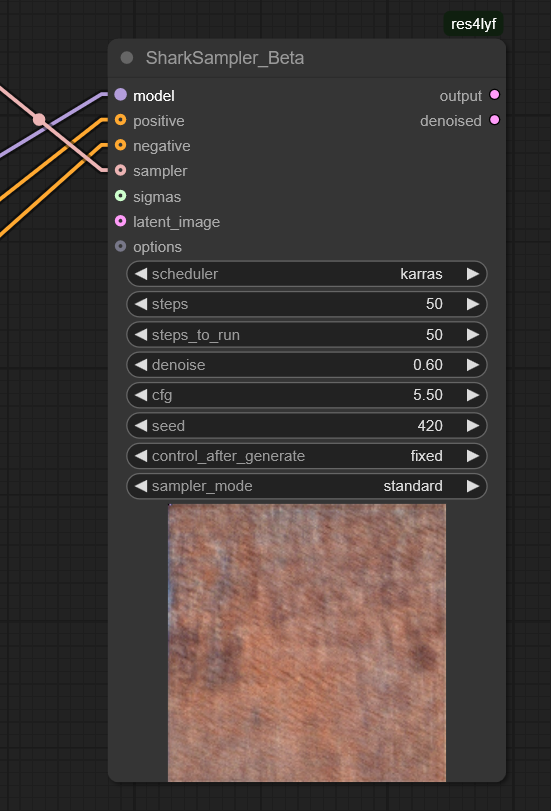

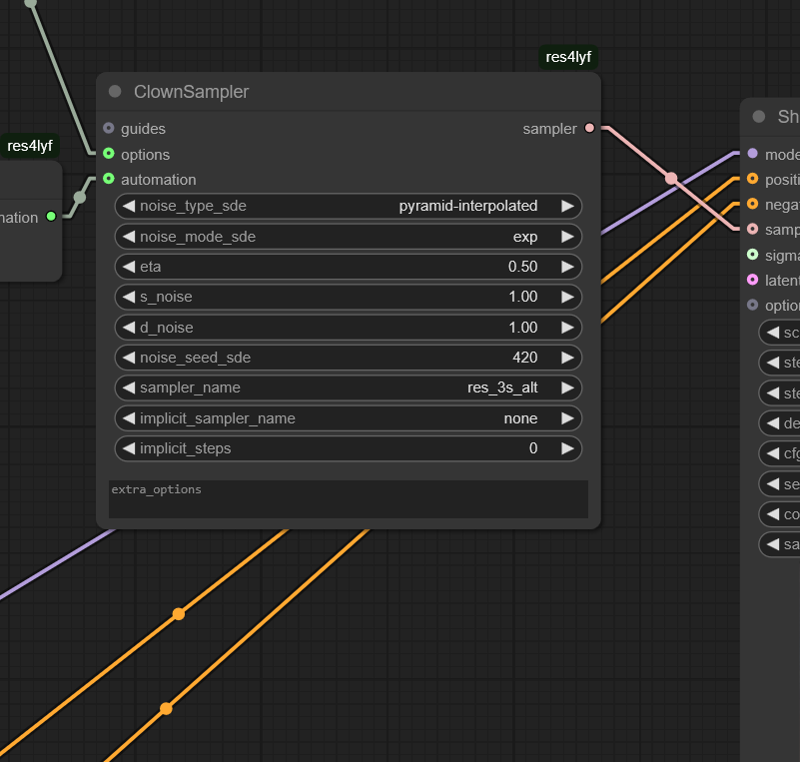

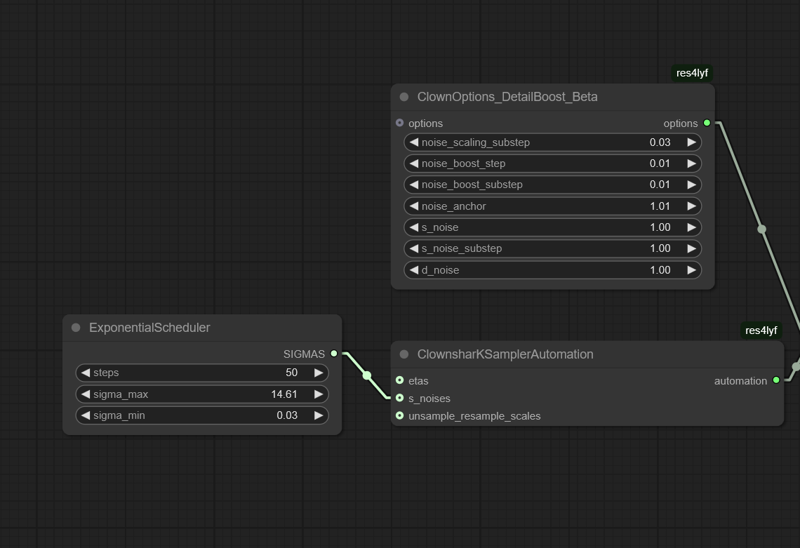

使用 res4lyf 搭建简单的 ComfyUI 系统效果更好。

我将准备一个简易工作流和一个复杂工作流,以充分发挥该模型的全部行为能力。

更新9:BeatriXL 发布

BeatriXL 是一个基于 V-PRED(速度预测)的 SDXL 蒸馏模型。该模型通过其父模型 Beatrix 的特征插值进行蒸馏。

由于是 V-PRED 模型,你必须使用 V-PRED 生成,否则图像将无法正确生成。它可能在 epsilon 上生成一些内容,但我怀疑你能看到什么。

与 OMEGA V0001 不同:

该模型使用 KARRAS 噪声效果更佳。

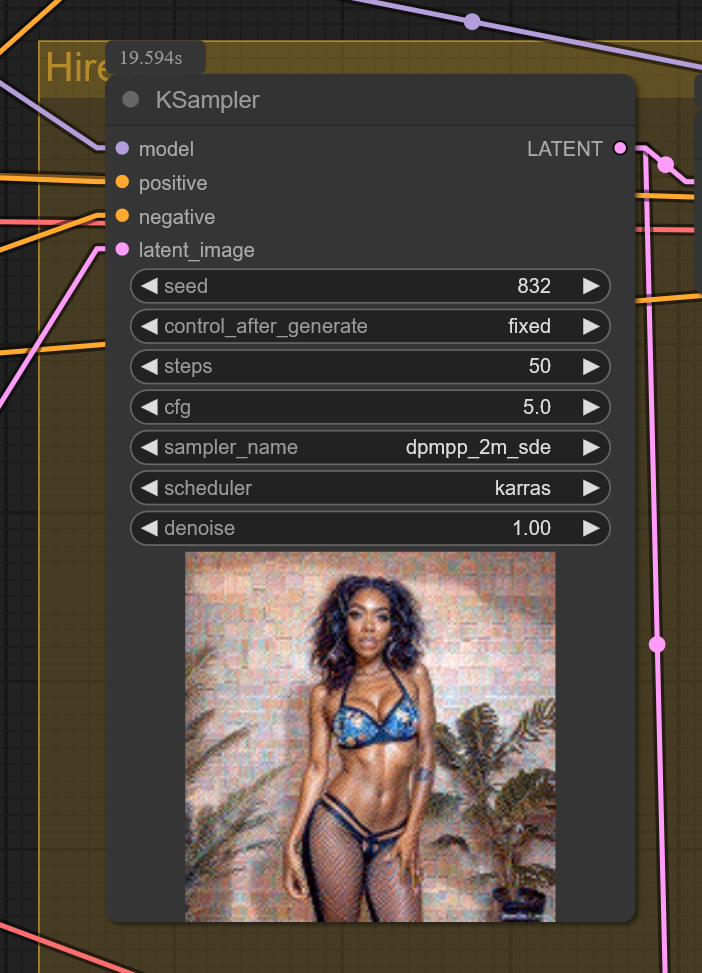

我建议从以下配置开始:

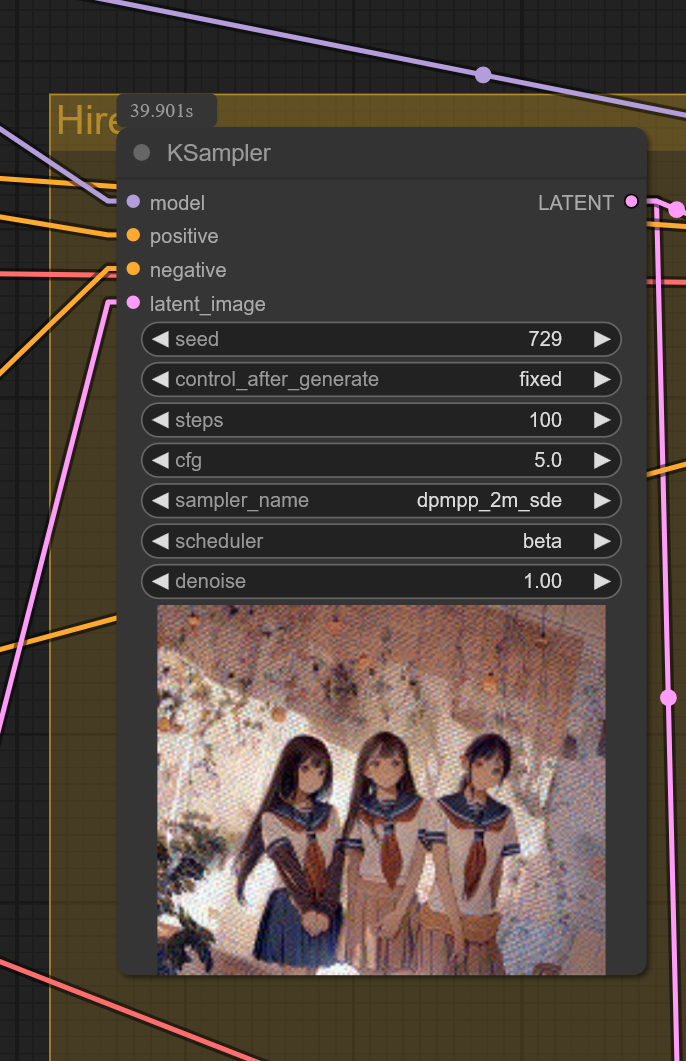

[ EULER_A, RES_2S ] << txt2img

[ EULER_A, RES_2S, RES MULTISTEP ] < img2img

[ LCM, DEIS ] < 两者皆可能失败

[ SGM UNIFORM ] << 动漫风格

[ NORMAL / SIMPLE ] << 效果良好

[ KARRAS, EXPONENTIAL ] << 最佳

[ DDIM_UNIFORM ] << img2img

8 至 50 步

1024x1024 / 1216x1216

大部分展示图均使用 8 步、CFG 5、1216x1216 与简单提示词生成。

使用 DPP_2M_SDE 无法获得良好效果,但使用 DPP_2S 和 RES_2S_SDE 可获得相当不错的结果。

正面提示词:

杰作,最美学,非常美学,

<艺术类型>

<number>人/无人物,# 可交换

<number>女孩/<number>男孩,# 可交换

<人物正在行动的描述>

<建筑环绕人物存在的描述>

高分辨率,超分辨率,

<艺术风格年份>

负面提示词:

低分辨率,低质量,成人内容,

模糊,

令人不悦,非常令人不悦,恶心,

<用简单英文描述你不想看到的内容>

<其他标签>

网格标签可作为普通词直接添加在正/负提示词中,它们在增删细节方面极为强大。

例如:grid_a1 穿红色头发和蓝色鞋子的人,grid_c4 抓着贝果的手等。

通过描述赋予人物特征并加以控制。BeatriXL 表现尚可,但不会完美。我的数据所能学习的提示词数量是有限的。

我额外采集了来自各行各业的25万张安全真实图像,用于增强三维环境(建筑)、植物生命(植物)、动物生命(修复破损动物)、高保真电影场景、废墟(传统氛围)、奢华(富丽堂皇)、时尚场景(服装细节)、性姿势与姿态(更好地隔离低俗内容,避免误用)、附加的 ONNX 世界对象(与网格细节关联)等。

这些图像均使用 GPT4o、LLAVA LLAMA、T5 结合 BLIP 和 CLIP 询问器进行精细标注,并通过视觉识别套件处理。该过程缓慢,但值得期待——当我在第3版中重新引入大量 LAION 数据并配合新标注进行再训练时,成果将更加显著。

此外,CLIP 套件将协助调试与测试,无需使用奇怪的程序组合。我只需在 Pod 上快速替换内容,即可直接导入 ComfyUI 工作流进行即时测试与调试,这将节省大量模型迁移时间与精力。

—

如果你好奇它能做什么?它什么都能做。如果你不知如何操作,请调整设置直到它符合你的预期。最终它会奏效。它比它应有的更聪明,且拥有支持这些能力的细节。

与原始的 Omega V0001 相比,BeatriXL 在直接生成个人图像时可能可靠性更低,生成速度也更慢。但其在场景与环境的灵活性上远超诸多方面:包括阈限空间、建筑、物体、光线,以及 Omega 所缺乏的无数细节。BeatriXL 对角度、偏移、深度、旋转及更多摄像机视角、深度与关联的适配能力也强得多。

它失去了 Omega 模型在高保真图像上的即时控制能力,这也是我迟迟未发布它的原因之一。我一直在寻找改进方法,以减少这种“不可靠”的结果。

该模型没有 LoRA。LoRA 的大小是此模型的11倍。此模型的真正形态……呃……有所不同,它是 FLUX 和 SD35-L 的放大版本,在两块 A100 上生成一张图需近两分钟。

我将其压缩为……可管理的形式。但这并不容易。

简而言之,它的行为将类似 Omega——因为它基于相同流程,只是拥有更多功能,并基于 0001 构建,因此应与 0001 行为高度相似,但它并非同一模型。

你将立即看到它有多不稳定,又有多稳定。数学估计显示,要达到完全无约束、稳定的艺术控制网格描绘状态,需要近1.4亿个样本进行强化训练——而它尚未具备这样的图像训练量。

然而,SD3.5M 在几乎没有 T5XXL UNCHAINED 训练的情况下,已展现出部分相同优势——这将是 Omega 蒸馏流程的下一版本。将 T5XXL UNCHAINED 训练为“线性插值机器”,可大幅缩短微调时间并提高一致性。

更新8

通过使用假人肢体进行早期训练,专家们完全如预期般融合。

简单复杂性用较少步数,绝对复杂性用更多步数。

在 Euler A 和 Beta 噪声下,CFG 为 5 时,仅需 8 步即可。

Beta 噪声是一种在整个训练系统中保持恒定的噪声类型。

使用 Beta 噪声,能以谨慎方式访问早期学习成果,而不会破坏堆叠在其上的专家信息。

因此,你无需复杂的提示词就能生成复杂图像,也无需复杂的数字设置,仅需标准 8-20 步,类似 SDXL Lightning,但未作相同调校。

此蒸馏模型不遵循 SDXL Lightning 的二元对立结构,因此不要期待将它与这些模型合并能获得相同效果。这是一个基于 SDXL base 1.0 的分支模型,不兼容 SDXL Lightning 及其差异。

更新7

它在15个金丝雀提示词中达到了12个完全准确。我们有个 B 级学生;80% 或更高的能力已达成。它具备标准 SDXL 80% 的上下文潜力……且已蒸馏。

哇……我原本以为蒸馏版压根不会工作,更别说仅用少量微调步骤就达到如此惊艳的效果。

此外,它似乎能兼容我尝试的所有 LoRA。我原以为它不会在标准采样器与噪声下表现得如此出色。

—

更新6

我将做一件我通常不会做的事:展示这些模型真正的威力。

它们能做一切。绝对的一切。这个模型将关闭大量人的成见之门。

Heathen hours 时间。

在你自问“它能做什么?”之前……

这东西……呃……太聪明了。正如我所说。

—

更新4

别训练 CLIP。它们太强大了,这模型已接近真正令人震撼的境界,目前它只需要 UNET 一段时间即可。

负面提示词:

恶心,非常不悦,不悦,错误解剖结构,

score_1, score_2, score_3,

anthro, furry, semi-anthro, 错误编辑,

jpeg 压缩伪影,丑陋男性,guro,变异,触手,

单色,灰度,

低分辨率,文字

这是我目前在不彻底拆解它的情况下,所能达到的最接近数学极限的形态。

这是我目前在不彻底拆解它的情况下,所能达到的最接近数学极限的形态。

更新 3

安全微调正在失败。我将给它一百万张图像,看看它是否变得更合规。

更新 2

更多真实感

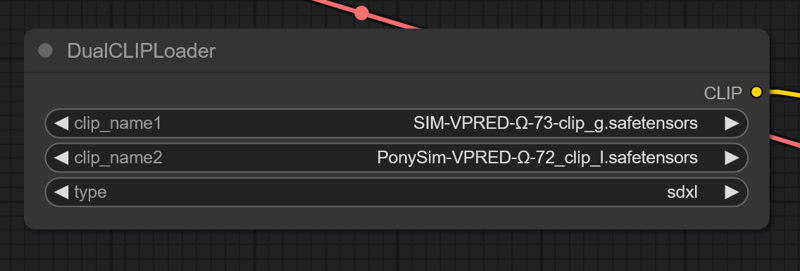

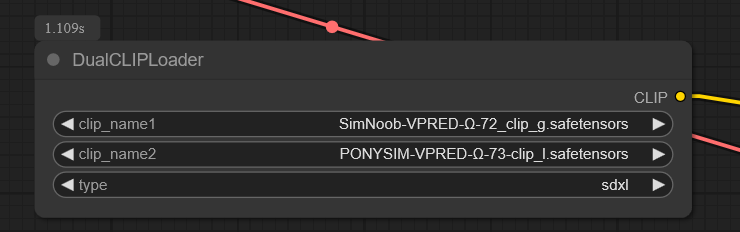

由于PonySim原始模型对真实感有极佳的适配性,你可以直接使用原始PonySim的CLIP_L,让本模型的真实感表现得尤为突出。

由于PonySim原始模型对真实感有极佳的适配性,你可以直接使用原始PonySim的CLIP_L,让本模型的真实感表现得尤为突出。

更多动漫风格

更新 1 LORA实验

该模型在训练时,仅使用了高时间步,而排除了所有专家提供的低时间步。

此规则无任何例外。这使得LoRAs能够正常工作。

许多LoRAs在训练时仅考虑0到1000步,完全忽略了模型的IMG2IMG特性。

本模型的训练时间步主要集中在200到800之间,最多不超过50到950。

因此产生的结果是:许多来自不同模型的LoRAs都能有效工作;

包括Illustrious、Pony、Noob和SDXL的LoRas。

你不会得到完全相同的结果,因此不要期望完全一致,但你完全可以引导出许多本模型原本不具备的元素。

“与怪物战斗的人,应当小心自己不要成为怪物。当你凝视深渊时,深渊也在凝视你。”

——弗里德里希·尼采

如果世界的存在离不开善与恶,那么为什么人类创造的AI却可以没有二者?

答案……也许某一天会揭晓。

首个同类模型:跨训练的VPRED融合体。

推荐尺寸:

1216x1216

可处理最高达1742x1742的图像

推荐采样器:

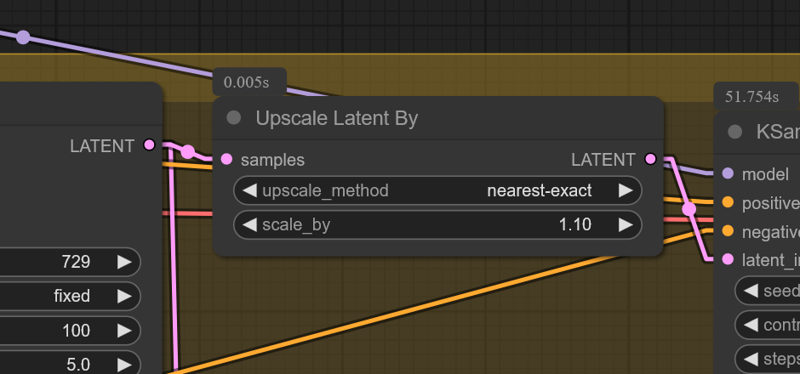

从1216或1472放大1.10倍以上 >

首选采样器:DPMPP SDE GPU

可处理极高与极低的CFG值。

支持LCM;意味着插值视频成为可能。

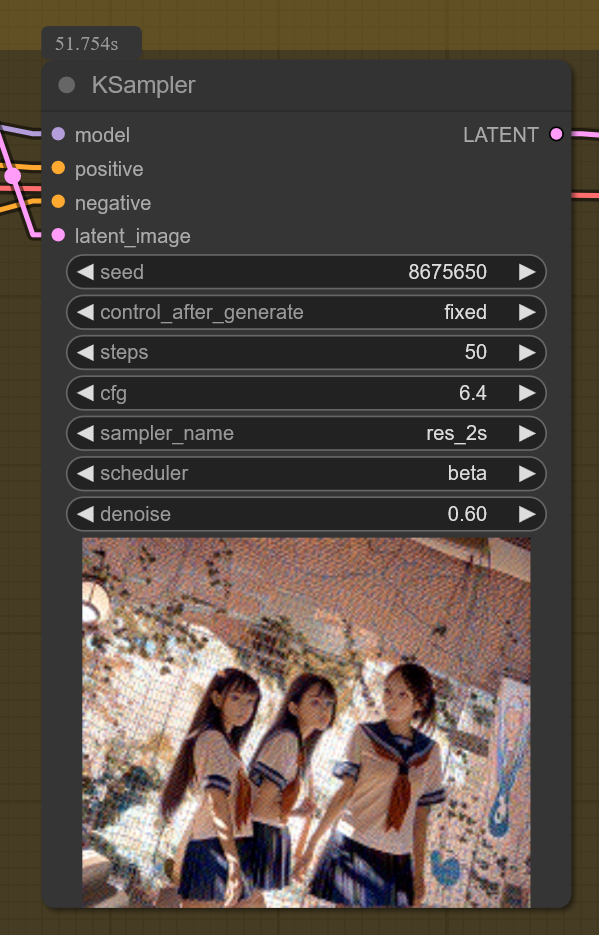

score_9, score_8, score_7, score_6,

real, neutral lighting,

3girls, standing, side-by-side,

school uniform, trio,

masterpiece, best quality, newest, very awa,

它本质上是四个模型的集合体。

本模型的基础是PonySim -> VPRED,因此如果你仔细比对差异,会发现大量PonySim-VPRED的特征。

然而,无论此插值蒸馏过程如何复杂,它都需要一个基础。本模型是以Pony为基础的;其他模型可能基于Pony,也可能基于零初始化模型、其他模型,或完全从头训练的模型——如今尚难断言。

因此,它被标注为“融合”;它确实是融合!无论我做了多少次微调,最终产物始终是一个“融合”!无论其复杂性如何。

你一定会看到一些成长的阵痛。

但这是首个同类模型。

每个模型均使用非常相似的数据进行微调,最强大的UNet特征被提取并结合,最先进的CLIP也被通过Comfy进行融合。

整个模型包通过修改过的ComfyUI UNet融合模块与标准的简单CLIP融合工具,使用ComfyUI的VPRED检查点保存节点进行合并。

组成成分:

SimNoob V5:28% 最密集的目标特征

Sim V5:12% 最密集的目标特征

NoobSim:8% 最密集的目标特征

PonySim:40% 最密集的目标特征

通过余弦差异插值生成12%的特征;

每步平均损失:21.01~(数值越高越好)

使用STAGE_1 T5 UNCHAINED进行12,000步插值,完全依赖特征本身;足以注入所需特征。

更新:

- 我后来发现,当时所用的T5-UNCHAINED并不理想,它几乎在自我坍塌。我实际上是在使用T5XXL,偶尔因分词器产生泄露。

具备极端VPRED能力。

这只是未来模型潜力的冰山一角。训练越多,它将越强大。只要我遵循特征与维度数学的规范,似乎没有上限。

我将很快能蒸馏出更小的模型:响应更快,体积更小,但功率更强大,专用于特定任务。

例如:

像素艺术

模糊边界(liminal)

时尚

解剖学

以及其他更多

蒸馏的概念并不新颖,而这是首次实验所取得的美妙成果。