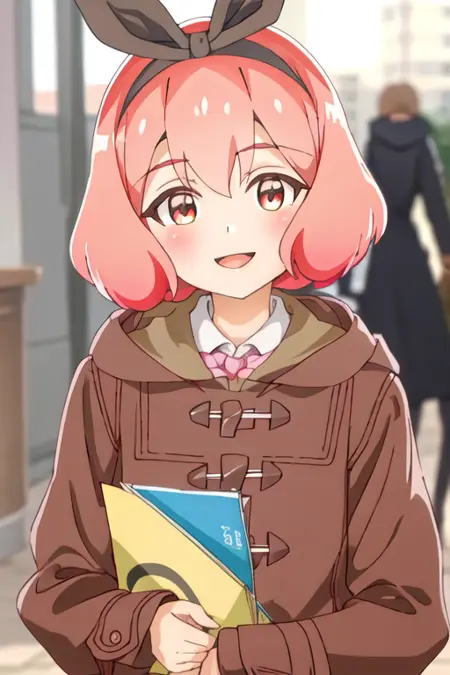

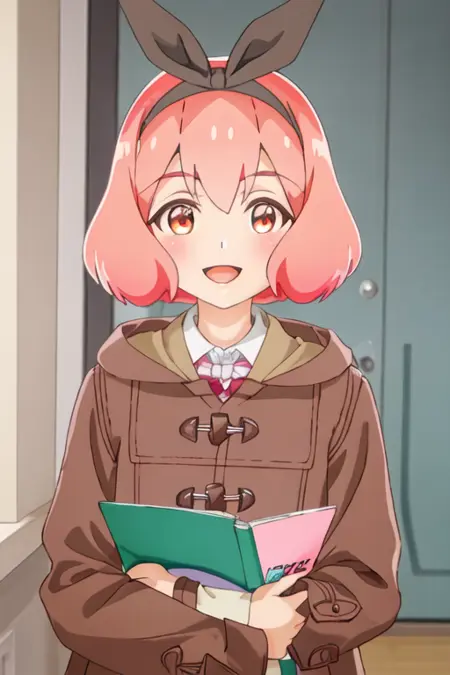

Koshiba Mai (Watashi no Yuri wa Oshigoto Desu!)

详情

下载文件

关于此版本

模型描述

- 此模型包含两个文件,您必须同时使用它们!!!

- 关联的触发词仅作参考,有时可能需要调整。

- 嵌入模型的推荐权重为1,可提供更高保真度;如需更强的泛化能力,可降低至0.5。

- LoRA模型的推荐权重为0.85;若发现污染迹象,建议降至0.5。

- 预览图使用若干固定测试提示词及从聚类数据集特征衍生的提示词生成,采用随机种子,排除了人为挑选。所见即所得。

- 未对服装进行专门训练。您可查阅我们提供的预览帖,获取对应服装的提示词。

如何使用此模型

此模型包含两个文件,您必须同时使用它们!!!。在此情况下,您需要下载 koshiba_mai_watashinoyuriwaoshigotodesu.pt 和 koshiba_mai_watashinoyuriwaoshigotodesu.safetensors 两个文件,然后将 koshiba_mai_watashinoyuriwaoshigotodesu.pt 用作纹理反转嵌入,同时将 koshiba_mai_watashinoyuriwaoshigotodesu.safetensors 用作LoRA。

このモデルには2つのファイルがあります。一緒に使う必要があります!!!。 この場合、koshiba_mai_watashinoyuriwaoshigotodesu.ptとkoshiba_mai_watashinoyuriwaoshigotodesu.safetensorsの両方をダウンロード する必要があります。koshiba_mai_watashinoyuriwaoshigotodesu.ptをテクスチャ反転埋め込みとして使用し、同時にkoshiba_mai_watashinoyuriwaoshigotodesu.safetensorsをLoRAとして使用してください。

这个模型有两个文件。你需要同时使用它们!!!。 在这种情况下,您需要下载koshiba_mai_watashinoyuriwaoshigotodesu.pt和koshiba_mai_watashinoyuriwaoshigotodesu.safetensors这两个文件,然后将koshiba_mai_watashinoyuriwaoshigotodesu.pt用作纹理反转嵌入, 同时使用koshiba_mai_watashinoyuriwaoshigotodesu.safetensors作为LoRA。

이 모델은 두 개의 파일이 있습니다. 두 파일을 함께 사용해야 합니다!!!. 이 경우에는 koshiba_mai_watashinoyuriwaoshigotodesu.pt와 koshiba_mai_watashinoyuriwaoshigotodesu.safetensors 두 파일을 모두 다운로드하신 다음에 koshiba_mai_watashinoyuriwaoshigotodesu.pt을 텍스처 반전 임베딩으로 사용하고, 동시에 koshiba_mai_watashinoyuriwaoshigotodesu.safetensors을 LoRA로 사용하셔야 합니다。

触发词为 koshiba_mai_watashinoyuriwaoshigotodesu,推荐标签为:best quality, masterpiece, highres, solo, {koshiba_mai_watashinoyuriwaoshigotodesu:1.15}, pink_hair, short_hair, hairband, ribbon, hair_ribbon, smile, bangs, black_ribbon, blush, open_mouth, brown_eyes。

模型训练方式

本模型使用 HCP-Diffusion 进行训练,自动训练框架由 DeepGHS 团队 维护。

为何部分预览图与Koshiba Mai Watashinoyuriwaoshigotodesu形象不符

所有预览图使用的提示文本(可通过点击图片查看)均通过基于训练数据集特征提取的聚类算法自动生成。图像生成时使用的种子也是随机生成,图像未经过任何人工筛选或修改。因此,可能出现上述问题。

实际使用中,根据我们内部测试,绝大多数遇到此类问题的模型在真实应用中的表现,往往优于预览图所示效果。您唯一可能需要做的,就是调整所使用的标签。

我感觉此模型可能存在过拟合或欠拟合,我该怎么办?

我们的模型已发布于 huggingface 仓库 - CyberHarem/koshiba_mai_watashinoyuriwaoshigotodesu,其中保存了所有训练步骤的模型。同时,我们也公布了训练数据集于 huggingface 数据集 - CyberHarem/koshiba_mai_watashinoyuriwaoshigotodesu,这可能对您有所帮助。

为何不直接使用筛选过的优质图像?

本模型从数据采集、训练、生成预览图到发布,整个流程完全自动化,无人为干预。这是我们的团队进行的一项有趣实验,为此我们开发了一整套软件基础设施,包括数据过滤、自动训练和自动化发布。因此,若您能提供反馈或建议,我们将非常感激,因为它们对我们极为宝贵。

为何无法精确生成目标角色的服装?

我们当前的训练数据来源于多个图像网站,对于全自动流程而言,难以准确预测角色拥有哪些官方图像。因此,服装生成依赖于对训练数据集中标签进行聚类,以期实现最佳还原效果。我们将持续改进这一问题,但目前仍无法完全解决。服装还原的准确性也难以达到人工训练模型的水平。

实际上,本模型最大的优势在于精准还原角色本身的内在特征,以及因数据量更大而具备的较强泛化能力。因此,本模型非常适合用于更换服装、调整角色姿势,当然也包括生成角色的NSFW图像!😉

以下群体不建议使用本模型,我们深表遗憾:

- 对角色原设计的任何细微偏差都无法容忍者。

- 对角色服装还原精度要求极高者。

- 无法接受基于Stable Diffusion算法生成图像所固有的随机性者。

- 对使用LoRA全自动训练角色模型感到不适,或认为训练角色模型必须完全手动操作以示尊重者。

- 认为生成图像内容违背自身价值观者。