Simple Self-Forcing Wan1.3B+Vace workflow

세부 정보

파일 다운로드

모델 설명

이 작업 흐름은 Self-Forcing Wan 1.3B + VACE를 실행하기 위한 매우 간단한 방법입니다. 이 작업 흐름은 단 하나의 맞춤형 노드만 사용하며, 이 노드는 영상을 제작하는 모든 사람이 이미 보유하고 있어야 합니다: Kosinkadink/ComfyUI-VideoHelperSuite. 그 외 모든 것은 순수한 Comfy Core입니다.

원하는 모델을 다음 주소에서 다운로드하여 /path/to/models/diffusion_models 폴더에 넣어야 합니다: lym00/Wan2.1-T2V-1.3B-Self-Forcing-VACE · Hugging Face.

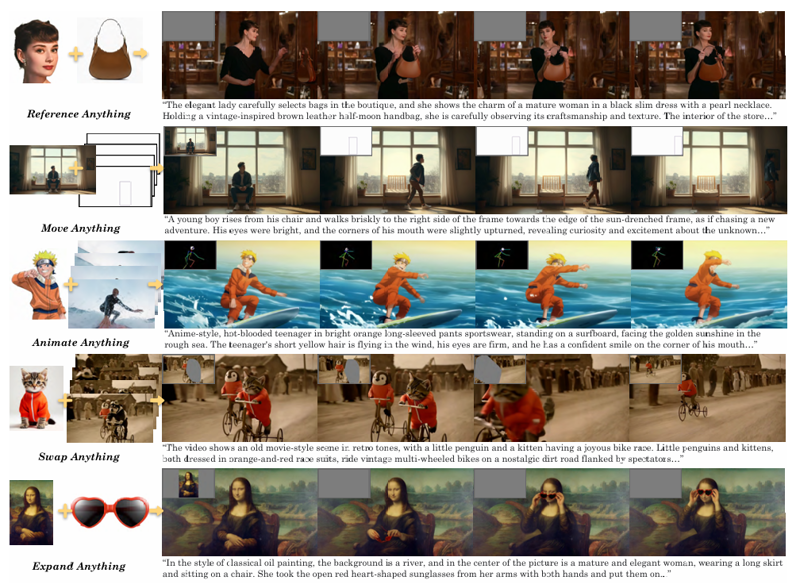

이 작업 흐름은 실험을 시작하기 위한 매우 좋은 출발점이 될 수 있습니다. VACE 사용법에 대해서는 다음 논문을 참고할 수 있습니다: [\[2503.07598\] VACE: All-in-One Video Creation and Editing](https://arxiv.org/abs/2503.07598). 물론 논문을 전부 읽을 필요는 없으며, 관심 있는 정보는 대개 7페이지 상단에 있습니다. 아래에 그 내용을 다시 인용합니다:

기본적으로, WanVaceToVideo 노드에는 세 가지 선택적 입력이 있습니다: control_video, control_masks, reference_image.

control_video와 control_masks는 약간 오해를 불러일으킬 수 있습니다. 반드시 전체 영상을 제공할 필요는 없습니다. 다양한 요소를 제공함으로써 다양한 효과를 얻을 수 있습니다. 예를 들어:

단일 이미지를 제공하면, 이는 대략적으로 image2video와 동일한 효과를 냅니다.

빈 이미지로 구분된 이미지 시퀀스를 제공하면: img1, black, black, black, img2, black, black, black, img3 등... 이는 모든 img를 보간하고 검은 부분을 채우는 것과 같습니다. 이를 명확히 하기 위한 특별한 경우는 img1, black, black, ..., black, img2인 경우로, 이는 start_img, end_img에서 영상으로 변환하는 것과 동일합니다.

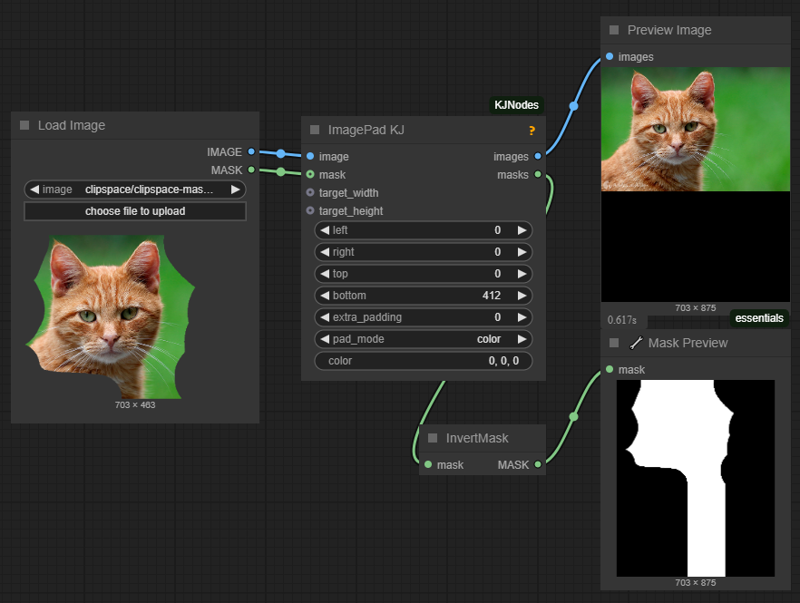

control_masks는 Wan이 어떤 영역에 그림을 그릴지를 제어합니다. 마스크가 1인 위치에는 원본 이미지가 유지됩니다. 따라서 입력 이미지를 패딩하거나 마스킹할 수 있습니다. 예:

이 이미지와 마스크를 각각

control_video와control_mask로 사용하면, image2video inpaint 및 outpaint를 거의 동일하게 수행할 수 있습니다.control_video에 영상을 입력하면,control_mask를 사용하여 변화가 발생할 영역을 동일한 방식으로 제어할 수 있습니다. 이 경우, 영상의 각 프레임마다 하나의 마스크를 설정해야 합니다.OpenPose나 깊이 맵으로 전처리된 이미지를 입력하면, 출력 영상의 움직임을 정밀하게 제어할 수 있습니다.

reference_image 노드는 Wan+Vace에 제공되는 참조용 이미지입니다. 예를 들어, 이곳에 누군가의 얼굴 이미지를 넣으면, 그 사람의 얼굴을 포함한 영상을 얻을 가능성이 매우 높습니다.