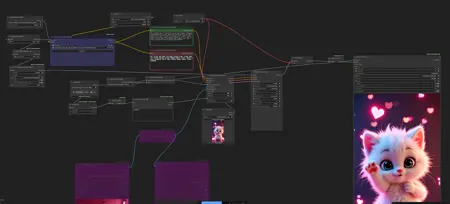

WAN 2.2 S2V Lipsync Workflow with SageAttention + BlockSwap + GGUF (include Upscale and Interpolation)

详情

下载文件

模型描述

大家好!我向大家介绍我在 ComfyUI 中使用 Wan 2.2 S2V 生成视频的工作流程。

你需要拥有 Wan 2.2 S2V 模型。

你需要下载以下模型:

- Wan 2.2 模型:https://huggingface.co/Kijai/WanVideo_comfy_fp8_scaled/tree/main/S2V

- CLIP:https://huggingface.co/Kijai/WanVideo_comfy/blob/main/umt5-xxl-enc-bf16.safetensors

- 音频编码器:https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/audio_encoders

- VAE:Wan 2.1 VAE

GGUF:https://huggingface.co/QuantStack/Wan2.2-S2V-14B-GGUF/tree/main

此外,我还包含了 LoRA https://huggingface.co/Kijai/WanVideo_comfy/tree/main/Lightx2v,以实现更优且更快的生成效果。

建议将 LoRA 的强度设置为 1.5,以获得最佳结果。

你还需要安装 Sageattention 2.2.0(带 Triton):https://huggingface.co/Kijai/PrecompiledWheels/tree/main,以及 Torch 2.7.0+ 以加快生成速度:https://github.com/pytorch/pytorch/releases。同时,请下载并安装 CUDA 12.8:https://developer.nvidia.com/cuda-12-8-0-download-archive 和 VS Code:https://visualstudio.microsoft.com/downloads/

安装 Sageattention 的说明(1.0.6 版本):要安装 Sageattention 2.2.0,请将 .whl 文件重命名为 .zip,然后将 .zip 中的文件夹解压至 ComfyUI\python_embeded\Lib\site-packages。

只需使用音频、图像,编写提示词,即可开始享受生成!

如果你在使用过程中遇到问题或发现工作流的错误,请留下评论!