Z-image-Prompting-Json

詳細

ファイルをダウンロード

モデル説明

単純なCOMFYUIノードで、コミュニティの議論https://www.reddit.com/r/StableDiffusion/comments/1p809wt/をインスピレーションにしています。

しかし、私の結論として、JSONコンテンツを直接入力すると画像に大量のエラー情報が発生します。

しかし、このアイデアは構造化されたプロンプトを生成できます。

z_image_json_prompt.pyをIComfyUI\custom_nodesに置くだけで済みます。

これにより、必要なファイルを自動的に生成するディレクトリが作成されます。

z_image_json_prompt.jsonはデモワークフローです

Z-image JSON Prompting for ComfyUI

Redditのコミュニティ議論をインスピレーションにした、JSON形式で構造的で詳細なプロンプトを生成するComfyUIカスタムノード。

画像を表示 画像を表示 画像を表示

💡 コンセプト

JSONを画像モデルに直接入力するとアーティファクトやエラーが発生する(テスト済み)ため、このノードは別のアプローチを取ります:

✅ 構造化されたJSONプロンプトを生成し、整理・再利用を可能に

✅ 実際の画像生成用に最適化されたテキストプロンプトに変換

✅ 読みやすい形式で詳細なプロンプトコンポーネントを保持

これは、直接的なJSON→画像生成ではなく、プロンプト構築フレームワークと考えてください。

✨ 特徴

📋 三重出力形式

JSON出力 - すべてのコンポーネントを含む完全な構造化プロンプト

テキスト出力 - 画像生成用に最適化されたポジティブプロンプト

ネガティブプロンプト - 別途のネガティブガイド

🎨 詳細なコンポーネントカテゴリ

プロフェッショナルな写真や映画制作ワークフローをインスピレーションに:

CategoryComponentsScene全体のシーンの説明Subjectタイプ、肌の詳細、衣装、髪型、ポジション、表情Action主な行動、視覚効果Environment設定、背景要素、雰囲気Cameraレンズ仕様、角度、フィルムシミュレーションLightingスタイル、キーライト、フィルライト、コントラストStyleメディア、美的感覚、品質、カラーパレット、特別レイヤー

🎲 スマートランダマイズ

各パラメータは

random、none、または手動選択に対応カーディナルなオプションファイルから自動生成

テキストファイルで簡単にカスタマイズ可能

🔄 自動セットアップ

初回実行時に

z_image_optionsフォルダを自動作成デフォルトですべてのオプションファイルを自動生成

手動設定は不要

📦 インストール

方法1:直接ダウンロード(推奨)

z_image_json_prompt.pyをダウンロード以下に配置:

ComfyUI/custom_nodes/ComfyUIを再起動

ノードが自動的に必要なファイルを含む

z_image_optionsフォルダを作成

方法2:Gitクローン

bash

cd ComfyUI/custom_nodes/

git clone https://github.com/yourusername/z-image-json-prompting

# ComfyUIを再起動

フォルダ構成(自動生成)

ComfyUI/

└── custom_nodes/

├── z_image_json_prompt.py

└── z_image_options/ # 初回実行時に自動作成

├── scene_description.txt

├── subject_type.txt

├── skin_detail.txt

├── attire_detail.txt

└── ...(さらに22個のオプションファイル)

🚀 使用方法

基本ワークフロー

ノードを追加:ComfyUIで

Z-image JSON Promptingを検索パラメータを設定:ドロップダウンから選択、または"random"を使用

出力を接続:

json_prompt→ テキスト表示ノードまたは保存ノード(ドキュメント用)positive_text→ 画像モデルのポジティブプロンプトnegative_prompt→ 画像モデルのネガティブプロンプト

デモワークフロー

デモワークフローが含まれています:z_image_json_prompt.json

使用方法:

z_image_json_prompt.jsonをComfyUIにドラッグワークフローは3つの出力をすべて示しています

必要に応じてパラメータをカスタマイズ

出力例

JSON出力:

json

{

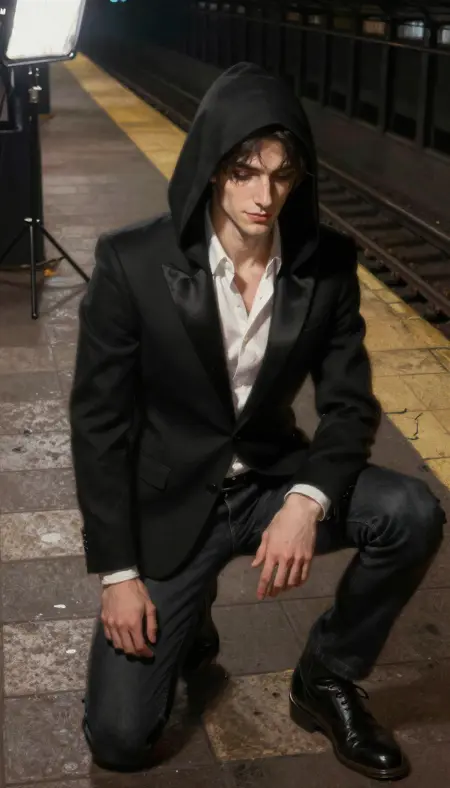

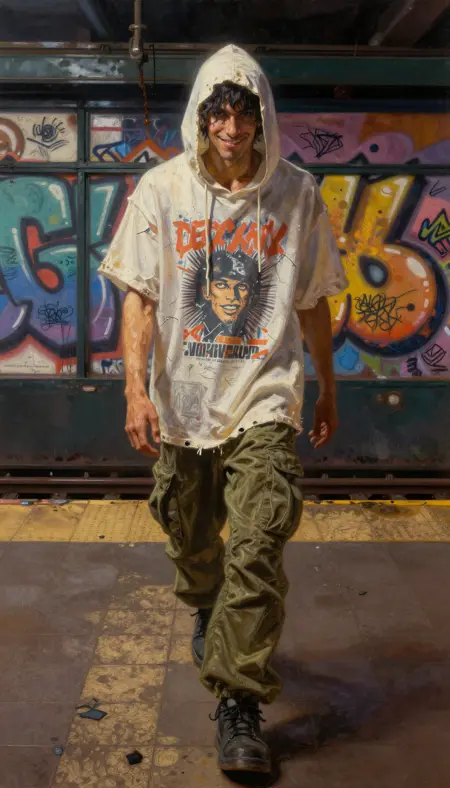

"scene_description": "ハイパーリアリスティックなストリートフォトグラフィーと爆発的な2Dのオールドスクールヒップホップグラフィティのデュードルが融合",

"subject": {

"type": "クールな黒人/ラテン系の若い男性、20代前半、ストリートダンサー体型",

"skin": "ナチュラルな肌の質感、細かい毛穴、軽い汗の光沢",

"attire": "オーバーサイズの白いグラフィックTシャツ、オリーブのカーゴパンツ、布のしわ",

"hair": "新鮮な中長さのツイストスポンジカール",

"position": "ダイナミックな低いしゃがみ姿勢、片膝を地面に着く",

"expression": "目を半閉じ、控えめな笑み、ビートに集中"

},

"camera_settings": {

"lens": "35mm f/1.4プライムレンズ、f/2.0で撮影",

"angle": "低角度のストリートフォトグラフィーパースペクティブ"

},

...

}

テキスト出力(画像生成用):

ハイパーリアリスティックなストリートフォトグラフィーと爆発的な2Dのオールドスクールヒップホップグラフィティのデュードルが融合、8K解像度で異常にシャープ、超詳細なフォトリアリスティックな写真、対象:クールな黒人/ラテン系の若い男性、20代前半、ストリートダンサー体型、オーバーサイズの白いグラフィックTシャツ、オリーブのカーゴパンツを着用、ダイナミックな低いしゃがみ姿勢、片膝を地面に着き、目を半閉じて控えめな笑み、音楽に深く没頭し、ベースのドロップを感じる、設定:夜のグリミーなNYCスタイルの地下鉄プラットフォーム、低角度のストリートフォトグラフィーパースペクティブ、厳しい天井の蛍光灯照明、生の都市のエネルギー、リズミカルで大声の若者反抗

🎨 カスタマイズ

オプションの編集

すべてのオプションはz_image_options/以下のプレーンテキストファイルに保存されています:

bash

# 例:サブジェクトタイプを編集

nano z_image_options/subject_type.txt

フォーマット: 1行に1つのオプション

クールな黒人/ラテン系の若い男性、20代前半、ストリートダンサー体型

エレガントなアジア系女性、20代後半、プロフェッショナルモデル体型

神秘的なフード付きの人物、年齢不詳、スリムで筋肉質な体型

# ここに独自のオプションを追加

新しいオプションの追加

どの.txtファイルにも新しい行を追加するだけで、次回の再起動時にドロップダウンに表示されます。

🔧 パラメータリファレンス

シーンレベル(1パラメータ)

scene_description- 全体のシーン概要とスタイル説明

サブジェクト(6パラメータ)

subject_type- キャラクターのタイプ、年齢、体型skin_detail- 肌の質感、毛穴、肌の詳細attire_detail- 衣服の説明(生地と着用感の詳細)hair_style- 髪の長さ、スタイル、状態position- 体のポーズと配置expression- 顔の表情とムード

アクション(2パラメータ)

primary_action- 主な行動や活動visual_effect- 行動に伴う特殊な視覚効果

環境(3パラメータ)

setting- 場所と環境の説明background_elements- 特定の背景の詳細atmosphere- 全体のムードと大気条件

カメラ設定(3パラメータ)

lens_spec- レンズの種類、焦点距離、絞りcamera_angle- カメラの位置と視点film_simulation- フィルムスタックのエミュレーション設定

照明(4パラメータ)

lighting_style- 全体の照明アプローチkey_light- 主要な光源の説明fill_light- サブ/フィル照明の詳細contrast_level- シャドウとハイライトのコントラスト

スタイル(5パラメータ)

render_medium- レンダリングスタイルとメディアaesthetic- 全体の芸術的方向性quality_setting- 解像度と品質の記述color_palette- カラースキームとトーンspecial_layer- 特殊効果またはオーバーレイスタイル

🤔 なぜ直接JSON入力しないのか?

Redditスレッドで議論されたように、テストした結果、Stable Diffusionモデルに生のJSONを直接入力すると以下が発生します:

❌ 画像内にテキストアーティファクトが発生

❌ JSON構文が視覚的要素として表示

❌ 実際の意図される内容の理解が悪化

このノードは次のようにして解決します:

✅ プロンプト構造をJSONとして保存(整理用)

✅ 最適化されたテキストに変換(生成用)

✅ 両方のフォーマットを維持(柔軟性の確保)

📊 使用ケース

1. プロフェッショナルワークフロー

詳細なプロンプトドキュメンテーションを維持

複雑なプロンプトのバージョン管理

構造化されたフォーマットでのチームコラボレーション

2. プロンプトリブラリー

JSONプロンプトを再利用可能なテンプレートとして保存

コンポーネントをミックス&マッチ

システマティックにプロンプトコレクションを構築

🐛 トラブルシューティング

インストール後にノードが表示されない

ファイルが

ComfyUI/custom_nodes/に正しく配置されているか確認ComfyUIを完全に再起動

Pythonエラーをコンソールで確認

オプションが読み込まれない

z_image_optionsフォルダは初回実行時に自動作成されます存在しない場合は削除して再生成させましょう