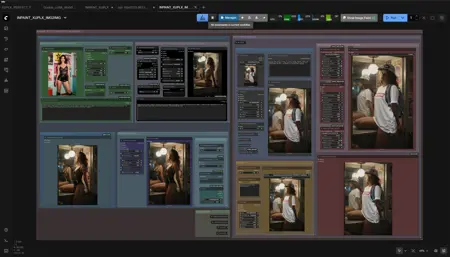

XUPLX_INPAINT_IMG2IMG-REFINEMENT_UPSCALE

详情

下载文件

模型描述

README: XUPLX ZIMAGE 合并 + 修复 + 图到图 + 放大工作流

1) 核心模型堆栈 + 目标分辨率:

基础 UNet 检查点:z_image_turbo_bf16.safetensors

CLIP:qwen_3_4b.safetensors(搭配 lumina2)

VAE:ae.safetensors

主潜在画布为 1024×1536(SD3 潜在节点),因此此工作流默认生成该尺寸的肖像格式图像。

2) “双提示,单种子”策略:

工作流先生成“情绪(MOOD)”,再后期生成“自然语言(NATURAL LANGUAGE)”,你可以调节两者之间的“混合比例”。

具体实现机制如下:

所有采样器共享一个固定种子(seed = 01234567890)。

一个全局 STEPS 整数(设为 20),供多个采样器使用。

共享的 END_AT/START_AT 整数(设为 5),因此第一阶段运行 0→5 步,第二阶段运行 5→20 步。

“混合旋钮”为 ModelSamplingAuraFlow,在继续潜在空间的分支中设为 5(README 中称此为“中间位置”调节)。

“情绪”与“自然语言”提示通过 Mixlab TextInput_ 节点(标记为“MOOD”和“NATURAL LANGUAGE”)集中管理,并通过链接驱动 CLIPTextEncode 节点。

3) LoRA 的作用(以及其适用/不适用范围):

可加载一个可选 LoRA(XUPLX_UglyPeopleLoRA.safetensors);强度设为 0.4 / 0.4,默认开启。

LoRA 修改后的模型仅用于工作流的“情绪(MOOD)”部分,其他部分(尤其是修复分支)仍使用基础模型路径。XUPLX LoRA 为可选,基于真实照片训练。

下载 XUPLX_UglyPeopleLoRA:

/model/2220894/xuplxuglypeoplelora

4) 修复阶段(掩码来自 CLIPSpace):

生成完成后,执行经典修复步骤:

加载你的合并图像(直接复制粘贴到“加载图像”节点中)。

工作流中的修复提示示例:“这位女性正背着一个黑色背包。”

5) 图到图阶段:

图到图(Img2Img)旨在将合并图像中的光照、氛围与主体,与修复后的素材进行合成。去噪强度默认设为 0.45,但会因图像而异。

6) 最后,对图到图输出运行 SeedVR2 放大器:

默认配置输出为 2048×3072 分辨率,并使用“lab”色彩模式。

SeedVR2 的 VAE 设为 ema_vae_fp16.safetensors。强烈建议使用 GGUF 模型进行放大。若 VRAM 清理失败,可能出现内存溢出(OOM)错误,只需重新运行放大即可。

5) 依赖的工具/自定义节点包:

此工作流要求安装多个自定义插件包,包括:

Mixlab 节点(TextInput_)

Comfyroll(CR Load LoRA)

RvTools v2(用于 STEPS、END_AT/START_AT 的整数节点)

rgthree(图像比较器)

WAS 节点套件(Seed 节点)

SeedVR2 放大器包

工作流附带一份 README,你也可以查阅我撰写的文章:

如何使用 XUPLX 和 ZImage Turbo 快速合并图像风格

https://civitai.com/articles/23657/how-to-merge-image-styles-quickly-with-xuplx-and-zimage-turbo

你可在此下载我工作流的简化版本:

/model/2221102/xuplx-merge-workflow

如果你喜欢这个工作流……别给我买咖啡!!

请在 Chrome 网上应用店下载 "ExportGPT - 媒体与聊天导出工具包"。如果你经常使用 ChatGPT 和 Sora,这是无需外部服务器即可快速迁移资源的必备工具。它拥有五星评分,且永久免费!

查看实际效果: exportgpt.org