Geeky Ghost Story Teller

詳細

ファイルをダウンロード

モデル説明

!免責事項! lol – この設定は少しイライラするかもしれません。うまく動作させるには少しの忍耐と理解が必要です。しかし、良い点としては、多くのテクニックやユニークなノードの使い方が含まれており、それらを参考にして活用できます。もし私がうまくいったようにあなたも動作させられれば、それは本当に面白いですよ lol。

これは実験的なものとお考えください。LLMからの一貫した出力に依存しており、このワークフローは複数のLLM自動化セクションを利用しています。通常使用されるよりも大きなLLMが必要です。このようなLLMを使用するワークフローとノードは、タスクに特化した詳細なプロファイル、LLMノード用の詳細なプロンプト指示、そして例が必要です。どのLLMノードも「使用環境により結果が異なります」タイプのノードです。使用するLLM、プロンプト、プロファイルなどによって結果が変わります。

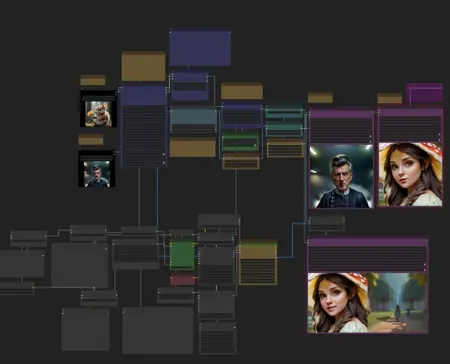

したがって、この設定は非常に不安定で、あなたの使用するLLMに大きく依存します。これは2つの画像を必要とします:1つは物語を語るための画像、もう1つは物語の参照画像です。まだ開発中ですが、今のところは楽しいです。プロンプトスケジュールが最も不安定な部分です。Darwinは基本的に正しい形式で出力しますが、常にそうとは限りません。あなたのLLMの性能によって結果は変わります lol。

このワークフローで注目すべき点:

画像の代わりに動画を使用できます。私は任意のノードをテストしていたため、1枚の画像を19回複製してWav2Lipに動画だと誤認させました lol。実際には動画を使用するか、単一の画像をどのノードでも使用できます。

フレーム数は生成されたオーディオの長さによって決まります。私はそれをBatch to Intノードに送信し、得られた整数をバッチサイズとして使用しています。

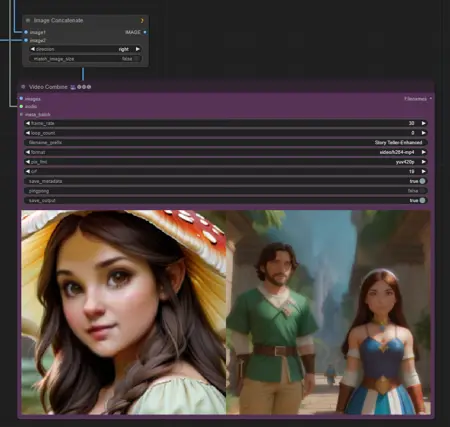

Concatenate Imageノード – 動画が動作するかどうか試してみたところ、うまくいき、とても素晴らしい結果となりました lol。現在、両方の動画が同じフレーム数である必要があります。2番目の動画を補間するか、フレームレートを下げるような解決策を検討中です。

プロンプトスケジュール – Darwinにこの部分をほぼ正しく処理させることは少し難しかったです。まだ300フレームを超える際に論理的に拡張する概念を理解できず、最終プロンプトの末尾に句点やコンマを付けないという制約も時々忘れます。しかし、今のところ十分に機能しています lol。より優れたモデルでは、この問題がより少なくなるでしょう。

Geeky Ghost LCMは、私がPhoton LCMとマージした独自の1.5モデルです。どのLCMモデルでも問題なく動作します。お気に入りのものを選ぶか、自分自身でマージしてください lol。

Darwin(私が使用しているモデル)はビジョン機能を備えているため、画像の説明にはビジョン対応のモデルが必要です。すべてのモデルがビジョン機能を備えているわけではありません。主にLlavaやいくつかの実験的なLlama3モデルなどです。その他にもいくつかありますが、これらが主な選択肢です。