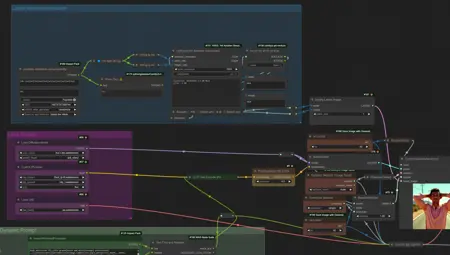

Flux Regularization images and txt captions generator with Dynamic and Wildcard - ComfyUI

세부 정보

파일 다운로드 (1)

이 버전에 대해

모델 설명

This will create random diversified realistic images of people (man and woman, all ages) with clothes with a focus on upper body and shirt. You can change the dynamic prompt the way you want.

It will create a random text and a random number on the shirt on 50% of images to try to preserve Flux text capabilities.

It will also create random aspect ratios. I don't know if it is desirable, but training in only 1x1 looks like a bad idea to me when we have buckets on all trainers. It will create 10 times more 1x1 than other ratios.

I'll also upload my wildcard folder to be used with my dynamic prompt.

I have a folder with 180 images already generated with this workflow. If anyone wants it, please contact me. I won't upload it because it has images of clothed minors, and it's against Civitai rules. I'll probably do more, but so far this is what I have.

Use the forever queue of ComfyUI

To use this, remember all the updating and installing of missing nodes. etc etc.

It was based on and expended on @TheGreatOne321 workflow: https://civitai.com/models/646449/regularization-image-workflow-and-collection-for-flux

The dynamic prompt right now is this. I'm constantly changing it:

High definition {8::color-graded|black and white|vintage} professional __collections/devilkkw/composition/image_composition_angle_perspective_depth__ photo, __collections/devilkkw/composition/image_composition_framing_body__ view of a {0.5::plumpy|0.5::muscular|0.5::skinny|0.2::fat|} __yetanotherwildcardcollection-main/states/age__ {0.05::Prince Harry|0.05::Bill Gates|0.1::Elon Musk|__collections/jumbo/people/nationalities/*__} {man|woman} wearing a {long sleeves|tank top|button|vneck|high crewneck} {light|dark}-__YetAnotherWildcardCollection-main/Colors/Basic__ shirt. {sitting on the floor|running|lying resting on the ground}, {arms are fully extended {to the sides|in front of the body|up}|the arms are on the hips|the arms are pointing to {0.2::the mouth|0.2::the nose|the camera|to the ground}|the arms are behind the head}{|, {printed|scribbled|painted|draw} on the shirt is in {light|dark}-__YetAnotherWildcardCollection-main/Colors/Basic__ the words "{__collections/artists/*__|__common_animals__|__collections/nsp/nsp/fruit__}" and the number "xxx" in style}. The background is a __yetanotherwildcardcollection-main/background/*__I'm finally experimenting with regularization images. Why? I'm going to my 4th training of the Flux "armpit sweat stain shirt" and I'm not getting good enough results. It's good, but not enough. So I'm finally trying this.

Regularization images is a very convoluted, confusing topic for me.

I still don't think most LoRas, specially the ones trained with 10-20 good quality images, need this. But I always do at least 60 images in my dataset because I want flexibility and to actually train all the aspects of the concept.

So My idea here is that is will help the model preserve the inherit merits and demerits it has (camera position, image quality, body anatomy, and all the bias it already has) so the LoRa can actually affect what I want.

I see no reason to use regularization simply as a dampening method. So training on the same captions as your dataset makes no sense to me. It makes sense to make the model understand that a "shirt" =/= than a "shirt with sweat". That is my goal here.

I also think it's completely nonsense to use it as an anti-bleeding method. If you don't want bleeding, just unplug your LoRa. LoRas are not checkpoints.

I'll also try my Loïc Barcourt Lora with the idea to give it back the model quality. It learned too much the bad quality of the almost 200 screencaps I used and some low res images, EVEN they all being captioned as bad quality images, they still got learned as the LoRa weight. LoRas learn by repetitions, no matter what the captions is. So it was expected. That is why I think regularization can save a LoRa that is learning bad quality, jpeg artifacts, weird angle, etc.