Midnight1111 ANIMATEDIFF LITE+

詳細

ファイルをダウンロード

モデル説明

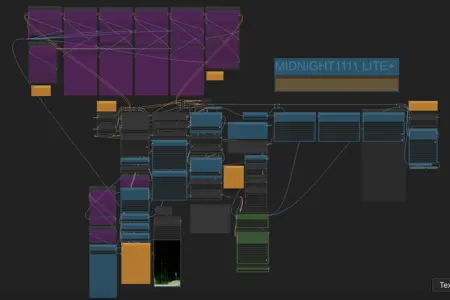

MIDNIGHT1111 ANIMATEDIFF LITE+ ワークフロー

ComfyUI ワークフロー // v01.09.25

MIDNIGHT1111 LITE+ は、Stable Diffusion 1.5 を使用して動画を生成するために最適化されたカスタム ComfyUI ワークフローです。ControlNet、潜在空間入力の切り替え、専用の LoRA スタックなどの高度な技術を組み合わせ、バッチ処理や解像度スケーリングの柔軟な制御を提供します。

ステップ 1: 初期コンポーネントの読み込み

ビデオアップローダーノード:

スイッチャーノードの番号を選択した場合でも使用されない可能性があるため、開始するためにビデオアップローダーノードに動画をアップロードしてください。右側のビデオアップローダーはリファレンス用、左側のビデオアップローダーは CNet が ControlNet 機能を抽出するために使用します。チェックポイントローダー:

CheckpointLoaderSimple ノードを使用して、目的の Stable Diffusion モデルを読み込みます。

正しい VAE と CLIP モデルが選択されていることを確認してください。

LoRA スタックの設定:

CR LoRA Stack ノードを使用して、スタイル制御用に特定の重みで複数の LoRA を読み込みます。

LoRA のブレンド比率を、目的のビジュアル効果に合わせて調整してください。

ステップ 2: モーションとコンテキストオプション

モーション LoRA ローダー:

- ADE_AnimateDiffLoRALoader ノードを使用して、モーション LoRA を読み込みます。

コンテキストオプション:

- ADE_LoopedUniformContextOptions ノードを設定して、アニメーション中の均一なループ処理を制御します。

ステップ 3: ControlNet モデルの適用(オプション)

ビデオ入力時に使用する ControlNet ローダー:

以下のノードを使用して、さまざまな ControlNet モデルを読み込み適用します:

CNet Pose: ControlNetLoaderAdvanced

CNet Depth: ControlNetLoaderAdvanced

CNet Edge: ControlNetLoaderAdvanced

CNet Canny: ControlNetLoaderAdvanced

ステップ 4: 初期フレームの生成

サンプラーの設定:

- SamplerCustom ノードを使用して、希望するサンプリング手法(例:DPM++ 2M SDE)でフレームを生成します。

シグマとシードジェネレーター:

AlignYourStepsScheduler ノードを設定してシグマを調整します。

Seed Generator ノードを使用して、シードをランダム化するか、一貫した結果を得るために特定のシードを設定します。

ステップ 5: アップスケーリングの適用

潜在空間とピクセルアップスケーリング:

NNLatentUpscale ノードを使用して、潜在空間でのアップスケーリングを実行します。

PixelKSampleUpscalerProvider ノードを使用して、ピクセルレベルのアップスケーリングを適用します。

ステップ 6: 出力の最終化と保存

ビデオの結合:

VHS_VideoCombine ノードを使用してフレームを動画に結合します。

必要に応じてフレームレートとエンコーディングオプションを調整してください。