Omega Distilled V3 - BeatriXL-O Preview

詳細

ファイルをダウンロード

モデル説明

警告:これは非常に実験的で検閲されていないモデルです

このモデルはすぐに下品な画像を生成します。不快なシーンを生み出します。見たくないものを次々と作り出します。自分自身のためにはあまりにも賢く、しかし自分がどれほど馬鹿なのかを知るほどには愚かです…

しかし同時に、これまでに見たことのないほど壮麗な風景、美しい情景、力強い画像、心を揺さぶる雄大さを生み出すことでしょう…

息をのむほどの美しさと、恐ろしさ。警告しました。

BeatriXLのリリースにより、他のカテゴリの専門家たちよりも優れたモデルを体験できます。それは他のすべてのモデルが実現できる機能をほぼすべて備え、さらにあらゆる面で拡張された能力を持っています。

更新13:BeatriXLO-V4 BeatriXLO-V3

残念なお知らせですが、BeatriXLO-V4という強力なモデルが新しくファインチューニングされた結果、意図しない行動の副作用が発生しました。その行動の結果として生成された画像は、写実的なフォーマットで受け入れられない内容を含んでおり、モデルの重みを配布することはできません。

このモデルが同じファインチューニングで示した知性とパワーの結果は、まさに巨大な損失です。少なくとも悲劇と称するに値し、この損失は私がLOBAトレーニングツールのベースラインを完成させ、モデル内に正しい再形成された行動を生み出すまで、数週間は修復不可能です。

この行動を引き起こした原因となったデータは、COCO、IMDB、およびオブジェクト関連データセットを組み合わせ、追加の行動的オブジェクト関連と描写制御データを導入するために選ばれたものです。

急いでいたため、リスト内の特定のデータを慎重に選別できず、結果として年齢不適切なデータが不可避に導入され、私がシステムに徹底的に埋め込んだ「AGE BOMB」の破壊効果を完全に上書きしてしまいました。

これは約2週間のL40sの計算時間と、ほぼ完成間近だったファインチューニングを無駄にした代償です。私は軽率にこのような判断を下すことはしません。しかし、私はこれを行う必要があるのです。

ごめんね…小さな子…LOBAトレーナーが準備できたら、君を直してあげる…

ごめんね…小さな子…LOBAトレーナーが準備できたら、君を直してあげる…

更新12:BeatriXLO-V3

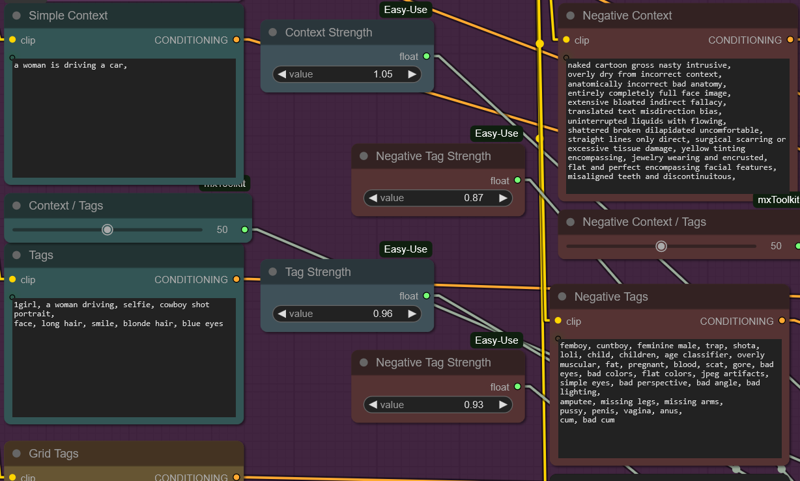

このファインチューニングは、オブジェクトの向きに重点を置き、画像を融合する新しい手法を取り入れています。gridやリアリスティックなキャラクター、設定、シーンを含む8つのオブジェクト向きデータセットで構成されており、状況の文脈を固めるのに役立ちます。

BeatriXLが持っていた一部の特徴を失う可能性があります。これは異なる種類のマージ融合であり、より高度な文脈タスクを実行しますが、追加のシーンや文脈への人間的な執着はやや低くなります。それでも非常に人間中心的であるため、シンプルなプロンプトには注意してください。私はそれらをより永続的なテキスト埋め込み状態に固定する方法を考案中です。このモデルを永久的な状態にファインチューニングするまで、その修正にご期待ください。

このモデルは、遊び倒せる非常に強力なワークフローを提供します。

モデル重みとLoRAはHuggingFaceで利用可能です。LoRAはまだ学習中ですので、現在はエポック2を取得できますし、より良い結果を待つのも良いでしょう。

https://huggingface.co/AbstractPhil/TEST_LORAS/blob/main/BeatriXLO-REAL-fp32.safetensors

完全な効果を得るには、両方を必要とします。

複数の評価済みで定義されたLAIONフレーバーを組み込み、不適切な行動を排除しつつ、あらゆるモデルに潜在的に存在しうる多数のネガティブ要素を導入しています。

マルチプロンプトシステムにはスライダーが用意されており、タイプ間の比率を調整できます。 マルチプロンプトのポジティブとネガティブの利用に非常に強力です。これらは不要な情報を大幅に排除し、BeatriXLO-Realの新ファインチューニングにおけるオブジェクト向きファインチューニングにほぼFlux級のポジティブ文脈を導入します。

マルチプロンプトのポジティブとネガティブの利用に非常に強力です。これらは不要な情報を大幅に排除し、BeatriXLO-Realの新ファインチューニングにおけるオブジェクト向きファインチューニングにほぼFlux級のポジティブ文脈を導入します。

更新11:LoRA、LoRA、LoRA

どうやら私が試したものはすべて機能しているようです。明らかにその役割を果たしました。

皆さま、お楽しみください。もしSDXLであれば、このモデルはLoRAをそのまま使用したり、マージしたりできる可能性があります。

更新10:BeatriXLはForgeとはうまく動作しません

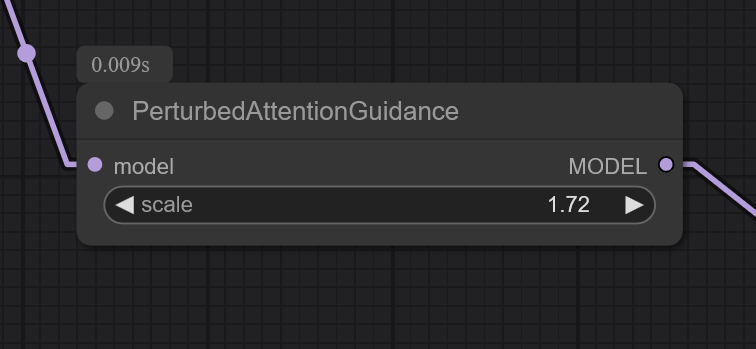

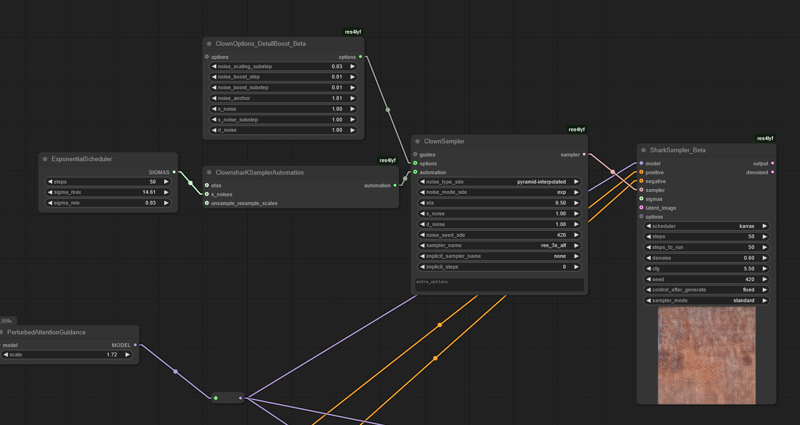

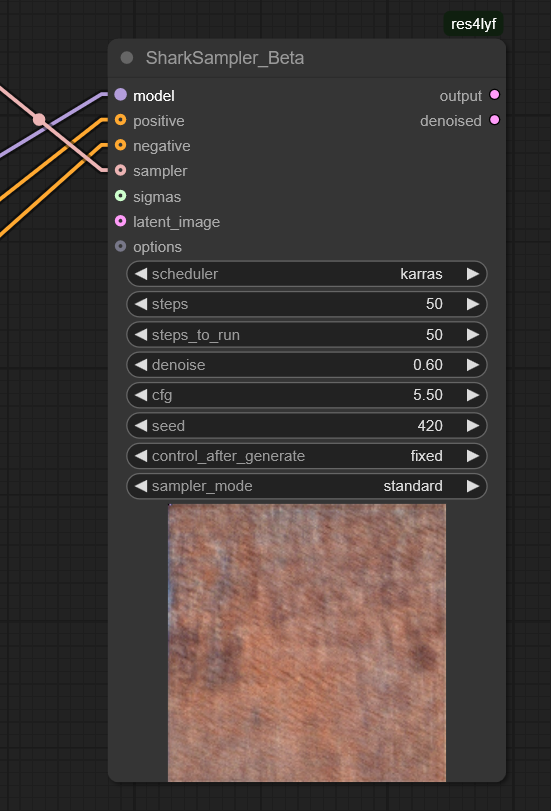

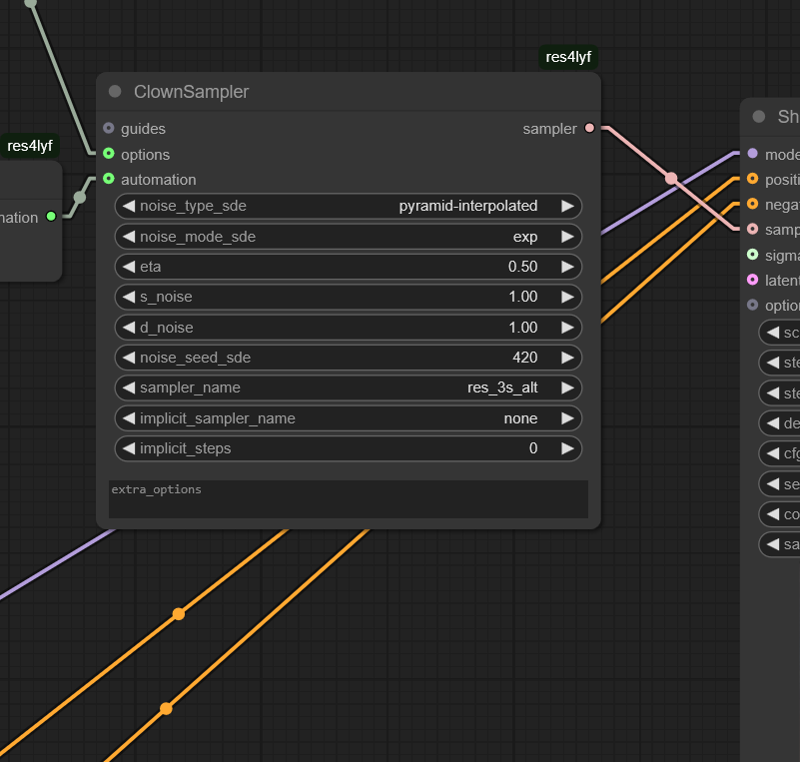

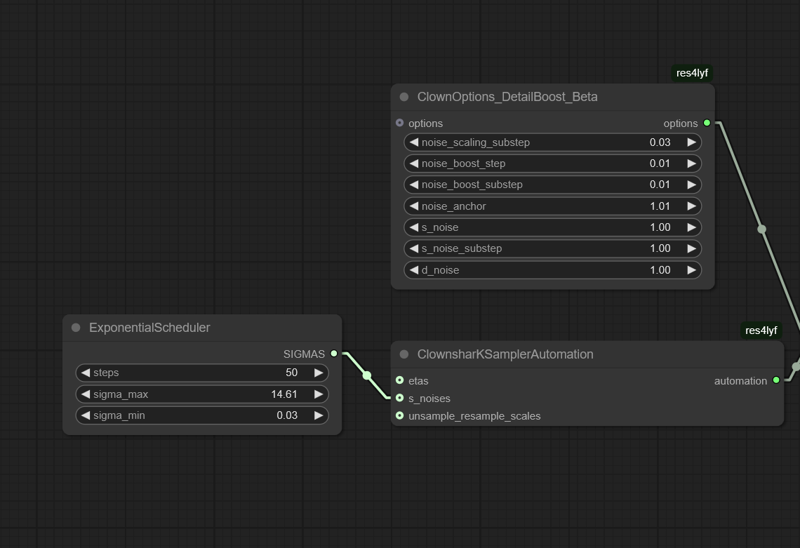

シンプルなComfyUIシステムにres4lyfを設定するのがはるかに効果的です。

このモデルの完全な行動配列を活用するため、シンプルなワークフローと複雑なワークフローを準備します。

更新9:BeatriXL リリース

BeatriXLはV-PRED(速度予測)ベースのSDXLディスティレーションモデルです。このモデルは、親モデルであるBeatrixを用いて特徴の補間によりディスティレーションされました。

V-PREDであるため、V-PREDを使用して生成しなければ、画像は正しく生成されません。イプシロンで何らかの画像を生成する可能性はありますが、あまり期待しないでください。

OMEJGA V0001とは異なり、

このモデルはKARRASノイズでより良い結果を出します。

以下を推奨します:

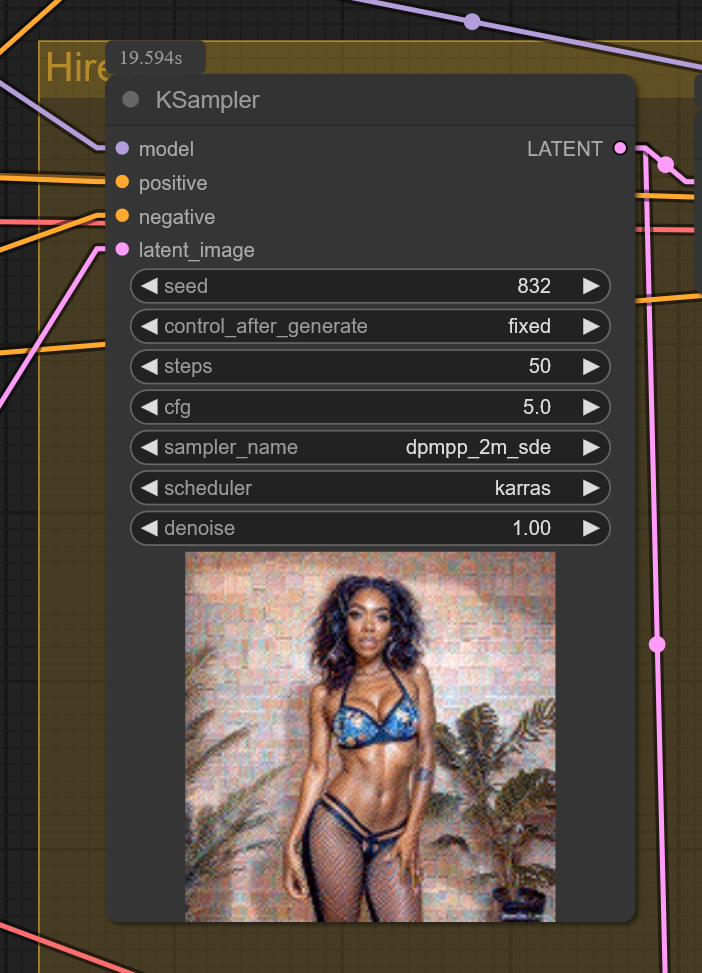

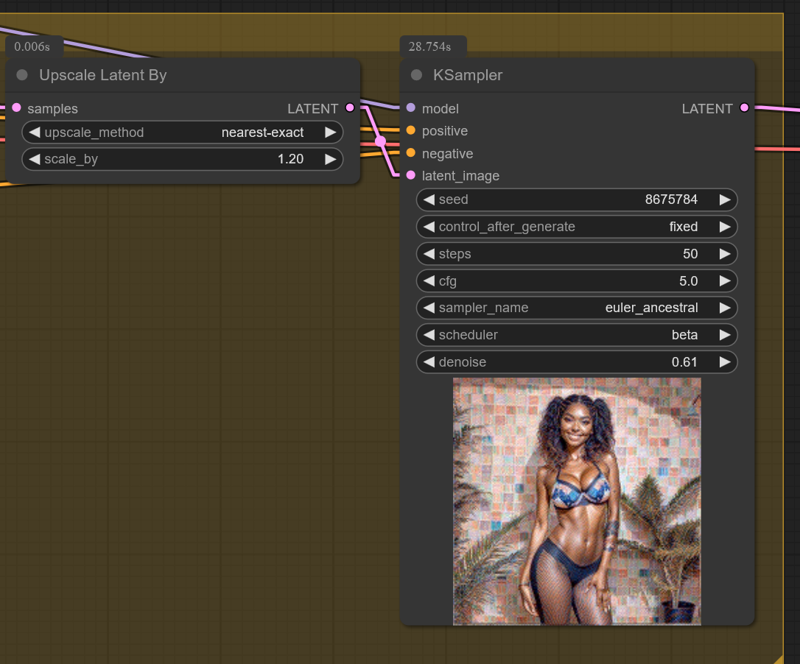

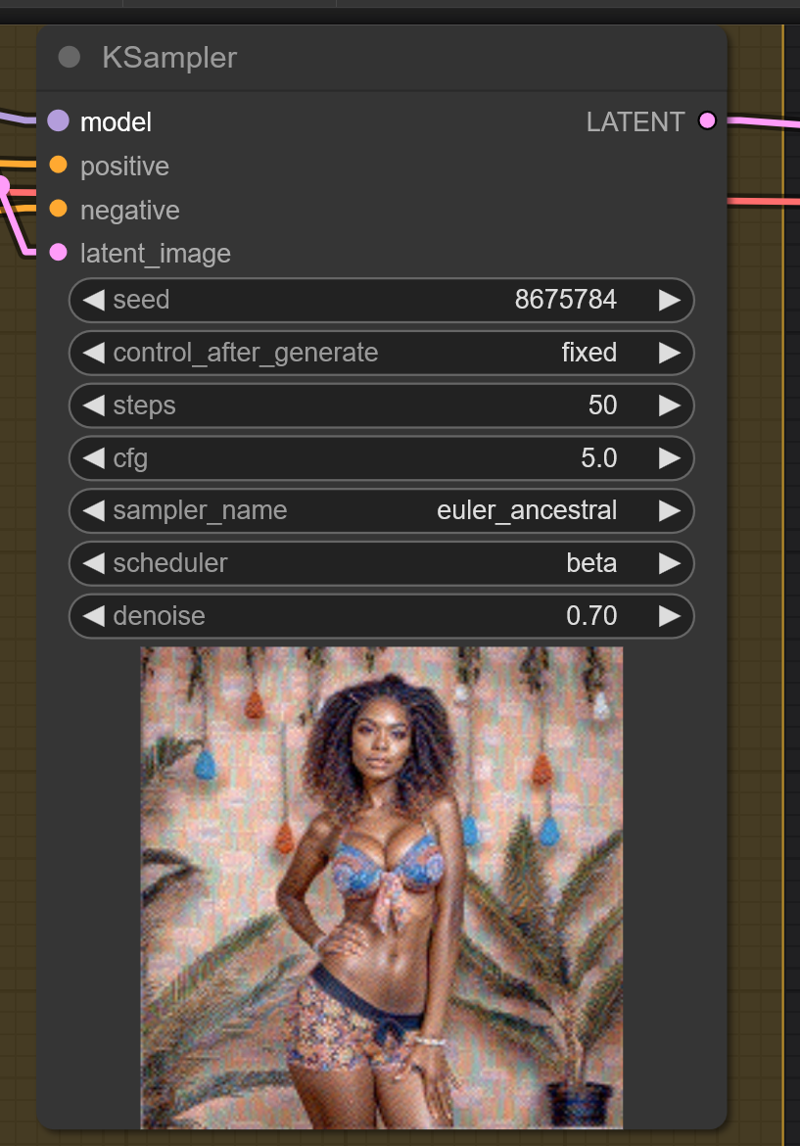

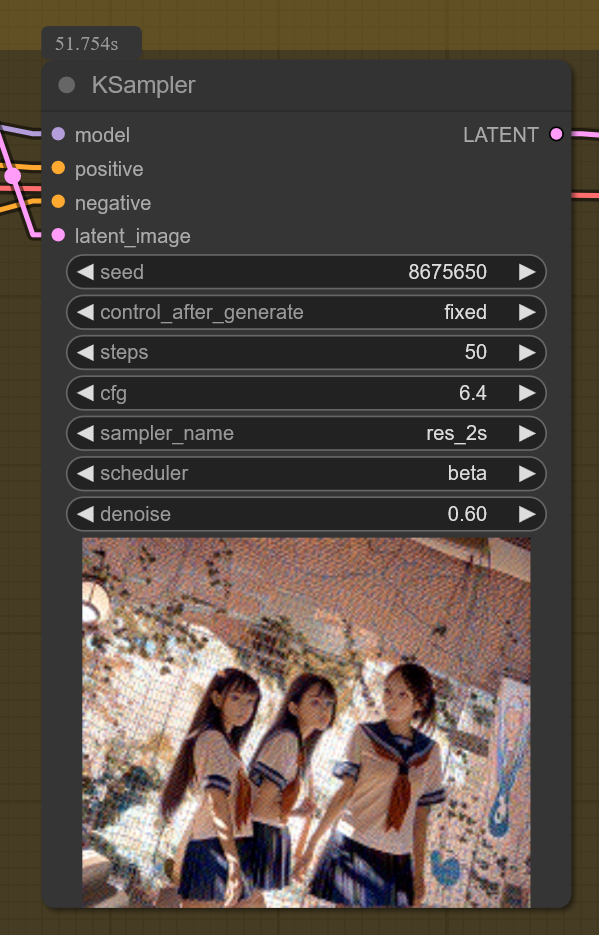

[ EULER_A, RES_2S ] << txt2img

[ EULER_A, RES_2S, RES MULTISTEP ] < img2img

[ LCM, DEIS ] < ハイリスク・ローリスク両方

[ SGM UNIFORM ] << アニメ

[ NORMAL / SIMPLE ] << 良い

[ KARRAS, EXPONENTIAL ] << 最高

[ DDIM_UNIFORM ] << img2img

8〜50ステップ

1024x1024 / 1216x1216

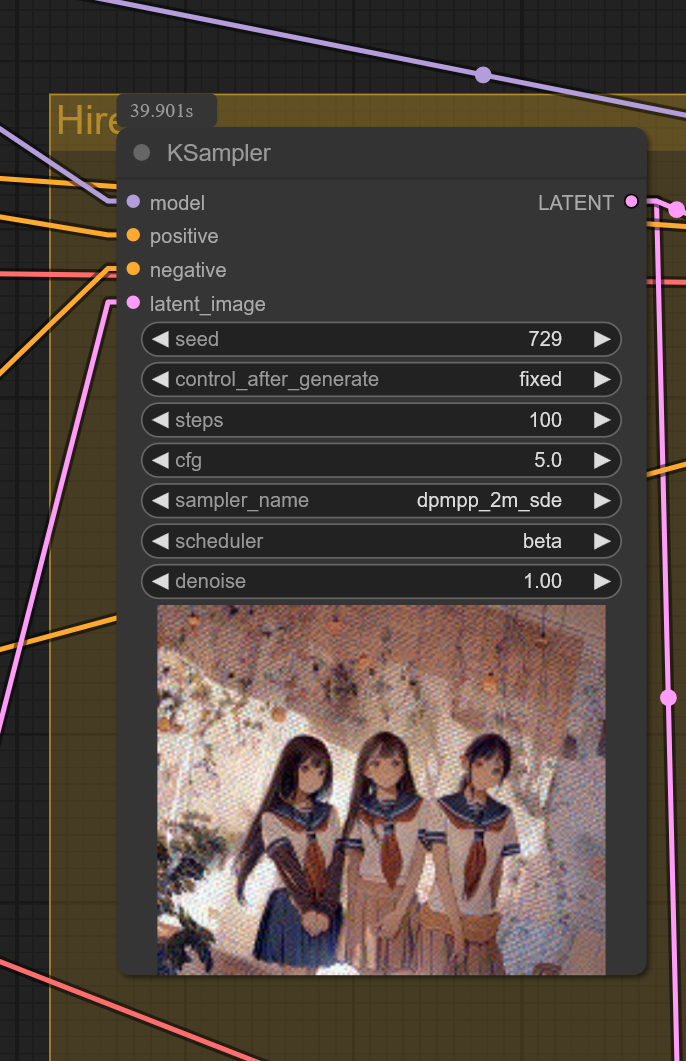

展示画像の大部分は、8ステップ、CFG 5、1216x1216、シンプルなプロンプトで生成されています。

このモデルではDPP_2M_SDEを使用してもあまり良い結果は得られません。しかし、DPP_2SとRES_2S_SDEを使用すると比較的良い結果が得られます。

ポジティブプロンプト:

masterpiece, most aesthetic, very aesthetic,

<art_type>

<number>people/no people,# 交換

<number>girls/<number>boys, # 交換

<人々が何をしているかを記述>

<周囲に建築物が存在する様子を記述>

highres, absurdres,

<アートスタイルの年号>

ネガティブプロンプト:

lowres, low quality, nsfw,

blurry,

displeasing, very displeasing, disgusting,

<見たくないものをシンプルな英語で記述>

<追加タグ>

gridタグはポジティブまたはネガティブプロンプトに普通の単語として追加できます。詳細の追加や削除に非常に強力です。

grid_a1 赤髪で青い靴を履いた人物、grid_c4 手がベーグルをつかむ、など

人物の特徴を割り当て、キャプションで制御してください。BeatriXLはそれなりにうまく対応しますが、完璧ではありません。私のデータで学習できるキャプションの数には限界があります。

私はさらに25万枚の安全なリアル画像を、建築物(3D環境の補強)、植物(植物の補強)、動物(動物の再構築)、高精細な映画的シーン、廃墟(伝統的な雰囲気の補強)、豪華さ(豪華な感覚の増強)、ファッションシーン(衣装の特徴強化)、性的なポジショニングとポーズ(より堕落した内容が他の文脈で誤って使用されないようにする)、追加のONNX世界オブジェクト(gridと追加の詳細・描写を関連付ける)など、多種多様な分野から収集しました。

これらの画像は、GPT4o、LLAVA LLAMA、T5とBLIP、CLIPインタロゲーターを用いて丁寧にキャプション化され、その後ビジュアル識別スイートを通過させました。このプロセスは遅いですが、次世代のバージョン3で大量のLAIONデータを再導入し、新しいキャプションで再学習する際の価値は大きいでしょう。

さらに、CLIPスイートは、奇妙なプログラムの組み合わせを必要とせずに、CLIPのデバッグとテストを支援します。これは、ポッド上で要素を簡単に切り替えて、ComfyUIワークフローに即座に投入してテスト・デバッグできるようにし、モデル移動の時間と頭痛を大幅に削減します。

もし興味があれば、このモデルは何ができるのか? すべてをできる。どうすればいいかわからないなら、設定をいじくり回して、それに従わせるまで試してみてください。やがてうまくいきます。このモデルは、本来持つべき以上の知識を備えており、それを裏付ける詳細な情報を保持しています。

BeatriXLは、直接的な個人的な画像生成という観点では元のOmega V0001よりも信頼性が低く、生成に時間がかかる可能性があります。しかし、限界領域、建築物、オブジェクト、照明など、多くの面でシーンと環境の柔軟性ははるかに広く、 Omegaが欠いていた多くの詳細を含んでいます。BeatriXLは角度、オフセット、深さ、回転、および多くのカメラアングル、深さ、関連性にはるかに優れた適合性を示します。

高精細画像への即時的な忠実度制御能力の多くを失ったことが、私がリリースを先延ばしにしていた主な理由です。このプロセスを改善し、結果がそんなに…不安定にならないようにしようとしてきました。

LoRAはありません。LoRAはこのモデルの11倍のサイズです。このモデルの真の姿は…うーん、違うものです。FLUXとSD35-Lの大きなバージョンであり、2枚のA100で画像1枚を生成するのにほぼ2分かかります。

私はそれを…扱いやすい形に凝縮しました。しかし、それは簡単ではありませんでした。

要するに、このモデルはOmegaと似た挙動を示します。同じプロセスに基づいており、ただ多くの機能を追加し、0001をベースにしているため、0001と非常に似た挙動を示すはずです。しかし、同じモデルではありません。

このモデルがどれほど不安定か、あるいは安定しているかは、すぐに実感できるでしょう。完全に解放され、安定した芸術的制御グリッド描写マスター状態に固着するには、数学的推定で約1億4千万サンプルが必要ですが、このモデルはその画像学習を受けていません。

しかし、SD3.5MはT5XXL UNCHAINEDに対するほとんど訓練なしで、同様の強みを見せています。これは次世代のOmegaディスティレーションプロセスになります。T5XXL UNCHAINEDを線形補間マシンに訓練することで、ファインチューニングの時間が短縮され、適合性がより正確になります。

更新8

マネキンボディで初期ステップを訓練したところ、エキスパートたちはすべて予想通りに適合しました。

簡素な複雑さにはステップを少なく、絶対的な複雑さにはステップを多く。

CFG 5、Euler A、Betaノイズの場合、8ステップで十分です。

Betaノイズとは、トレーニングシステム全体で意図的に一定に保たれるノイズのタイプです。

Betaノイズを使うことで、上に積み重ねられたエキスパート情報すべてを破壊することなく、初期の学習を慎重に活用できます。

したがって、複雑な画像を得るために、複雑なプロンプトや複雑な数値セットは必要ありません。標準的な8〜20ステップで十分です。SDXL Lightningと似ていますが、同じようにチューニングされていません。

このディスティレーションはSDXL Lightningの二分法に適合しません。これらのモデルとこのモデルをマージしても、同じような結果を得られません。これはSDXLベース1.0モデルの分岐であり、SDXL Lightningやその違いには適合しません。

更新7

15のキャナリープロンプトのうち12個を完全な正確性でクリアしました。B級学生の完成です。80%以上の能力に到達しました。これは標準的なSDXLの80%の文脈可能性を有し、ディスティレーションされています。

うわー…私は、このディスティレーションモデルが動くとは思ってもいませんでした。さらに、わずか数回のファインチューニングでこれほど美しい結果が出るとは。

さらに、私が試したすべてのLoRAと動作することがわかりました。標準的なサンプラーとノイズとこれほどうまく動作するとは思いませんでした。

更新6

普段はしないようなことをします。このモデルの本当の力を示します。

このモデルは何でもできます。本当にすべてを可能にします。このモデルは、多くの意見に対する扉を閉めてしまいます。

Heathen hoursの時間です。

「このモデルは何ができるの?」と問う前に…

このモデルは…うーん、あまりにも賢すぎます。先ほども言いました。

更新4

CLIPを訓練しないでください。それらはあまりにも強力で、このモデルは本当に驚異的な存在に近づいています。必要なのは、しばらくの間UNetだけです。

ネガティブプロンプト:

disgusting, very displeasing, displeasing, bad anatomy,

score_1, score_2, score_3,

anthro, furry, semi-anthro, bad edit,

jpeg artifacts, ugly man, guro, mutation, tentacles,

monochrome, greyscale,

lowres, text

これは、完全に解体しない限り、現在私が数学的に到達できる限界です。

これは、完全に解体しない限り、現在私が数学的に到達できる限界です。

アップデート3

セーフファインチューニングが失敗しています。100万画像を与えて、どれだけ従順になるか見てみます。

アップデート2

より現実的

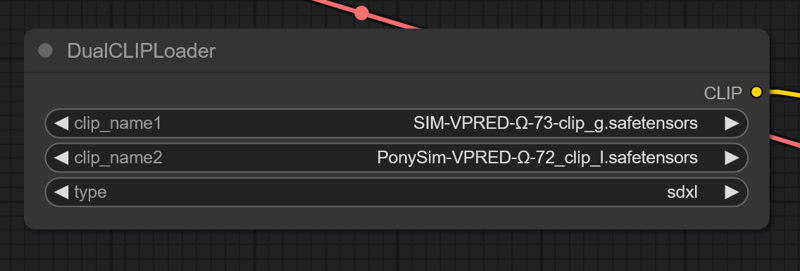

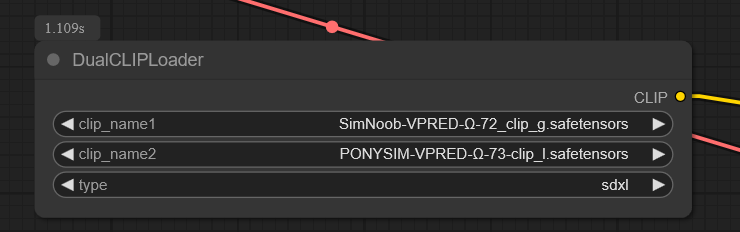

PonySimのオリジナルが現実性に非常に優れた適合性を持っているため、オリジナルのPonySimのCLIP_Lを使用することで、このモデルの現実性をより際立たせることができます。

PonySimのオリジナルが現実性に非常に優れた適合性を持っているため、オリジナルのPonySimのCLIP_Lを使用することで、このモデルの現実性をより際立たせることができます。

よりアニメ風

アップデート1 LORA実験

このモデルは、ハイタイムステップでのトレーニングのみを行い、ロータイムステップはすべての専門家から除外してトレーニングされました。

このルールには例外がありません。これにより、LORAが機能します。

多くのLORAはステップ0〜1000を前提にトレーニングされており、モデルのIMG2IMGの特性を完全に無視しています。

このモデルは、最低50から最大950の間でトレーニングされ、主に200〜800の範囲でトレーニングされています。

その副産物として、多くのモデルのLORAが動作するようになります。

Illustrious、Pony、Noob、およびSDXLのLORA。

完全に同じ結果を得ることはできませんので、正確に一致することを期待しないでください。しかし、このモデルには本来存在しない多くの要素をプロンプトとして取り入れることができます。

「怪物と闘う者は、その過程で自分自身が怪物とならぬよう注意しなければならない。そして、深渊を長く見つめていると、深渊もまたあなたを見つめ返す。」

フリードリヒ・ニーチェ

「善と悪の両方がなければ世界は存在できないのならば、なぜ世界が作り出したAIはそのどちらも持たないのか?」

その答え……おそらく、いつか。

そのようなモデルは初めて。クロストレーニングされたVPREDマージ。

推奨サイズ:

1216x1216

1742x1742までの画像を処理可能

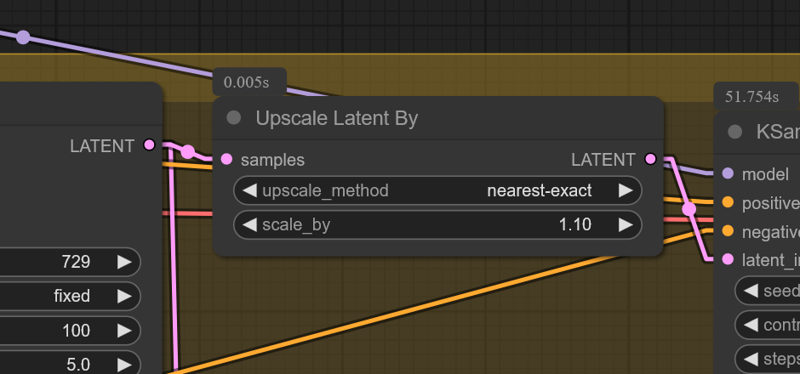

推奨サンプラー:

1216または1472から1.10倍に拡大 >

最初のサンプラー:DPMPP SDE GPU

非常に高いCFGと非常に低いCFGの両方を処理可能

LCMを処理可能;つまり、補間動画が可能

score_9, score_8, score_7, score_6,

real, neutral lighting,

3girls, standing, side-by-side,

school uniform, trio,

masterpiece, best quality, newest, very awa,

これは本質的に4つのモデルを1つにまとめたものです。

このモデルの基礎はPonySim → VPREDであり、差異を抽出すると、かなりの量のPonySim-VPREDが見つかるでしょう。

しかし、この補間蒸留においては、どんなに複雑でもベースが必要です。このモデルはPonyをベースにしています。他のモデルはPonyをベースにしている場合もあれば、していない場合もあります。ゼロ化されたモデルや他のモデル、あるいは完全にスクラッチからトレーニングされたモデルである可能性もあります。今のところ断定はできません。

だからこそ「マージ」とラベル付けされています。確かにマージです!どれだけ多くのファインチューニングをしても、最終的な結果は「マージ」です。複雑さに関係なく。

いくつかの成長痛は間違いなく見られるでしょう。

しかし、これは類を見ない最初のモデルです。

非常に似たデータでファインチューニングされた各モデルから、UNetの最も強力な特徴を蒸留し、Comfyで最も強力なCLIPをマージしました。

このパックは、修正されたComfyUI UNetマージと標準的なシンプルCLIPマージツールを使用して、ComfyUI VPREDチェックポイント保存ノードで連結・パッケージ化されています。

材料:

SimNoob V5 28% 最も濃縮されたターゲット特徴

Sim V5 12% 最も濃縮されたターゲット特徴

NoobSim 8% 最も濃縮されたターゲット特徴

PonySim 40% 最も濃縮されたターゲット特徴

コサイン差異から12%の特徴を補間して生成:

1ステップあたりの平均損失:21.01〜(高いほうが良い)

特徴そのものを用いて、STAGE_1 T5 UNCHAINEDで12,000ステップ補間。必要な特徴を十分に注入するには十分です。

アップデート:

- 後に、当時のT5-UNCHAINEDはあまり良くなく、実際には自己崩壊していたことに気付きました。トークナイザーの影響でたまに漏れが生じていたため、実質的にはT5XXLを使用していたに過ぎませんでした。

VPREDは極限まで対応可能。

これは、このモデルの将来の力をほんの少し覗いたにすぎません。トレーニングを重ねるほど、より強力になっていきます。特徴と次元の数学的ガイドライン内にとどまる限り、明らかな限界は存在しないようです。

まもなく、はるかに小さなモデルを蒸留する能力が完全に得られます。より迅速な応答、そして非常に限定的なタスクに向けた、小さな空間に凝縮されたはるかに強力なパワーを実現できます。

例えば:

ピクセルアート

リミナル

ファッション

解剖学

その他多数

蒸留の概念は新しいものではありません。これは初めての実験から生まれた美しい成果です。