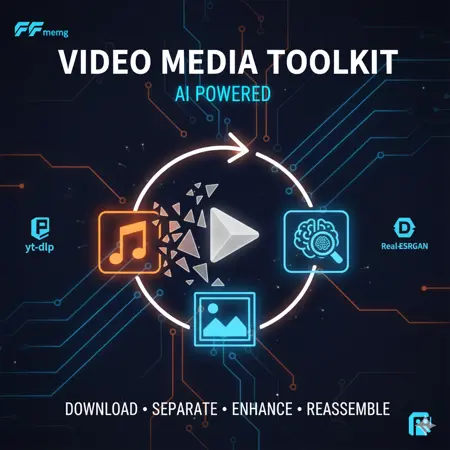

Video Media Toolkit: Streamline Downloads, Frame Extraction, Audio Separation & AI Upscaling for Stable Diffusion Workflows | Utility Tool v6.0

詳細

ファイルをダウンロード

このバージョンについて

モデル説明

ビデオメディアツールキット:Stable Diffusionワークフロー向けのダウンロード、フレーム抽出、オーディオ分離、AIアップスケールを効率化 | ユーティリティツール v6.0

概要

Video Media Toolkit v6は、Stable Diffusionのアーティスト、トレーナー、動画から画像を作成する愛好家向けに設計された無料のオープンソースデスクトップツールです。このワンストップWindowsアプリは、メディアの取り込み、分解、強化、再構築を一括処理します。YouTubeやRedditの動画からLoRAトレーニング用の高品質フレームを抽出したり、オーディオ反応型生成のためにボーカルや楽器を分離したり、低解像度のアセットをComfyUIやAutomatic1111ワークフローに投入するためにアップスケールするのに最適です。

FluxやStable Diffusionのファインチューニング用データセットを準備したり、AnimateDiff拡張機能用の動的動画入力を構築したりする際に、yt-dlp、FFmpeg、Demucs、Real-ESRGANをバックエンドに使い、面倒なタスクを自動化することで数時間の作業を削減できます。NVIDIA環境ではGPUアクセラレーションに対応し、高速処理が可能です。

主なメリット:

- バッチダウンロードとキュー管理:URLまたはローカルファイルから動画やオーディオを取得し、MP4/MP3形式、またはフレームシーケンス(JPG/PNG)として出力。データセット準備に即対応。

- AI駆動の分解:クリーンなオーディオステム(ボーカル、ドラムなど)やトレーニング用フレームを抽出。NSFW/SFWコンテンツのキュレーションに最適。

- 強化と再構築:ノイズ除去、シャープネス向上、2〜4倍のアップスケール、安定化処理を行い、洗練された動画出力を生成。

- ワークフロー統合:A1111、ComfyUI、Kohya_ss、Hugging Faceデータセットと互換性。手動のFFmpegスクリプトは不要!

Windows 10/11でテスト済み。Python 3.8+が必要。インストールサイズは約500MB(CUDA対応torchを含む)。

機能

ダウンロードタブ:メディアの取得と抽出

- 入力:YouTube、Redditメディア、直接リンクなどURL、またはローカルファイル。

- 出力:MP4(強化動画)、MP3(オーディオ)、またはフレームフォルダ(例:frame_0001.png、SDトレーニング用)。

- 強化オプション:解像度(360p〜8K)、CRF品質、FPS制御、シャープネス・カラーコレクション・ディインターレース・ノイズ除去。

- オーディオオプション:ノイズリダクション、ボリューム正規化—クリーンなステム作成に最適。

- キュー管理:複数のジョブを追加、順次処理、入力ファイル自動削除、カスタムyt-dlp/FFmpeg引数対応。

- プロのヒント:5分の動画から1000フレーム以上を数秒で抽出。Redditのラッパーを自動処理。

再構築タブ:フレームから動画を再構築

- 入力:フレームフォルダ(ダウンロードタブまたは外部編集結果)。

- オプション:FPS設定、オーディオ結合、minterpolate(モーションスムーズ)、tmix(フレームブレンド)、deshake(振動補正)、deflicker(ちらつき除去)。

- 出力:カスタムFFmpegフィルターを適用したMP4動画—AnimateDiffや動画LoRA向けに安定化クリップをエクスポート。

- 使用例:フレームをアップスケール → 4Kトレーニング動画として再構築。

オーディオタブ:Demucs搭載ステム分離

- 入力:ダウンロードしたMP3/WAV/FLAC。

- モデル:htdemucs、mdx_extraなど(GPU/CPUモード対応)。

- 出力:ボーカル、ベース、ドラムなど分離トラックをサブフォルダに保存—オーディオ条件付きSDプロンプトに直接利用可能。

- モード:フル6ステムまたは2ステム(ボーカル+インストルメンタル)—迅速なリミックス向け。

アップスケールタブ:Real-ESRGANによるフレーム強化

- 入力:画像フォルダ(例:抽出されたフレーム)。

- スケール:2x/3x/4x—SD対応高解像度アセットへ。

- 出力:バッチアップスケール済みフォルダ—低解像度動画を4Kに強化し、モデルトレーニング品質を向上。

- GPU加速:Torchベースで実装、CPUにフォールバック。

追加ツール

- 出力ルートフォルダの永続的選択。

- リアルタイムログ + ファイルエクスポート(logs/ディレクトリ)。

- 依存関係テスト(FFmpeg、yt-dlp、Demucs)。

- 長時間作業に最適な高コントラストダークUI。

インストールとセットアップ

ダウンロード:GitHubリポジトリ からZIPを取得(またはここに添付)。

インストーラー実行:video_media_installer.batをダブルクリック—PySide6、torch(検出された場合CUDA対応)、Demucs、Real-ESRGANなどを自動インストール。pipアップグレードも処理。

- 手動修正:FFmpeg/yt-dlpの[WARNING]が出た場合、ffmpeg.org や yt-dlp GitHub からダウンロードし、PATHに追加またはハードコードされたパスに配置。

モデルの配置:アップスケール用にRealESRGAN_x4plus.pthを/models/ディレクトリに配置(READMEにリンクあり)。

起動:launch_video_toolkit_v6.batをダブルクリック。初回実行時に出力フォルダを設定。

テスト:「依存関係テスト」ボタンを使用—すべての項目が[OK]になることを確認。

互換性ノート:

- Windows専用:簡単なセットアップのためbatランチャーを採用。Linux/macOSは手動でPython実行。

- SD統合:フレームは番号付きシーケンス(例:%04d.png)でエクスポートし、KohyaやDreamBoothに直接インポート可能。

- A1111拡張機能不要:スタンドアロンアプリ。動画→画像パイプラインにはControlNetと組み合わせて使用。

- 注意事項:大容量ファイルには8GB以上のRAMが必要。DemucsにはGPU推奨(CPUでは遅い)。NSFWコンテンツはソースのポリシーに従って処理。

使用例

- LoRAトレーニング準備:アニメクリップをダウンロード → PNGフレームを抽出 → 4倍アップスケール → Kohya_ssデータセットで使用。

- オーディオ反応型アート:楽曲のボーカルを分離 → 「ボーカル波形」プロンプトでSD画像を生成。

- 動画データセット作成:YouTube動画50本を一括ダウンロード → フレーム+ステムを抽出 → 動作データでFluxをトレーニング。

チェンジログ(v6の主な更新)

- Reddit URLパーサーの強化。

- キュー管理とカスタム引数の改善。

- 読みやすさ向上のダークテーマ。

- DemucsのGPU検出バグ修正。