AccretionDiscXL

详情

下载文件

关于此版本

模型描述

吸积盘 /əˈkrēSHən disk/

- (名词)在引力作用下,围绕大质量天体(如黑洞)形成的旋转物质盘,由吸积过程产生。

简介

这是一个有点“怪异”的模型。说实话,我觉得MIX-GEM-QromEW(在推荐模型标签页查看MyMix-J/GEM,或在Yodayo或Tensor.art上查看我的个人主页)在构图感方面更出色,黑色的处理和色彩对比也更好。不过,这个模型在表现绘画风格方面优于QromEW,比例控制也稍好一些,自有其优点。也许我的失望只是因为我设定了过高的标准?谁知道呢?

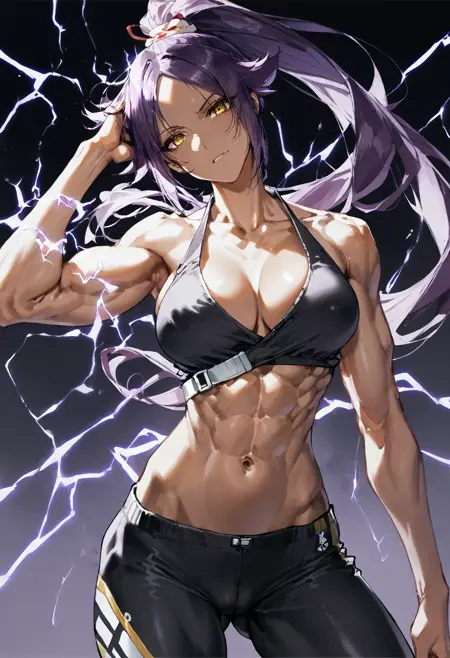

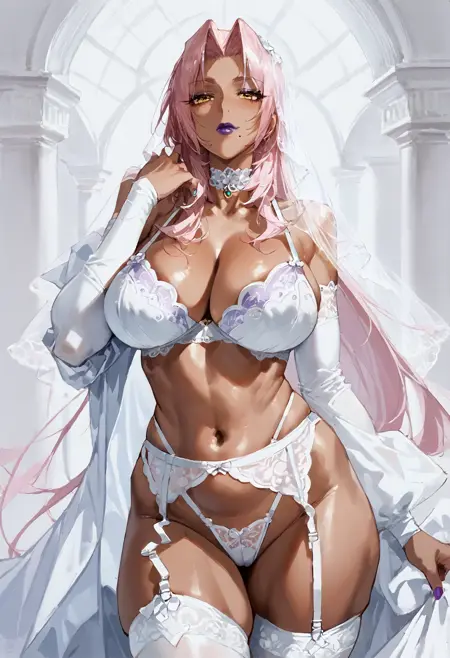

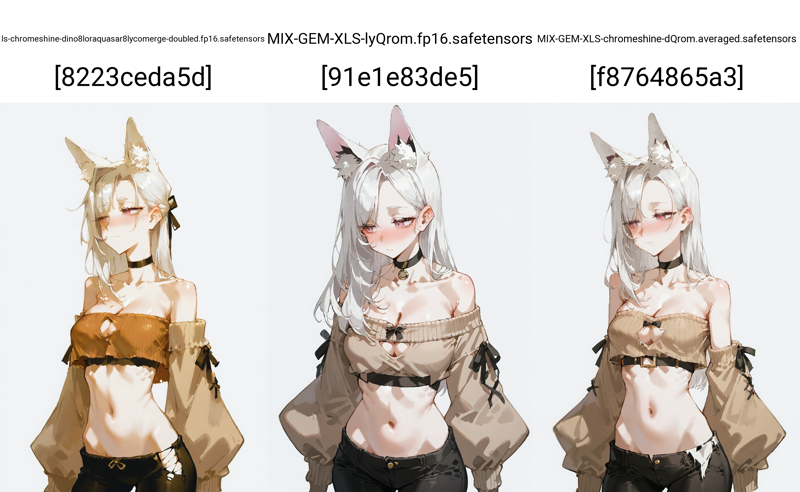

无论如何,这个模型是通过两个不同模型各50%混合而成的:MIX-GEM-lyQrom(本质上是QromEW的轻微调整版)和另一个暂命名为ls-chromeshine-dino8loraquasar8lycomerge-doubled的模型。我之后可能会上传lyQrom模型,因为它可用,但ls-chromeshine-dino8loraquasar8lycomerge-doubled则较难处理。前者是在LS Equos V1基础上进行的简单LoRA+LyCORIS合并,后者是在训练过的LS Equos基础上进行的LoRA+LyCORIS合并。ls-chromeshine-dino8loraquasar8lycomerge-doubled的一些输出效果确实更好,但整体上过于不稳定,因此才合并了lyQrom来平衡高低表现,使最终模型更实用。以下展示的图片是ls-chromeshine-dino8loraquasar8lycomerge-doubled的最佳输出,用于说明与lyQrom合并后的效果。我必须提前说明,这些图片并不能代表平均水平,否则我直接上传ls-chromeshine-dino8loraquasar8lycomerge-doubled就行了。

如你所见,合并成功将部分风格效果保留到了更稳定的lyQrom中。此外,ls-chromeshine-dino8loraquasar8lycomerge-doubled存在的其他缺陷,如色调过于偏棕、头发过于“尖刺”(暂无更贴切词汇),也在合并后得到了修正。不过,风格保留仍不够稳定——如果将来我重新审视这个模型,目标将是创建一个版本,在保留ls-chromeshine-dino8loraquasar8lycomerge-doubled独特特质的同时,借鉴QromEW的构图优势,或许可通过分块合并实现。

提示词使用

这是一个基于标签的模型,因此请优先使用标签,仅在必要时辅以自然语言。如果你不熟悉该模型响应的标签类型,大多数动漫风格模型的训练数据通常来自Danbooru或e621。这两个网站都有详尽的标签维基,可作为参考。

无论如何,请勿在提示中使用主观性术语。我经常观察到,像best quality、high quality、very aesthetic,或score_9、score_8、score_7_up这类标签,AI本身并不理解其含义,它们只是被训练注入模型的限定词(通常是基于用户评分指标,因为人类无法逐个评估数百万幅作品的质量)。AI的黄金法则是:它只懂得你喂给它的东西。(这也意味着像beautiful woman或perfect face这类标签若未在训练时被使用,也不会产生效果——鉴于来源和自动打标器的限制,这种情况极不可能发生。)

至于负面提示词,由你决定。最佳做法是,对同一种子多次修改提示词并逐步调整负面词,但若你没有无限的时间,以下是一些有用的负面标签:low quality、extra digits、artistic error、watermark、artist name、signature。e621_p_low是一个内置的通用负面质量标签,其标记数少于score_6、score_5、score_4。如果你不信任它,也可以选择完整的质量标签链,但在我看来,它是一个更优的替代方案。预览图可作为参考,当然,你可以自由调整自己的负面提示词。

采样与其他参数

与所有扩散模型一样,负面提示词在分类器自由引导尺度(CFG)越高时影响越显著。虽然提示词决定文本编码器如何调节潜在空间,但CFG调节其强度。要详细解释提示词如何引导潜在空间需要大量文字,简而言之:无条件条件(负面提示)抑制某些向量进入潜在空间,CFG值越高,抑制作用越强(同时正向条件的作用也越强)。但过高的CFG会导致图像“烧毁”,即在去噪过程中施加过强的影响。我建议使用Perturbed Attention Guidance (PAG)来增强引导强度而不提高CFG,或使用Dynamic Thresholding CFG在早期步骤中限制CFG值。

我推荐的采样器是Euler A,搭配你最喜欢的调度器。对我而言,SGMUniform效果最好且速度最快,但其他用户更喜欢AYS采样器。我个人使用AYS时发现,它通常更贴近提示词,但也会放大模型因数据清洗不足而学到的某些不良特质,偶尔还会注入文字或水印。若你愿意尝试更小众的采样器,我发现Euler dy Negative特别干净。主观上它比Euler A“更保守”,但非常擅长生成简洁、清晰、干净的图像。

我建议步数为25-35步,我的默认值是28。坦率地说,你不应超出这个范围。对于非收敛采样器(如随机采样器和祖先采样器),增加步数会显著改变图像;而对收敛采样器而言,一旦超过35步,收益微乎其微,纯粹浪费计算资源。更好的办法是调整其他参数(比如提示词),而不是盲目认为更多步数能解决所有问题。

该模型在832x1216或768x1344分辨率下表现最佳。