LHC

详情

下载文件

模型描述

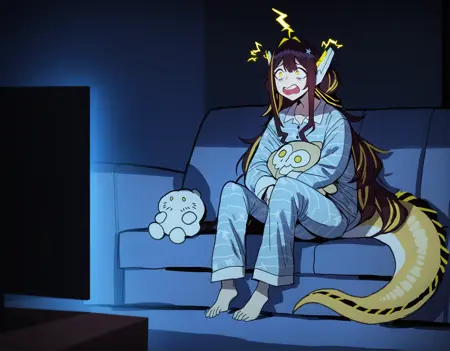

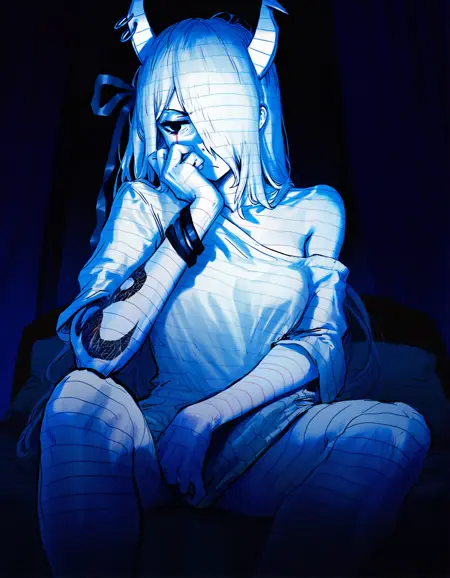

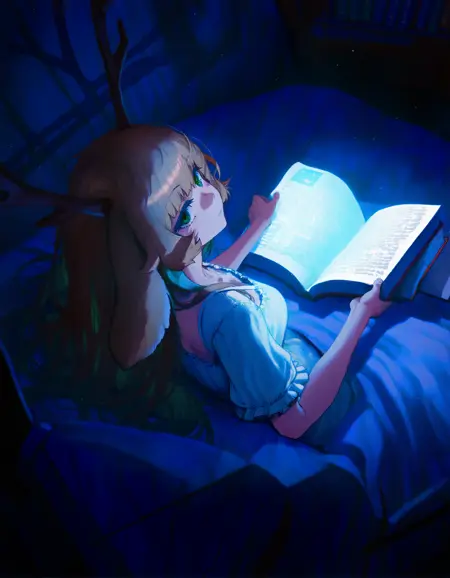

LHC(Large Heap o' Chuubas)旨在成为满足您所有虚拟主播需求的模型。此外还有一些次要目标,例如提升美学、背景和解剖结构,但主要目标是提供无需LoRA即可生成虚拟主播的选项。

Alpha V0.5

LHC v-pred v0.5 是 NoobAI v-pred 1.0 的自定义微调版本。它在提升图像质量的同时,保留了 NoobAI 几乎全部固有的艺术家知识,并大幅扩展了其对虚拟主播的认知。

并非所有虚拟主播都能以相同程度被识别,部分角色在我的测试中需要额外的标签,或根本无法良好生成。完整的角色列表及标签与使用说明,请参见:https://huggingface.co/Jyrrata/LHC_XL/blob/main/alpha_v05/vtubers_valpha05.txt。此外,已准备一个包含所有虚拟主播示例图像(含 ComfyUI 元数据)的图集:https://catbox.moe/c/pjfwt1。

数据集详情:

所有虚拟主播的图像均被单独分离,并将每人的图像数量标准化至 80 至 120 张之间,尽可能目标为 100 张。此外,还纳入了 1000 张包含多个虚拟主播的图像,用于训练多角色生成能力。最终数据集规模约为 16,000 张图像。所有图像均被放大至至少 1MP,JPEG 图像则使用专为去除网络漫画压缩伪影而设计的放大器进行了清理。

部分虚拟主播所需数据量庞大,但尚无对应标签。在此过程中,我使用了 AI 标签模型辅助标注。我原本希望手动为每张图像打标签,但数据集规模过大,目前难以手动完成。

训练详情

LHC v0.5 在数据集重大重构后,因参数不确定性,以不同学习率和批量大小训练了 102 个周期。通常,Unet 学习率介于 1.5e-5 至 5e-5 之间,文本编码器(TE)学习率介于 4e-6 至 8e-6 之间,使用余弦调度器和批量大小 8 至 32。具体的 TensorBoard 训练日志可在 Hugging Face 上获取。

训练耗时超过 400 小时,共处理超过 160 万样本。

Alpha V0.4

与此前使用 LoKR 方法的版本不同,v0.4 是 Noob V-Pred 0.6 的完整微调版本。在训练中处理了超过 34 万样本(80 个周期内含 4500 张图像),训练耗时近 90 小时,未包含多次实验。尽管如此,其对艺术家风格与概念的理解仍非常接近基模。

角色列表请见:https://huggingface.co/Jyrrata/LHC_XL/blob/main/characters/alpha04.txt。部分角色仅需角色标签,部分则需附加描述标签。

LoRA 提取文件地址:https://huggingface.co/Jyrrata/LHC_XL/blob/main/alpha/v04/lhc_04_extract.safetensors

训练详情

数据集:

使用了约 3500 张图像(含重复共计 4500 张),包括 3 位艺术家的约 350 张图像、约 500 张多角色图像,以及 100 个角色的约 2650 张图像。

重复次数设定为使每个角色每周期拥有 30 至 50 张图像。尽可能选用分辨率超过 1MP 的高质量 PNG 图像;若不可行,则使用专为去除 JPEG 压缩伪影设计的放大模型进行放大和清理。

Alpha V0.3.1

由于在训练 Alpha v0.3 期间出现一些错误,该模型与 NoobAI 的差异显著。尽管如此,它仍是一个功能强大的模型,对 79 个训练虚拟主播中的大多数有良好理解,对其他角色也能达到可用水平。概览请参见:

https://huggingface.co/Jyrrata/LHC_XL/blob/main/characters/alpha03.txt

以及 https://civitai.com/posts/9579061 了解两个 v0.3 模型对基础角色理解的视觉指南。许多角色仅需激活标签即可工作,但部分仍需额外标签。

Alpha V0.3 和 V0.3.1 均基于 NoobAI-XL V-Pred-0.6 版本训练。

LoRA 提取版本请见:https://huggingface.co/Jyrrata/LHC_XL/blob/main/alpha/v03/lhc_v03_1_lora.safetensors

如需使用 V0.3,可在此获取:https://huggingface.co/Jyrrata/LHC_XL/blob/main/alpha/v03/LHC_alphav03-vpred.safetensors

此外,Hugging Face 仓库中还包含 eps 版本,以及基于 rouwei-vpred 中间数据集训练的版本。请参考字符 .txt 文件以了解 v0.2.5 的知识概览。

Alpha V0.2

与 v0.1 基本方法相同,但数据集新增了 10 个虚拟主播,总数达 28 个。最后两个周期包含一个实验性数据集(1200 张图像),涵盖广泛概念,旨在重新校准并提升模型的美学表现。

本次新增的虚拟主播包括:

aradia ravencroft

bon \(vtuber\)

coni confetti

dizzy dokuro

dooby \(vtuber\)

haruka karibu

juniper actias

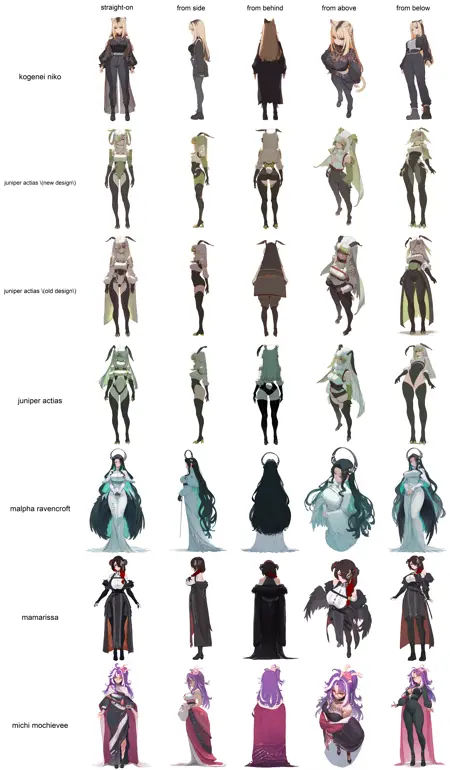

kogenei niko

malpha ravencroft

mamarissa

michi mochievee

rindo chihaya

rin penrose

atlas anarchy

dr.nova\(e\)

eimi isami

isaki riona

jaiden animations

juna unagi

kikirara vivi

mizumiya su

tsukinoki tirol

alias nono

biscotti \(vtuber\)

mono monet

rem kanashibari

yumi the witch

除新增角色外,部分旧角色的数据集也已重做,特别是 juna unagi 和 juniper actias。Juniper 还新增了两个标签:juniper actias \(new design\) 和 juniper actias \(old design\),旨在区分其两个不同设计阶段。此为实验性操作,可能不会延续至未来版本。

基础角色理解展示请见:https://civitai.com/posts/9183473?returnUrl=%2Fmodels%2F940235%2Flhc%3FmodelVersionId%3D1064798。部分虚拟主播仅靠角色标签无法正常生成,需搭配额外描述性标签。

Alpha V0.1

本模型目前仍处于 Alpha 阶段。当前状态仅作为概念验证,并不代表未来所有能力。

这是一个基础测试模型,但效果良好。基于约 1000 张图像训练,主要涵盖 18 个基模 NoobAI 识别不佳的虚拟主播。该模型基于 NoobAI XL v-pred-0.5 版本开发。

作为 v-pred 模型,本模型并非在所有 WebUI 中均可运行,仅支持已实现 vpred 采样的界面。模型所需的 state dict 已配置为让 Comfy 和 ReForge 等界面自动设置必要参数。如未自动配置,请手动开启 v-pred 采样,并建议同时启用 ztsnr。

新增/增强的虚拟主播(按训练标签列出):

Aradia Ravencroft

Malpha Ravencroft

Mamarissa

Koganei Niko

Rindo Chihaya

Mizumiya Su

Isaki Riona

Kikirara Vivi

Coni Confetti

Dizzy Dokuro

Dooby (Vtuber)

Haruka Karibu

Juna Unagi

Juniper Actias

Michi Mochievee

Rin Penrose

Jaiden Animations

此外,还特别加入了 Nerissa Ravencroft 和 Vienna(Vtuber),以及大量包含两个或多个角色的图像。

基础角色理解展示请参见:https://civitai.com/posts/9039071

推荐设置:

采样器:Euler

CFG:4-5

步数:25+

训练详情:

作为全维度 LoKr 模型训练,方法基于 KohakuXL 系列,LyCORIS 设置详见:https://huggingface.co/KBlueLeaf/Kohaku-XL-Delta/blob/main/docs/lyco_config.toml

具体参数:

数据集:1035 张图像

批量大小:2

梯度累积:4

训练步数:约 6400

训练周期:约 50

Unet 学习率:3e-5(最后 12 个周期降为 2e-5)

TE 学习率:2e-5(最后 12 个周期降为 1e-5)

优化器:AdamW 8-bit

调度器:恒定调度

特别致谢:

kblueleaf(Kohaku Blueleaf):提供 LyCORIS 库及通过 LoKr 微调的资源

OnomaAI & Laxhar Dream Lab:提供出色的基模

kohya-ss:提供 sd-scripts