The Garbage-Bin | Chaos Enhancer + Concepts LyCORIS

詳細

ファイルをダウンロード

モデル説明

なかなか良い妻がいるね。誰かが彼女をパパジョンのガーリックバターソースに浸したら、それは悲劇だ。

*例として、混乱を避けるためにInvokeAIの構文から変換した画像プロンプトを示します。完全に正確ではない場合がありますのでご注意ください。私はただInvokeを使用しています。

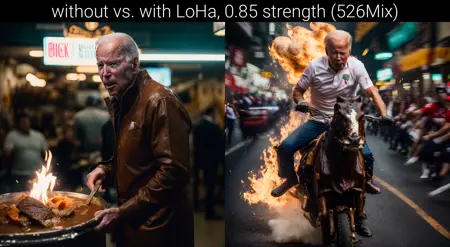

こちらはゴミ箱へようこそ。これはLoHa LyCORIS(Automatic1111では拡張機能が必要です)で、441枚の全く狂った画像のデータセットをもとに訓練され、混沌とぐしゃぐしゃなスパゲッティの悪夢の作成を支援します。必要に応じて、比較的安全にかなり高い強度(一部のモデルでは1.5)まで上げられます。主に526Mixを用いてtxt2img生成で訓練されたため、526Mixには強度を低めに、他の系統のモデルには高めに設定するのが良いでしょう。

このLoHaには2つのバージョンがあります:

もう少し強く、より創造的なバージョンで、スタイル要素やサブコンセプトをより敏感に捕捉するように訓練されていますが、特定のモデルやスタイルとは衝突しやすくなります。

もう少し弱く、単純なバージョンで、訓練はコンセプトにのみ集中しています。安全ですが、若干の調整が必要になるかもしれません。

使用法とコンセプト

パッシブ

パッシブに使用すると、このLoHaは混沌なプロンプトによって引き出される混沌さと創造性を高めるのに役立ちます。

ただし、ある程度の混沌さが元々必要です。あなたのプロンプトとモデルが100中2の混沌度の画像しか出力しない場合、それを2倍にしても依然としてスケールの底辺に留まります。私の言っていることがわかりますか?よし、いいですね。

効果はモデルやプロンプトによって大きく異なります。満足を得られる保証はできません。それはあなた自身が見つける必要があります。

一部のモデルは他のモデルに比べて常に苦戦する可能性があります。特に、特定の被写体やテーマに特化したモデルの場合です。MeinaMixや西洋アニメーションのような比較的基礎的なモデルも、MothMixや526Mixのようなモデルほど狂った結果を得られず、単に少し調整されるだけかもしれません。

コンセプト

このLoHaにはいくつかの特別に訓練されたコンセプトがあります。現在、それらは以下の通りです:

スパゲッティ。必要な重みを与えると、スパゲッティの量と質を向上させます。

ぐしゃぐしゃ。深皿のラザニアを余分なソースと共に運んでいるところを、つまずいて転ぶ。転びながらパニックになり、空のラザニアを天井の換気扇に叩きつけてしまう。

びしょ濡れ。湿った状態

悪夢。改善が必要。何かをやっているが、何なのか不明。

はい、これらがトリガーワードです。

訓練

このLoHaは、InvokeAI Discordサーバーの「ゴミ箱」チャンネルから直接取得したプロンプトと画像を用いて、441枚の画像データセットで訓練されました。データセットの少なくとも90%は526Mix-V1.4.5で生成され、その大部分は写実的なスタイルで、

訓練には課題がありました。Base Stable Diffusion 1.5やDreamShaperのような1.5ミックスを使用すると、細部レベルや照明効果が多すぎてしまい、私の努力にもかかわらずコンセプトを分離できませんでした。そのため、コンセプトのみのバージョンは526Mixを直接使用して訓練しました。もう少し強力なバージョンは、526MixをベースのStable Diffusion 1.5で25%希釈して再訓練しました。

訓練はkohya_ss GUIを用いて実施し、DAdaptAdamを使用、重み減衰は0.75としました。以下はLoHaの訓練に使用したコマンドの関連パラメータです:

accelerate launch --num_cpu_threads_per_process=2 "train_network.py" --enable_bucket --network_alpha="16" --save_model_as=safetensors --network_module=lycoris.kohya --network_args "conv_dim=1" "conv_alpha=1" "use_cp=False" "algo=loha" --network_dropout="0" --text_encoder_lr=1.0 --unet_lr=1.0 --network_dim=32 --lr_scheduler_num_cycles="4" --scale_weight_norms="1" --learning_rate="1.0" --lr_scheduler="cosine" --lr_warmup_steps="260" --train_batch_size="1" --max_train_steps="2604" --save_every_n_epochs="1" --mixed_precision="fp16" --save_precision="fp16" --caption_extension=".txt" --cache_latents --optimizer_type="DAdaptAdam" --optimizer_args weight_decay=0.75 decouple=True betas=0.9,0.99 --max_data_loader_n_workers="0" --keep_tokens="1" --bucket_reso_steps=64 --min_snr_gamma=5 --mem_eff_attn --shuffle_caption --bucket_no_upscale

私の小さなRX 6600では、バッチサイズが1を超えるとVRAMが不足したため、訓練には約54分かかりました。