Controlnet for DensePose

詳細

ファイルをダウンロード

モデル説明

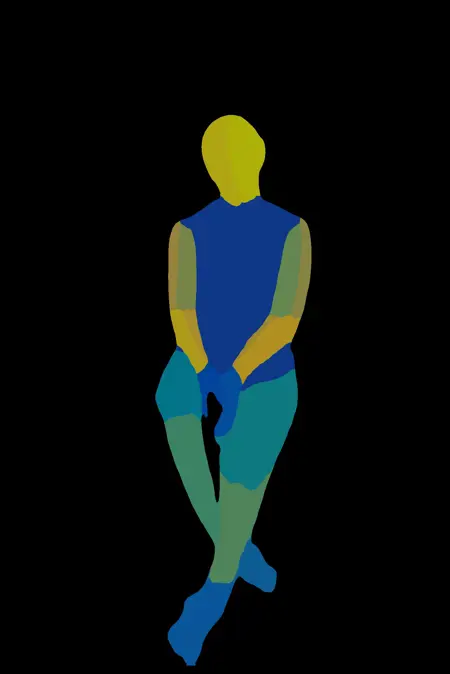

このControlNetモデルは、DensePoseアノテーションを入力として受け取ります

使用方法

.safetensorsファイルを ../stable diffusion/models/ControlNet/ に配置してください。

DensePoseについて

このリポジトリでは、DensePoseとは何か、そしてどのように使用するかを説明しています:https://github.com/facebookresearch/detectron2/tree/main/projects/DensePose

アノテーターを使用するには、指示に従って Detectron2 をインストールする必要があります。DensePoseアノテーターは apply_net.py を使用して実行されます。このスクリプトの必要な変更については、投稿の最後の画像を参照してください。

このプロジェクトをプレプロセッサーに変換することは、私にとってあまりにも困難でした。

モデルの特徴

優れている点

体のポーズが安定している

手の推論に優れた性能

難しいポーズを推論できる

Depth ControlNetとの相性が非常に良い

欠点

OpenPoseと同様、深さ情報は推論とDepth ControlNetに大きく依存している

頭の向きが不安定

複数人(正確には複数の頭)を推論しようとする意図

あなたが遭遇する可能性のある問題

Q: このモデルは複数人の推論をしがちです

A: アノテーションにあまりにも多くの空き領域を残さないでください。またはDepth ControlNetと組み合わせて使用してください。あるいは、私が行ったように(例: (one:1.2) girl)プロンプトを記述してください。

Q: このモデルの性能が良くありません

A:

DensePoseアノテーターの性能が良くありません。アノテーションを手動で修正できます。OpenPoseを修正するよりは簡単です。

Depthアノテーターの性能が良くありません。実際、私は

glpn-nyuをDepthアノテーターとして使用することをお勧めします。https://huggingface.co/vinvino02/glpn-nyu を参照してください。ポーズが難しすぎます。モデルの能力を超えております。

Q: このモデルが私のLoRAと上手く動作しません

A:

おそらくあなたのLoRAは十分なデータで学習されていません。十分な量のデータで学習されたLoRAは、ControlNetやプロンプトとの競合が少なくなります。

LoRAのINブロックの重みを0に変更してください。競合の原因は常にINブロックです。https://github.com/hako-mikan/sd-webui-lora-block-weight を参照してください。

*注:投稿内の2番目のポーズ生成では、Depth ControlNet(w=0.25)を使用しています。