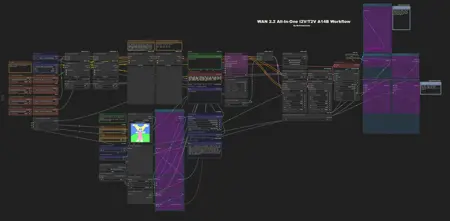

NcProductions Wan2.2 All-In-One I2V-T2V A14B Workflow

세부 정보

파일 다운로드

모델 설명

NcProductions Wan2.2 모든 기능 통합 I2V-T2V-T2I A14B 워크플로우

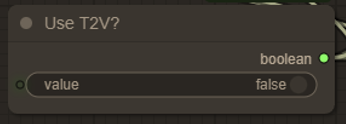

이 워크플로우는 Wan 2.2를 사용하여 비디오를 생성할 때 제가 사용하는 것입니다. 단순한 스위치 전환만으로 T2V와 I2V를 모두 지원하므로, I2V와 T2V를 전환할 때 워크플로우를 변경할 필요가 없어 유용합니다.

이 워크플로우는 I2V 및 T2V의 양자화된 모델(GGUF)을 사용합니다.

이 워크플로우의 업스케일링 흐름은 이전에 Wan 2.1과 함께 사용했던 Astraali_accWAN_GGUF 워크플로우에서 차용했습니다.

업데이트 V. 1.2

T2I 제거

- T2I 전용 워크플로우를 별도로 사용하는 것이 최적입니다.

Florence 제거

- Florence는 NSFW용으로 더 나은 I2T인 Joycaption Beta One으로 대체되었습니다.

디퓨전 모델 로드 노드 추가

일반 디퓨전 모델 또는 양자화된 모델 중 하나를 선택하여 모델을 로드할 수 있습니다. 단, 올바른 노드가 고급 T2V 활성화? 및 저급 T2V 활성화? 노드에 연결되어 있는지 확인하세요.

저는 이 워크플로우에서 DaSiWa WAN 2.2 I2V 14B Lightspeed를 사용합니다.

라이트닝 LoRA가 주 LoRA 노드 선택기에서 분리되었습니다.

업데이트 V. 1.1

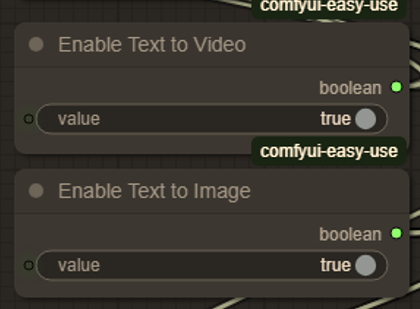

T2I 옵션 추가

- “텍스트에서 이미지로 활성화” 스위치는 “텍스트에서 비디오로 활성화” 스위치 아래에 위치합니다. 이 옵션은 “텍스트에서 비디오로 활성화” 와 함께 활성화되어야 합니다. 이를 통해 Wan 2.2가 이미지를 생성할 수 있습니다. 미리보기 이미지를 저장하려면 이미지를 오른쪽 클릭하고 **“이미지 저장”**을 선택하세요.

T2V의 잠재적 문제 수정

- 이전에는 T2V가 업로드한 이미지의 가로/세로 크기를 그대로 사용했습니다. 이제 수정되어 정의한 치수를 올바르게 사용합니다.

입력 전에 Florence 입력 활성화 옵션 추가

- 양의 프롬프트 위에 위치한 새 스위치를 사용하여 사용자 정의 양의 프롬프트 이전에 Florence 입력을 활성화할 수 있습니다. I2V를 사용하여 프레임 외 등장 캐릭터에 T2V 캐릭터 LoRA를 적용할 때 유용합니다.

기능

동일한 워크플로우에서 I2V / T2V 지원

- 앞서 언급했듯이, 간단한 스위치로 두 기능을 쉽게 전환할 수 있습니다.

시작 이미지 및 마지막 프레임

- I2V 전용. 비디오의 시작과 끝 이미지를 설정할 수 있습니다.

Florence

- I2V 전용. AI가 이미지를 설명하고, 이 설명이 사용자 정의 양의 프롬프트 앞 또는 뒤에 연결됩니다.

마지막 프레임

- 생성된 비디오의 최종 프레임을 이미지로 저장하여 원할 경우 비디오를 확장할 수 있습니다.

비디오 업스케일링

Lanczos

기본 Lanczos 비디오 업스케일링을 수행합니다. 가로 및 세로 크기는 1.5배로 증가합니다.사용자 정의 모델

Lanczos 대신 사용자 정의 업스케일링 모델을 사용합니다. 원하는 경우 직접 업스케일링 모델을 선택할 수 있습니다. 이 워크플로우에서는 1x-ITF-SkinDiffDetail-Lite-v1.pth를 사용합니다. 가로 및 세로 크기는 1.5배로 증가합니다.

설치

설치 전, 최신 버전의 ComfyUI가 설치되어 있는지 확인하세요:

ComfyUI: v0.3.51-1-gfe01885a (2025-08-20), Manager: V3.36 (이 워크플로우 업로드 시점 기준).

다음으로, “NcProductions Wan2.2 All-In-One I2V-T2V A14B Workflow.json” 파일을 실행 중인 ComfyUI 인스턴스에 드래그하세요. 요청 시 누락된 노드를 설치한 후 새로고침하세요. 모든 설정이 올바르게 구성되었다면, 모든 사용자 정의 노드를 즉시 사용할 수 있습니다.

GPU에 맞는 I2V 및 T2V의 올바른 양자화 모델을 사용하세요. 예를 들어, 저는 RTX 5080을 사용하므로 Q5_K_M 버전을 설치했습니다. 또한, 일치하는 양자화된 CLIP 모델도 사용해야 합니다.

(예: 제 경우 umt5-xxl-encoder-Q5_K_M.gguf)

양자화된 모델 링크:

I2V - https://huggingface.co/QuantStack/Wan2.2-I2V-A14B-GGUF/tree/main

T2V - https://huggingface.co/QuantStack/Wan2.2-T2V-A14B-GGUF/tree/main

이 모델들은 ComfyUI 디렉토리의 models/unet 폴더에 저장하세요.

양자화된 CLIP 모델 링크: https://huggingface.co/QuantStack/Wan2.2-T2V-A14B-GGUF/tree/main → models/clip 폴더에 저장하세요.

사용 방법

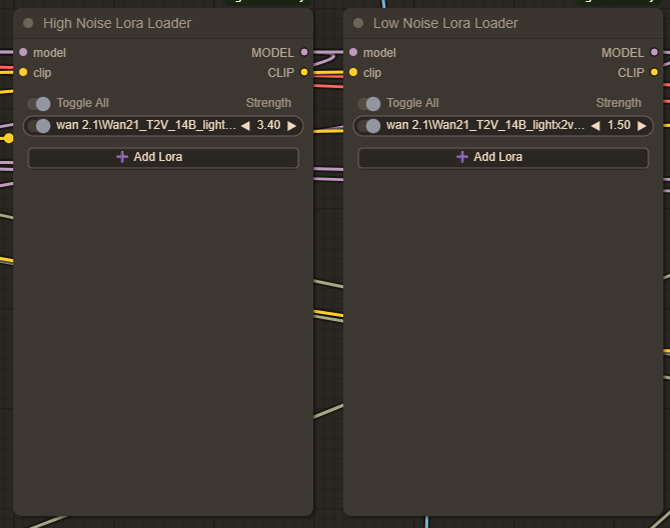

먼저 고/저 노이즈 LoRA가 필요합니다. 현재 저는 LoRA 폴더에 Wan21_T2V_14B_lightx2v_cfg_step_distill_lora_rank32.safetensors를 설치했습니다. 이 LoRA는 생성 속도를 높여주며, 먼저 선택해야 합니다.

Lightx2v에 권장하는 강도 (저가 사용하는 값):

I2V

고: 3.40

저: 1.50

T2V

고: 1.00

저: 1.00

이 워크플로우에서 I2V 및 T2V 모두 동일한 고/저 노이즈 LoRA 노드를 사용합니다.

업데이트:

Wan 2.2용 라이트닝 LoRA가 이제 제공됩니다. I2V 및 T2V에 해당하는 LoRA를 다운로드하여 사용하세요 - /model/1585622/self-forcing-causvid-accvid-lora-massive-speed-up-for-wan21-made-by-kijai?modelVersionId=2090344

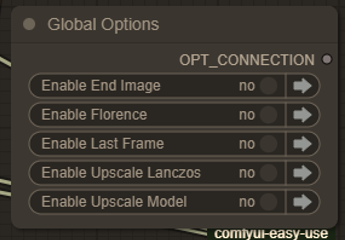

전역 옵션

다음은 전역 옵션입니다. 이 옵션은 간단한 켜기/끄기 스위치로, 워크플로우에서 어떤 기능을 활성화할지 선택할 수 있습니다. 사용 중인 I2V 또는 T2V에 따라 사용 가능한 옵션이 달라질 수 있습니다. 각 옵션은 아래 설명에서 더 자세히 설명됩니다.

I2V - T2V 전환

T2V를 활성화하려면, 전역 옵션 아래에 있는 이 노드를 켜기만 하면 됩니다. T2V가 활성화되면, 시작 이미지, 종료 이미지, Florence 옵션은 무시되고 우회됩니다.

T2I 활성화

T2I를 활성화할 때는 T2V도 함께 활성화되어야 합니다. 그렇지 않으면 업로드한 이미지의 복사본만 생성됩니다.

T2I를 사용하면 고해상도 이미지(2560x1440px 등)를 생성할 수 있으며, T2I가 비활성화된 상태에서는 길이 및 FPS를 1 또는 0으로 설정해도 불가능합니다.

이 기능은 T2V를 사용하기 전에 빠르게 프로토타입을 생성할 때도 유용하여, 전체 비디오 생성 전에 프롬프트를 빠르게 테스트할 수 있습니다.

비디오 구성 설정

T2V: 비디오의 가로 및 세로 크기를 정의하세요.

I2V: 가로 또는 세로를

0으로 둘 수 있습니다. 이 경우 업로드한 이미지의 비율을 유지하면서 자동으로 크기가 조정됩니다.길이 및 FPS: 대부분 자명하지만, 원하는 경우 재정의할 수 있습니다. 업스케일링(Lanczos) 또는 **업스케일링(모델)**이 활성화된 경우, FPS는 초기 설정값의 2배가 됩니다. 예:

16 × 2 = 32 FPS.

시작 및 종료 이미지

I2V 전용: I2V 워크플로우에 시작 이미지를 업로드하세요.

전역 옵션에서 종료 이미지 옵션을 활성화하여 I2V 워크플로우에 종료 이미지를 사용할 수 있습니다.

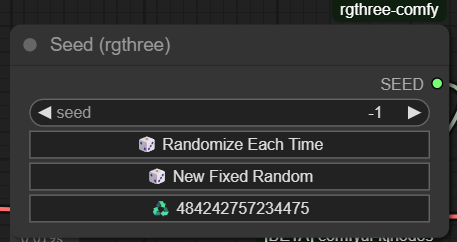

시드

이 워크플로우는 RGTHREE 시드 생성기를 사용합니다. 이 사용자 정의 노드에 익숙하다면 이 섹션을 건너뛸 수 있습니다.

익숙하지 않은 경우, 이 노드는 각 생성에 대한 시드 번호를 관리합니다:

시드 값

-1은 매번 생성 시 시드를 무작위로 변경합니다.현재 시드 값은 하단 필드에 표시됩니다.

동일한 시드를 재사용하려면 하단 필드를 클릭하여 고정 시드 값을 설정하세요.