XL-HQVAE-fp16

詳細

ファイルをダウンロード

モデル説明

KBlueLeaf 氏の EQ-SDXL-VAE を、madebyollin 氏の SDXL-Fix-VAE にマージしました。

マージには ABBA-LoRA メソッド(SVD方式)と Tall-Mask-merge メソッドを使用し、

特徴の抽出+特徴のみ更新により、EQ-VAE の特徴を選択的に合成しています。

これにより、Latent cache や画像出力で詳細をより得やすく進化しています。

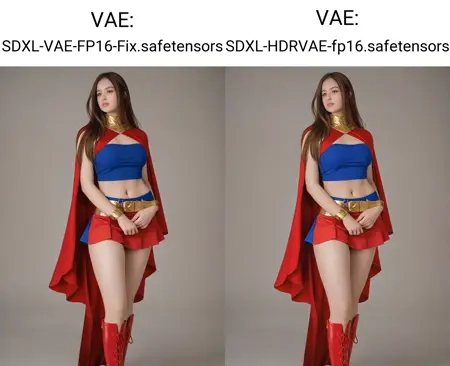

従来の VAE との置き換えでは、輝度や彩度が上がったように見えますが、

これは細部の黒つぶれなどを抑制し、階調表現が底上げされたことによるものです。

(Latent cache を生成し学習に用いることで、詳細をより学びやすくなるはずです)

※ NaN などが発生した場合は、fp32 で回避するか、使用を中止してください。

※ Latent を再作成し学習に使用して完了を確認済みです。

※ EmoLynx を用いて fp8 + 2048px + ZtSNR(e-pred) も問題なく動作しました。

※ 学習モデルにおける fp8 と fp16 の誤差は約 1e-4 程度(これは fp16-32 の誤差と同等です)。

KBlueLeaf:EQ-SDXL-VAE

https://huggingface.co/KBlueLeaf/EQ-SDXL-VAE

madebyollin:SDXL-VAE-FP16-Fix

https://huggingface.co/madebyollin/sdxl-vae-fp16-fix

ABBA-LoRA

https://arxiv.org/abs/2505.14238

Tall-Mask-Merge

https://arxiv.org/abs/2405.07813

出力画像の見た目には大きな変化はありませんが、

学習に用いることで効果をより高めることができると思います。