Grumpy Carebear's Movie Maker 2 - WAN2.2 i2v long videos

詳細

ファイルをダウンロード

このバージョンについて

モデル説明

WAN2.2 マルチセグメント動画生成ツール(初心者向けに簡略化しましたが、マスターにも十分強い)

アップデート – 2025年11月17日 16:28 PDT

バージョン2を完全に一から再構築しました。すべてが(私のテストでは)完璧に動作しています。たぶん皆さんがどこでミスったか教えてくれるでしょう。さあ、始めましょう。

これらのComfyUIワークフローは、誰かがスパゲッティをマザーボードにぶちまけたように見えませんか?

どこをクリックすればいい?どのノブを回せばいい?なぜ一つの設定を触ったらすべてが壊れたんですか?

CoyotteのMoviemakerを数日間使い込んでみたところ(私より賢い人なら本当に素晴らしいツールです)——私はもっとずっとシンプルなものが欲しくなりました。たとえ間違って古の神を呼び出さなくても使えるようなものです。

このワークフローが、まさにそれです。

そして、今やあなたにとっても「あなたのワークフロー」になります。

このワークフローの機能

このプロジェクトは、4セグメントのWAN2.2動画を生成します。各セグメントにはそれぞれ:

プロンプト

ネガティブプロンプト

LoRAスタック

WAN2.2モーション設定

ステップ数 / CFG / サンプラー

動画長さ

補間設定

が独立して設定可能です。

各セグメントは小さな動画となります。

4つすべては補間され、統合され、ComfyUI内だけで自動的に1つの連続した最終MP4に結合されます。外部スクリプトは一切不要です。

インストール後は、使い方が極めて簡単です。見た目だけ怖いんです。

ワークフローの動作方法(英語で説明)

あなたが提供するのは:

1枚の開始画像

最大4つのプロンプト(緑の箱を探してください)

パイプラインは次のように動作します:

JoyCaptionで開始画像を分析

LoraManagerでLoRAのトリガー単語を抽出

統合されたテキストプロンプトを構築

WAN2.2を実行して動画セグメントを生成

動画をフレームに変換

RIFEで補間し、滑らかな動きを実現

フレームを内部の蓄積器に追加

上記のプロセスを4回繰り返す

最後に、すべての蓄積フレームをVideoCombineに投入

1つの完成した統合動画が得られる

(オプション)その後でアップスケールやオーディオレイヤーを追加可能

パープル系のノード = 調整可能だがオプション

レッドのノード = モデルローダー — 上級者向けのみ

ブラックのノード = 痛みを楽しむ人以外は触らないで

LoraManagerの使い方(超簡単)

ComfyUI ManagerでLoraManagerをインストール

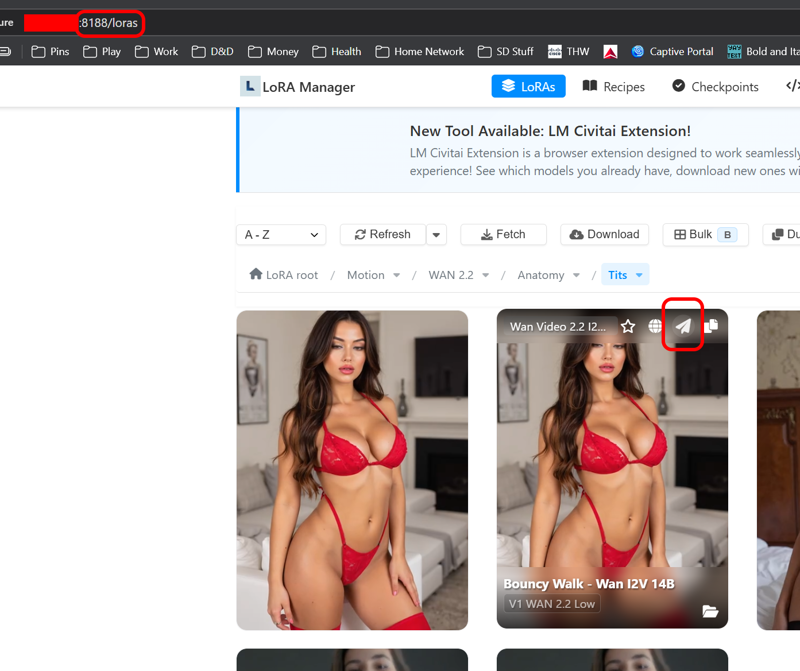

以下を開く:

http://YOUR-IP:8188/loras

LoRAのインデクシングを待つ(1分程度かかる)

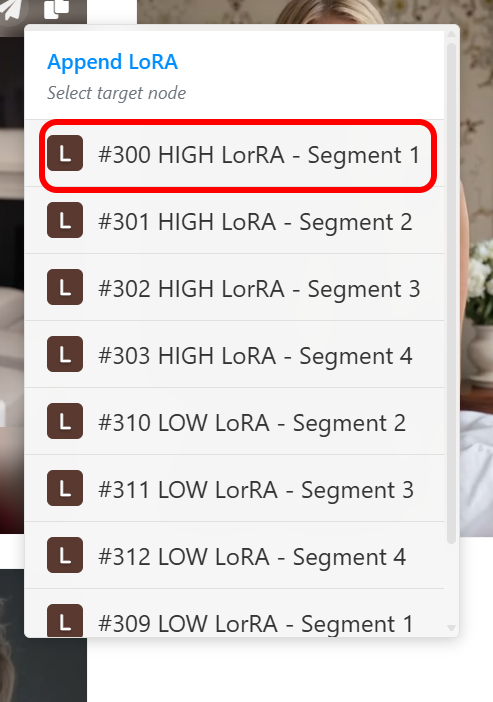

LoRAを選択してマウスを乗せると、小さなSend(送信)矢印が表示される

どのLoRAローダーに送るか選択

ComfyUIに戻ると、即座に反映される

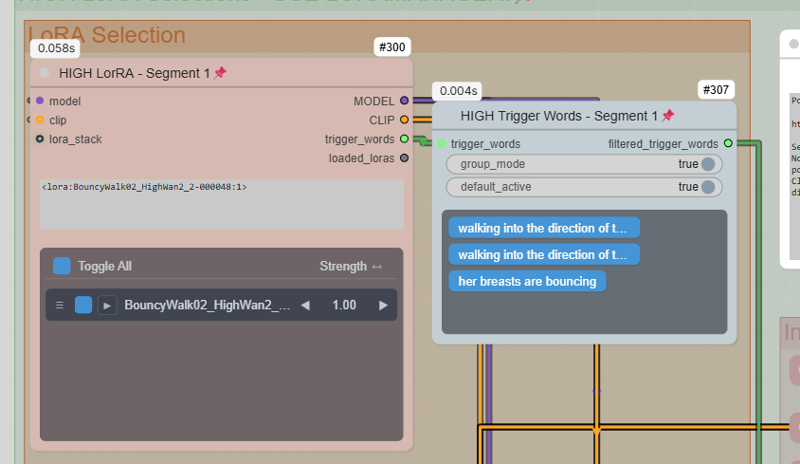

以下が表示される:

トリガー単語

効果強度のスライダー

使いたくないトリガー単語をクリックして非選択にできる

ワークフローは自動的にこれらのトリガー単語をプロンプトに組み込みます。

ワークフローの実際の使い方

1. ワークフローを読み込む

ComfyUIで.jsonファイルを開く。

2. 欠けているノードをインストール

ComfyUI Manager → インストールされていないノードをインストール

再起動。

3. 欠けているモデルをインストール

ComfyUI Manager → モデルマネージャー

フィルター:ワークフロー内 → すべてをインストール。

4. 開始画像を設定

開始画像ブロックを探す。

5. 4つのプロンプトを入力

再び緑の箱。

6. セグメント長さを調整(オプション)

各セグメントは異なる長さに設定可能。

7. 実行

ループの最後で、ワークフローは自動的に以下のものを生成:

4つのWAN2.2セグメント

4つの補間フレームバッチ

1つの連続した統合MP4

RTX 5090では、16秒の動画生成に約23分かかります。

より弱いGPUでは、以下を検討:

JoyCaptionの設定を落とす

各セグメントを最大3〜4秒に抑える

解像度やステップ数を下げる

必須ノード

すべてComfyUI Managerでインストール:

ComfyUI-Easy-Use(ループ、バッチ処理)

VideoHelperSuite(動画出力)

Frame-Interpolation (RIFE)

Impact Pack

ComfyUI-Essentials

TripleK Sampler + WAN2.2 モーションモデル

LoraManager(オプションだが強く推奨)

JoyCaptionとLoraManagerは既にワークフローに組み込まれています。

最良の結果を得るためのヒント

セグメントが気に入らなければ、そこで止める——悪いベースをアップスケールするのは無駄。

最初に「作業中」動画のプレビューを確認。

LoRAは賢く使う——12個積み重ねるより、1つずつセグメントに割り当てる方が効果的。

WAN2.2のモーションLoRAは全体を変える可能性あり——セグメントごとに試行錯誤。

弱いGPUでは、JoyCaptionの設定を大幅に下げること。

アンスロポモルフィックコンテンツでは、セグメントごとにキャラクターLoRAとポーズLoRAを組み合わせると、驚異的な連続性が得られる。

インストールのまとめ(真の初心者向け)

ComfyUIをインストール

ComfyUI Managerをインストール

このワークフローを読み込む

Manager → インストールされていないノードをインストール

ComfyUIを再起動

Manager → モデルマネージャー → 「ワークフロー内」でフィルター

すべてをインストール

再起動

画像を読み込み、プロンプトを入力して実行

これで終わり。スクリプトもPythonもffmpegもLinuxも不要。

最終的な意見

このワークフローがひどいなら、教えてください——これが私の初めての公開ワークフローで、本当に改善したいと思っています。

気に入ってもらえたり、何か素敵な作品を作れる手助けになれば、それもすごく嬉しいです。

楽しいムービーメイキングを!