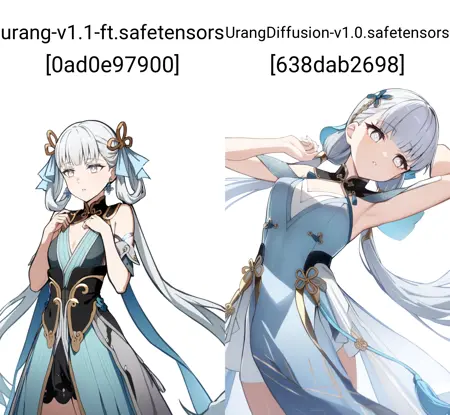

UrangDiffusion v3.1

Details

Download Files (1)

About this version

Model description

[v3.1 is still in further testing. Updates regarding new findings will be updated in the "About this version" section]

UrangDiffusion v3.1 (oo-raw-ng Diffusion) is the first UrangDiffusion version that utilize Animagine XL 4.0 as the base.

The name “Urang” comes from Sundanese, meaning “We/Our/I.” The history behind the name is to make the model not only suitable for me but also for many people. Another reason is that I use many resources (training scripts, dataset collecting scripts, etc.) from other people. It’s unfair to claim this model as “my sole work.”

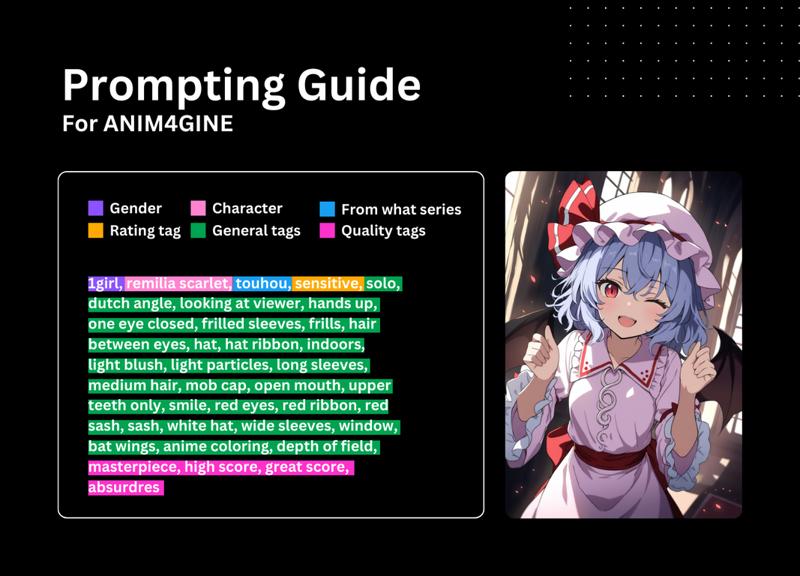

Standard Prompting Guidelines

Prompting guide:

Default negative prompt:

lowres, bad anatomy, bad hands, text, error, missing finger, extra digits, fewer digits, cropped, worst quality, low quality, low score, bad score, average score, signature, watermark, username, blurryDefault configuration: Euler a with around 25-30 steps, CFG 5-7, and ENSD set to 31337. Sweet spot is around 28 steps and CFG 6.

Training Configurations

Finetuned from: Animagine XL 4.0 Base (NOT 4.0-Zero)

Finetuning:

Dataset size: ~1,600 images

GPU: 1xA100 80GB

Optimizer: AdaFactor

Unet Learning Rate: 1.25e-6

Text Encoder Learning Rate: N/A (Turned off)

Batch Size: 48

Gradient Accumulation: 1

Warmup steps: 5%

Min SNR: 5

Epoch: 15

FAQ

Q: Images are sometimes noisy.

A: This is a common issue with Animagine XL 4.0 models in general. The base model is trained with only 10 epochs, which lead to the model being undertrained. Unlike Initial N or Initial I model that are trained with more resources.

Q: Hires fix model?

A: Check out the cover image metadata, you'll find it there.

Q: Initial N/Initial I is better.

A: Just leave and do not use the model. Simple. No need to announce your departure. Except you're willing to leave a constructive feedback or willing to fund future projects.

Special Thanks

My co-workers(?) at CagliostroLab for the insights and feedback.

Nur Hikari and Vanilla Latte for quality control.

Linaqruf, my tutor and role model in AI-generated images, and also the person behind tag ordering.

License

UrangDiffusion v1.0-v2.5 falls under the Fair AI Public License 1.0-SD license, while v3.x falls under the CreativeML OpenRAIL++-M license.