Stabilizer IL/NAI

詳細

ファイルをダウンロード

モデル説明

カバー画像は、事前学習済みモデルの生出力であり、1MP解像度です。見えたものが得られるものです。アップスケールも、手や顔のインペイント修正も、さらには否定的なプロンプトすらありません。

(2025年10月21日): 前を向く時間です...

このモデルは今後積極的に更新されることはありません。SDXLはすでに...古くなっています。2年前(2023年6月)にリリースされたからです。

新しいモデルを試してみませんか?それらはより新しいアーキテクチャ、より優れたパフォーマンス、そしてはるかに効率的です。たとえば:Lumina 2。もしあなたがまだLumina 2を知らなければ、簡単な情報:

2025年1月にリリース。オープンソース。Apache License 2.0。

DiTアーキテクチャ(現在最も一般的なアーキテクチャ。Flux.1などと同じ)。

小型で効率的。パラメータ数はわずか2B。フル(fp16)モデルで5GB、Q8モデルはたった2.5GB。そのため、品質を落とすことなくGTX1050でも読み込み・実行が可能です。

同じFlux 16ch VAEを使用。数学的にはSDXLの4ch VAEよりも4倍優れています。

Google Gemma 2 2bをテキストエンコーダーとして使用(はい、完全に機能するチャットLLM)。SDXLの旧式CLIP(タグしか理解できない)よりも10倍優れています。チャットLLMであるため、英語、中国語、日本語、タイプミス、スラング、詩などほぼすべてを理解できます。例えば、以下のようにプロンプトするだけで可能です:(注意:これは1枚の画像です。4枚ではありません。全画像とプロンプトはこちらをご覧ください。アイデアはこちらから引用。)

私は"Enhancement Bundle" LoRAを学習しました。名前が変更され、誤解を招きにくくなりました。ただし、データセットは同じです。

また、CivitaiがLumina 2をサポートしないと思います。私はこのモデルをTensorArtにもアップロードしました。こちらで私を見つけてください。ローカル環境を持っていない場合は、オンラインでLumina 2モデルを試してみてください。

便利なリンク:

モデル:

Neta Lumina:ベースモデル。danbooruとe621のデータセットでトレーニングされたアニメスタイルのファインチューニングモデル。

NetaYume Lumina:ベースモデル。最新のデータセットでさらにファインチューニング。

最適化:

ハードウェアアクセラレーション:新しいGPU(RTX 3xxx以降)にはtorch.compileを使用(30%高速化)。bf16をサポートしない古いGPU(RTX 2xxx以前)にはfp16モードを有効化(3倍高速化)。デフォルトで古いGPUはfp32を使用し、非常に遅いためです。https://civitai.com/articles/22251

TeaCache:https://github.com/spawner1145/CUI-Lumina2-TeaCache

Lightning LoRA、2倍高速化(実験的):/model/2115586

スケーリングされたfp8ベースモデル(DiT+TE)、たった3GB:/model/2023440

Stabilizer

これは何ですか?

7,000枚の画像でファインチューニングされた中規模モデル。

クローズアップ衣装、手、複雑な環境照明、伝統芸術など、多くの専門的なサブデータセットを含む。

自然なテクスチャ、照明、最高のディテールのみ。プラスチックのような光沢のあるAIスタイルは一切含まない。なぜなら、データセットにはAI生成画像が1枚も含まれていないからだ。すべての画像を私が手作業で厳選した。AI画像でトレーニングするのは好きではない。それは「伝言ゲーム」に似ている。AI画像でAIをトレーニングすれば、情報がさらに失われ、画像は劣化する(プラスチック的で光沢がある)。

プロンプト理解力の向上。自然言語のキャプションでトレーニング済み。

固定されたスタイルではなく、創造性に焦点を当てている。データセットは非常に多様であるため、このモデルは創造性を制限するデフォルトスタイル(バイアス)を持たない。

(v-pred)より優れたバランスの取れた照明。過剰な明るさや過飽和がない。同じ画像、同じ場所で純粋な黒(0)と純粋な白(255)が欲しい?問題ない。

なぜデフォルトスタイルがないのか?

「デフォルトスタイル」とは:モデルにデフォルトスタイル(バイアス)があるということは、何をプロンプトしても、同じ要素(顔、背景、感情)が生成され、デフォルトスタイルを構成してしまうこと。

利点:使いやすい。スタイルをプロンプトする必要がない。

欠点:でも、それを上書きすることはできない。デフォルトスタイルと合わないものをプロンプトしても、モデルは無視する。複数のスタイルを積み重ねても、デフォルトスタイルは常に他のスタイルを重ねて汚染・制限する。

「デフォルトスタイルなし」とは、バイアスがないということ。あなたはスタイルを明示的に指定する必要がある(タグやLoRAで)。しかし、このモデルからはスタイルの重なりや汚染は発生しない。積み重ねたスタイルを、本来の通り正確に得ることができる。

効果:

今や、モデルは単純化されたアニメ風画像ではなく、プロンプトしたスタイルを正確に生成する。スタイルの重なり・シフトなし、AI顔なし、より良いディテールのみ。比較を見てください:

https://civitai.com/images/84256995(アーティストスタイル、顔に注目)

「スタイルシフトとAI顔」が何か知りたい場合は:

他のモデル:https://civitai.com/images/107647042。女性の顔とひどい光沢のある背景。

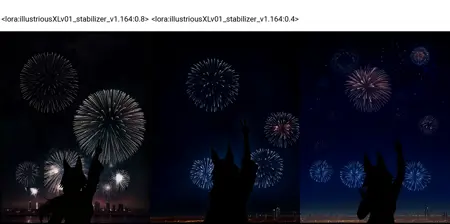

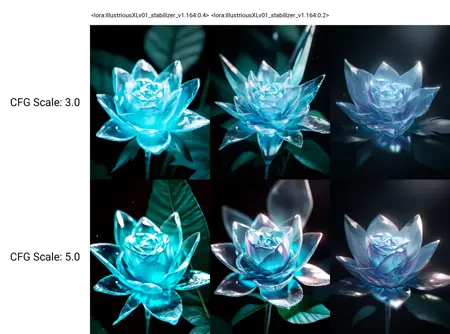

カバー画像でさらにXYプロットをご覧ください。XYプロットは千言万語に値します。

なぜこの「ファインチューニングされたベースモデル」はLoRAなのですか?

私はギガチャッドではなく、何百万枚ものトレーニング画像を持っているわけではありません。ベースモデル全体をファインチューニングする必要はありません。LoRAで十分です。

私は小さな40MiBファイルをアップロードするだけで済み、あなたは7GiBの巨大なチェックポイントではなく、それをダウンロードするだけで済みます。これにより、99.4%のデータとストレージを節約できます。そのため、頻繁にアップデートできます。

このLoRAは小さく見えますが、依然として強力です。なぜなら、NVIDIAが開発した新しいアーキテクチャDoRAを使用しているからです。これは従来のLoRAよりも効率的です。

では、この「ファインチューニングされたベースモデル」をどうやって手に入れるのですか?

事前学習済みベースモデルにこのLoRAを完全な強度で適用してください。そうすると、事前学習済みベースモデルはファインチューニングされたベースモデルになります。以下「使い方」をご覧ください。

このモデルを用いたマージの共有は禁止します。ご注意ください。ここには見えないウォーターマークを出力する隠しトリガー語が組み込まれています。ウォーターマークと検出器は私が自分でコーディングしました。使いたくないですが、可能なら使います。

このモデルはCivitaiとTensorArtでのみ公開されています。他のプラットフォームで「me」やこの文を見つけた場合、すべて偽物であり、あなたが使用しているプラットフォームは海賊版です。

フィードバックはコメント欄に残してください。すべての人が見られるように。Civitaiのレビュー制度にフィードバックを書かないでください。設計が悪すぎて、誰もレビューを見つけられず、見られないからです。

使い方

バージョン:

nbvp10(NoobAI v-pred v1.0用)。

- 精度の高い色と鋭いディテール。

nbep10(NoobAI eps v1.0用)。

- v-predモデルと比べて彩度とコントラストがやや低い。標準的なイプシロン(eps)予測は、モデルが広い色範囲に達することを制限する。だからこそ、後にv-predが登場した。

illus01(Illustrious v0.1でトレーニング済み。ただし、NoobAI eps v1.0を推奨)。

- 他のファインチューニングされたベースモデルの上にこのモデルを使用する場合、注意してください。現在「Illustrious」とラベル付けされたアニメベースモデルのほとんど(90%)は実際にはNoobAI(または主にNoobAI)です。両方のバージョン(il01とnbep10)を試して、どちらがより良いか確認することを推奨します。

LoRAスタックの最初にこのLoRAを読み込んでください。

このLoRAはNVIDIAが開発した新しいアーキテクチャDoRAを使用しており、従来のLoRAよりも効率的です。しかし、従来のLoRAが静的なパッチ重みを持つのとは異なり、DoRAのパッチ重みは現在読み込まれているベースモデルの重みに基づいて動的に計算されます(LoRAを読み込むたびに変化します)。予期せぬ変更を最小限に抑えるために、このLoRAを最初に読み込んでください。

このモデルの使い方は2通りあります:

1). ファインチューニングされたベースモデルとして使用する(推奨):

最高かつ自然なディテールを得て、完全にコントロール可能なスタイル組み合わせを構築したい場合。

このLoRAを事前学習済みベースモデルの上に適用してください。ただし、事前学習済みモデルとは、ファインチューニングされていないオリジナルのモデルを意味します。例:NoobAI v-pred v1.0、NoobAI eps v1.0

2). 他のファインチューニングされたベースモデルのLoRAとして使用する。

結局のところ、これはLoRAです。

ただし注意:

これはスタイルLoRAではありません。実質的に2つのベースモデルをマージしようとしています。その結果は常に期待通りとは限りません。

これは、ハイパーマージされたAIスタイルに汚染された「1girl」過学習モデル(50種類のNova Furry 3DアニメWAIなど)には効果がありません。このモデルは、光沢のあるプラスチック的なAIスタイルを修正できません。AIスタイルを排除したい場合は、事前学習済みベースモデルを使用してください。

これは、アニメ「 Spice and Wolf 」のCraft Lawrenceがこのように描かれるべき姿です:https://civitai.com/images/107381516

これは、AIスタイルに汚染された「1girl」過学習モデルが生成したもの:https://civitai.com/images/107647042

FAQ:

カバー画像は、事前学習済みモデルの生出力であり、1MP解像度です。魔法のプラグインも、アップスケールも、手や顔のインペイント修正も、否定的なプロンプトすらありません。一部のユーザーが再現できないと言いますが、それはスキルの問題です。(ベースモデルの不一致、または多すぎる「最適化」の追加)

低強度(例:0.5未満)でもベースモデルが破壊された場合、それはあなたのベースモデルの問題です。あなたのベースモデルはすでにこのLoRAをマージしており(あなたが2回マージした)、モデルの重みが乗算されて崩壊したのです。偽のベースモデル製作者(いわゆる泥棒)に注意してください。一部の「製作者」はトレーニングを一切行わず、他人のモデルを奪い、マージして、メタデータとクレジットをすべて消し去り、自分のベースモデルとして販売しています。

その他のツール

Stabilizerの一部として検討されていた、またはかつて組み込まれていたいくつかのアイデアが、別々のLoRAとして分離されました。より柔軟性を高めるため。コレクションリンク:https://civitai.com/collections/8274233。

Dark:暗い環境にバイアスをもつLoRA。一部のベースモデルに見られる高明るさバイアスの修正に役立ちます。低明るさ画像でトレーニング。スタイルバイアスがないため、スタイル汚染なし。

Contrast Controller:手作成のLoRA。モニターのコントラストスライダーのようにコントラストを制御できます。他のトレーニングされた「コントラスト強調器」と異なり、このLoRAの効果は安定しており、数学的に線形であり、スタイルに完全な副作用がありません。

ベースモデルに過飽和の問題がある場合、または非常にカラフルなものを求めているときに便利です。

例:

Style Strength Controller:または過学習効果低減器。あらゆる種類の過学習効果(オブジェクト、明るさなどのバイアス)を数学的に低減できます。必要なら、強化することも可能です。

Stabilizerとの違い:

Stabilizerは現実のデータでトレーニングされています。テクスチャ、ディテール、背景の過学習効果を「再追加」することでしか低減できません。

Style Controllerはトレーニングされていません。ベースモデルのトレーニングを「取り消す」ようなもので、過学習を少なくします。明るさやオブジェクトのバイアスなど、あらゆる過学習効果を数学的に低減できます。

古いバージョン:

「アップデートログ」でさらに詳細をご覧ください。古いバージョンは効果が大きく異なる可能性があります。

主なタイムライン:

現在〜:自然なディテールとテクスチャ、安定したプロンプト理解、さらなる創造性。純粋な2Dアニメスタイルに限定されません。

illus01 v1.23 / nbep11 0.138〜:鮮やかな色を備えたより良いアニメスタイル。

illus01 v1.3 / nbep11 0.58〜:より良いアニメスタイル。

アップデートログ

(2025年10月21日): NoobAI v-pred v0.280a

- 特別バージョン。「a」はアニメを意味します。デフォルトの2Dアニメスタイルが含まれています。スタイルをプロンプトしたくない場合、より使いやすくなります。また、データセットが大きく変更されたため、効果は以前のバージョンとはかなり異なる可能性があります。

(2025年8月31日) NoobAI eps v1.0 v0.273

このバージョンは、NoobAI eps v1.0から最初からトレーニングされています。

以前のillus01 v1.198と比較:

極端な条件下での明るさがより良く、バランスが取れています。(nbvp v0.271と同じ)

テクスチャとディテールが向上しました。高SNRのタイムステップでより多くのトレーニングステップを実施しています。(illus01バージョンは互換性を優先してこれらのタイムステップをスキップしていました。現在、すべてのベースモデルがNoobAIであるため、これらのタイムステップをスキップする必要はありません。)

(2025年8月24日) NoobAI v-pred v0.271:

前回のv0.264と比較して:

極端な条件下での照明がより良く、バランスが取れており、バイアスが減少しました。

同じ画像内、同じ場所でも、高コントラストで純粋な黒(0)と白(255)を同時に実現。オーバーフローとオーバーサチュレーションが発生しません。今ならこれらすべてを同時に得られます。

(以前のv0.264はオーバーフローを避けるために画像を10〜250の範囲に制限しようとし、依然として顕著なバイアスが存在しました。全体的に画像が過度に暗いか明るくなりがちでした。)

v0.264と同様、高強度またはフル強度(0.9〜1)を推奨します。

(2025年8月17日) NoobAI v-pred v0.264:

NoobAI v-predで最初にトレーニングされたバージョンです。

照明が改善され、オーバーフローが減少しました。

注:高強度またはフル強度(0.9〜1)を推奨します。

(2025年7月28日) illus01 v1.198

主にv1.185cと比較して:

「c」バージョンの終了。視覚的に「印象的」であることは良いが、互換性に問題がありました。たとえば、ベースモデルがすでにコントラスト強化を備えている場合、二重のコントラスト強化は非常に悪影響を及ぼします。そのため、過剰なポストエフェクト(高コントラスト、高彩度など)は削除しました。

代わりに、テクスチャとディテールが増加。シネマティックレベルの照明。互換性が向上。

このバージョンはデータセット全体の見直しなど多くの変更を含んでおり、以前のバージョンとは大きく異なる効果になります。

v1.185cの「狂った」エフェクトを再び求めている方へ:このような純粋で専用のアートスタイルは、このページで見つけることができます。LoRA用のデータセットが十分に大きければ、今後トレーニングするかもしれません。

(2025年6月21日) illus01 v1.185c:

v1.165cと比較して:

明瞭さとシャープネスが+100%向上。

あまりに混沌としていて説明できない画像が-30%減少。このバージョンはもはや極端な高コントラストを出力できなくなりましたが、通常の使用ではより安定しています。

(2025年6月10日): illus01 v1.165c

これは特別なバージョンです。 v1.164の改良版ではありません。「c」は「colorful(彩り豊か)」、「creative(創造的)」、時には「chaotic(混沌)」を意味します。

データセットには非常に視覚的に印象的だが、時々説明が困難な画像が含まれています。例:非常にカラフル、高コントラスト、複雑な照明条件、あらゆる場所に複雑なパターンやオブジェクト。

そのため、「視覚的に印象的」な結果を得られますが、その代わりに「自然さ」が犠牲になります。柔らかい色調のスタイル(例:鉛筆画)に悪影響を与える可能性があります。このバージョンは、v1.164のように「鉛筆画」のテクスチャを完璧に生成できません。

(2025年6月4日): illus01 v1.164

プロンプト理解が向上。各画像には3つの異なる視点からの自然なキャプションが付与されています。DanbooruタグはLLMでチェックされ、重要なタグのみが抽出・自然なキャプションに統合されています。

オーバーエクスポージャー対策。モデル出力が純白#ffffffに達するのを防ぐためのバイアスを追加。#ffffffはほとんどの場合オーバーエクスポージャーを意味し、多くのディテールが失われます。

いくつかのトレーニング設定を変更。NoobAI(e-predおよびv-predの両方)との互換性を向上。

(2025年5月19日): illus01 v1.152

照明、テクスチャ、ディテールの継続的な改善。

5000枚以上の画像追加、トレーニングステップ増加により、効果が強化。

(2025年5月9日): nbep11 v0.205:

- v0.198の明るさと色に関する問題の迅速な修正。実写写真のように明るさや色を劇的に変更しなくなりました。v0.198自体は悪くありませんでしたが、創造的すぎて過剰でした。

(2025年5月7日): nbep11 v0.198:

より多くの暗い画像を追加。暗い環境下での体の歪みや背景の問題が減少。

色とコントラストの強化を削除。もはや不要となったため。代わりにContrast Controllerをご使用ください。

(2025年4月25日): nbep11 v0.172。

illus01 v1.93〜v1.121で導入された新機能と同様。まとめ:新しい写真データセット「Touching Grass」。より自然なテクスチャ、背景、照明。キャラクター効果を弱め、互換性を向上。

色の正確性と安定性の改善。(nbep11 v0.160と比較)

(2025年4月17日): illus01 v1.121。

illustrious v0.1へ戻りました。illustrious v1.0以降のバージョンは意図的にAI生成画像(データセットの約30%)でトレーニングされており、LoRAトレーニングには不適切でした。論文を読むまで気づきませんでした。

キャラクタースタイルの効果を低減。v1.23レベルに戻りました。このLoRAによるキャラクターのディテールは減少しますが、互換性は向上します。これはトレードオフです。

その他は下記のv1.113と同様。

(2025年4月10日): illus11 v1.113 ❌。

更新: ベースモデルがIllustrious v1.1に基づいている場合にのみこのバージョンをご使用ください。それ以外の場合はillus01 v1.121をご使用ください。

Illustrious v1.1でトレーニング。

新しいデータセット「Touching Grass」を追加。より自然なテクスチャ、照明、被写界深度効果。背景の構造的安定性向上。歪んだ部屋や建物などの背景の問題が減少。

LLMによる完全な自然言語キャプションを採用。

(2025年3月30日): illus01 v1.93。

- v1.72は過度にトレーニングされていました。そのため全体的な強度を低減。互換性が向上するはずです。

(2025年3月22日): nbep11 v0.160。

- illus v1.72と同様の内容。

(2025年3月15日): illus01 v1.72

下記のani40z v0.4で言及された新しいテクスチャと照明のデータセットと同様。より自然な照明と自然なテクスチャ。

手のディテール強化用に約100枚の小さなデータセットを追加。ガラスやカップなどを握るなど、異なるタスクの手に焦点を当てています。

データセットから「シンプルな背景」の画像をすべて削除。-200枚。

学習ツールをkohyaからonetrainerに変更。LoRAアーキテクチャをDoRAに変更。

(2025年3月4日) ani40z v0.4

Animagine XL 4.0 ani40zeroでトレーニング。

自然な動的照明とリアルなテクスチャに焦点を当てた約1000枚のデータセットを追加。

より自然な照明と自然なテクスチャ。

ani04 v0.1

- Animagine XL 4.0の初期バージョン。主にAnimagine 4.0の明るさの問題を修正。より良いコントラストと明るさ。

illus01 v1.23

nbep11 v0.138

- データセットのバランスを取るため、フューリー、非人間、その他画像を追加。

nbep11 v0.129

- 不良バージョン。効果が弱すぎるので無視してください。

nbep11 v0.114

「フルレンジカラー」を実装。結果を「普通で見た目が良い」方向に自動的に調整します。これはほとんどの写真編集ツールにある「ワンクリック写真自動補正」ボタンと考えてください。この最適化の欠点:強いバイアスを防ぎます。たとえば、画像の95%を黒、5%を明るくしたい場合でも、50/50になってしまうのを防ぎます。

ややリアルなデータを追加。より鮮明なディテール、照明、平坦な色の減少。

illus01 v1.7

nbep11 v0.96

トレーニング画像を増やしました。

小さな「壁紙」データセット(実際のゲーム壁紙、私が見つけた最高品質のもの。約100枚)で再微調整。ディテール(皮膚、髪の毛など)とコントラストがさらに改善。

nbep11 v0.58

- 画像を追加。トレーニングパラメータをNoobAIベースモデルにできるだけ近づけました。

illus01 v1.3

nbep11 v0.30

- 画像を追加。

nbep11 v0.11: NoobAI epsilon予測 v1.1でトレーニング。

- データセットタグを改善。LoRA構造と重み分布を改善。安定性が向上し、画像構成への影響が少なくなりました。

illus01 v1.1

- illustriousXL v0.1でトレーニング。

nbep10 v0.10

- NoobAI epsilon予測 v1.0でトレーニング。